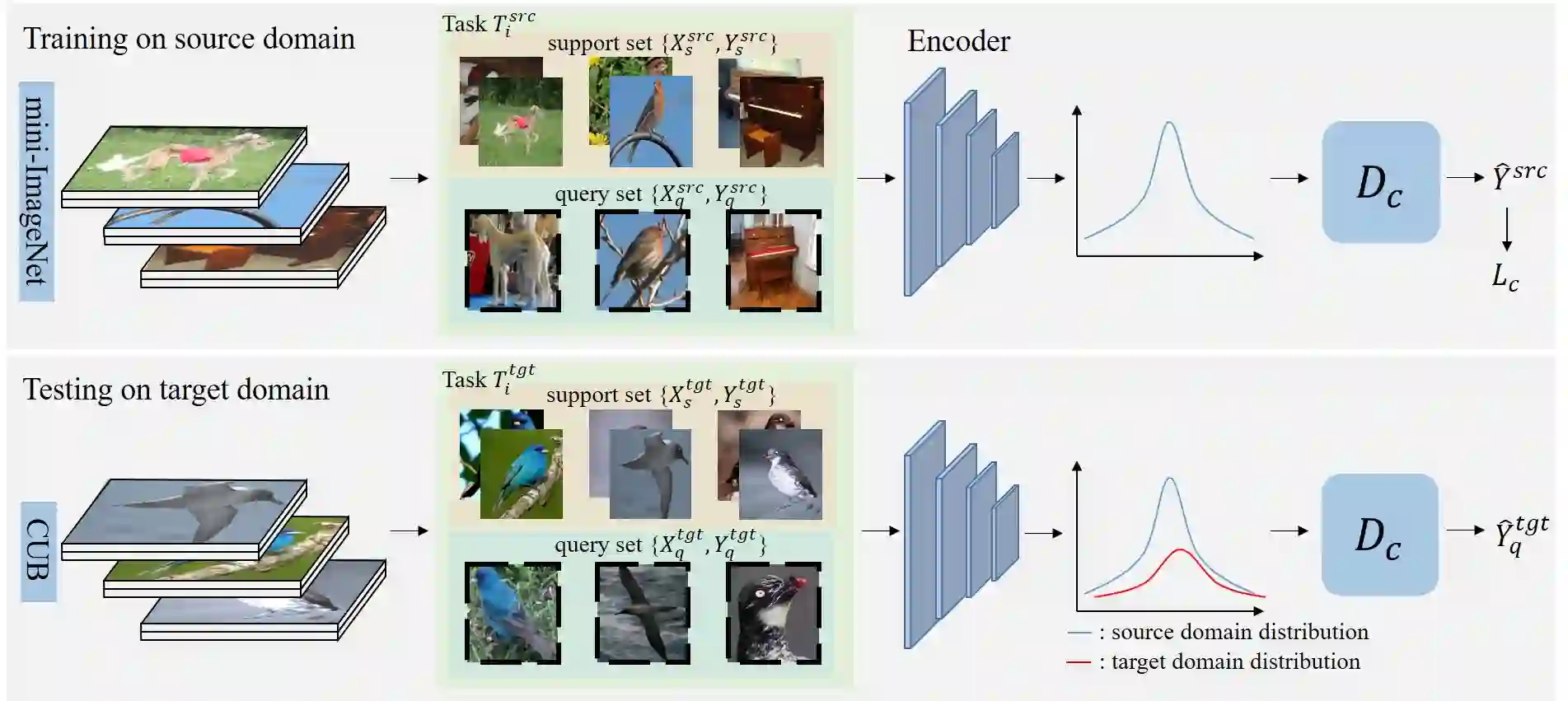

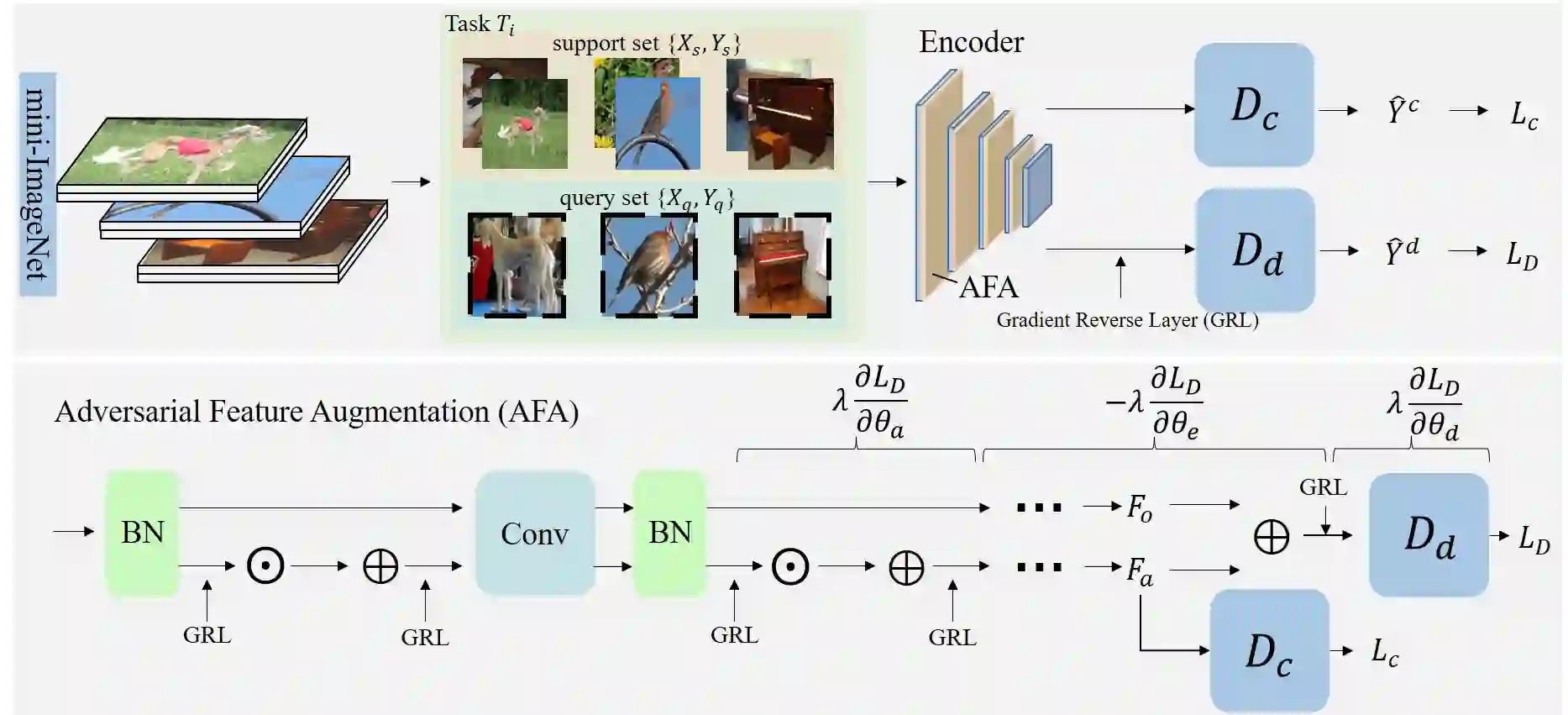

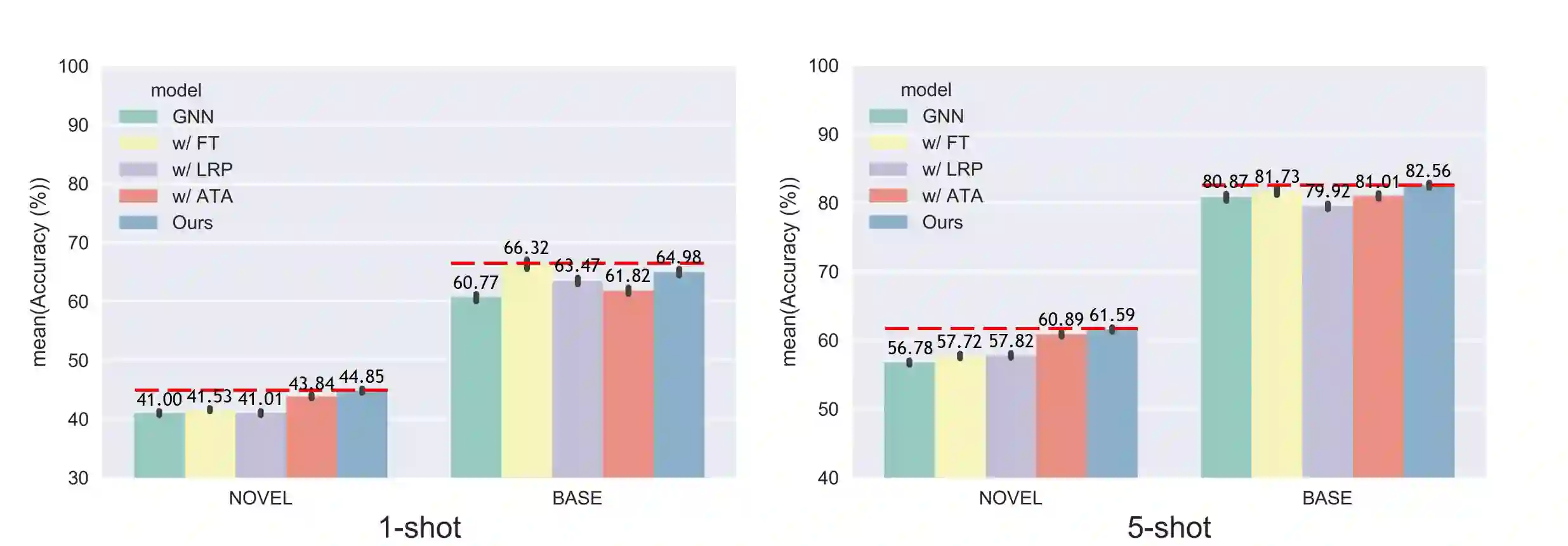

Existing methods based on meta-learning predict novel-class labels for (target domain) testing tasks via meta knowledge learned from (source domain) training tasks of base classes. However, most existing works may fail to generalize to novel classes due to the probably large domain discrepancy across domains. To address this issue, we propose a novel adversarial feature augmentation (AFA) method to bridge the domain gap in few-shot learning. The feature augmentation is designed to simulate distribution variations by maximizing the domain discrepancy. During adversarial training, the domain discriminator is learned by distinguishing the augmented features (unseen domain) from the original ones (seen domain), while the domain discrepancy is minimized to obtain the optimal feature encoder. The proposed method is a plug-and-play module that can be easily integrated into existing few-shot learning methods based on meta-learning. Extensive experiments on nine datasets demonstrate the superiority of our method for cross-domain few-shot classification compared with the state of the art. Code is available at https://github.com/youthhoo/AFA_For_Few_shot_learning

翻译:以元学习为基础的现有方法预测了(目标域)测试任务的新类标签(目标域),方法是通过从基础班的培训任务(源域)中学习的元知识(源域),但是,大多数现有工作可能由于各领域之间可能存在巨大的领域差异而不能概括为新类。为了解决这一问题,我们提议了一种新的对抗性特征增强(AFA)方法,以弥合在微粒学习中存在的领域差距。功能增强的目的是通过最大限度地扩大域差异来模拟分布差异。在对抗性培训期间,通过区分增强的功能(未见域)与原始功能(见域)来学习域区分域歧视者,而将域差异最小化以获得最佳的功能编码。拟议方法是一个插接和功能模块,可以很容易地融入基于元学习的现有几发学习方法中。对九个数据集进行的广泛实验表明我们跨杜梅少发分类方法优于艺术状态。代码可在https://github.com/youthhoo/AFAFAF_Few_shot_ining_ining)查阅原始功能。