【泡泡一分钟】机器人顶级会议精华提炼(20181217-20181223)

每天一分钟,带你读遍机器人顶级会议文章

来源:计算机视觉和机器人顶级会议

播音员:糯米

汇总:陈世浪,颜青松

编译:泡泡一分钟全体组员

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

2018年12月17日至2018年12月22日,泡泡一分钟共推送了11篇文章,其内容涉及到位姿估计(4篇)、VIO(4篇)、SLAM框架(2篇)和语义分割(1篇)等。

位姿估计

位姿估计本周共推送了4篇文章。

第一篇文章介绍了基于正则强化学习算法,将算法应用在多个基准任务上,同时在机器人触觉操作任务上进行实验,结果表明,通过结合少量线性策略,能达到目前深度强化学习的最优效果。

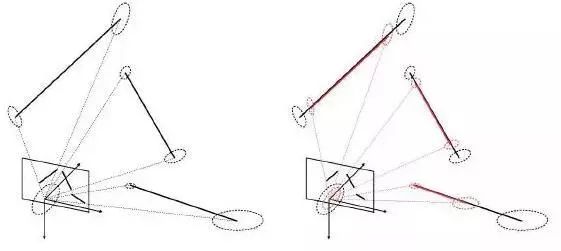

第二篇文章介绍了一种使用输入的3D线(信息)精确求解最小二乘位姿优化问题。在低纹理和运动模糊的两个目标场景中进行线辅助VO/VSLAM评估时,位姿跟踪的准确性得到提升,同时保持了鲁棒性。

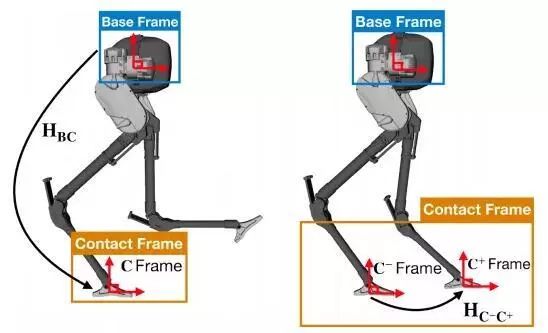

第三篇文章介绍了一种基于因子图的视觉-惯导-运动腿状态估计方法,提出的方法能够提高状态估计的精度,并提高整个系统的鲁棒性,本文的算法也促进了腿式机器人的发展。

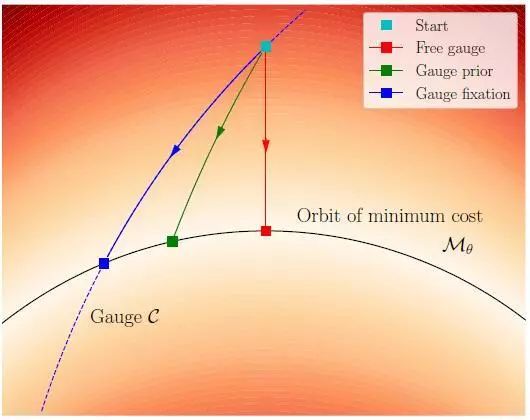

最后一篇文章首次提出了一种在基于优化的视觉-惯性状态估计框架中对规范自由度进行不同处理方式的比较分析方法。其研究结果在仿真和实际数据集中都得到了验证,可用于设计基于优化的视觉惯性估计算法。

SLAM框架

VIO

VIO方面共推送了四篇文章。

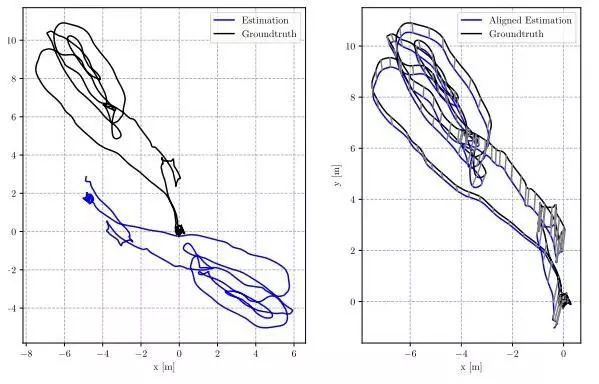

第一篇文章介绍了一种视觉惯性里程计的轨迹定量评估教程。作者发布了源码:https://github.com/ uzh-rpg/rpg_trajectory_evaluation

第二篇文章介绍了一种将李群应用到无损卡尔曼滤波中。其解决方案集成了无损卡尔曼滤波准确性、健壮性和通用性的特点。

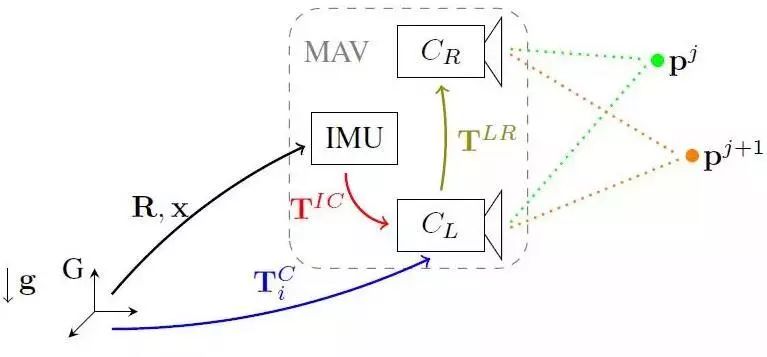

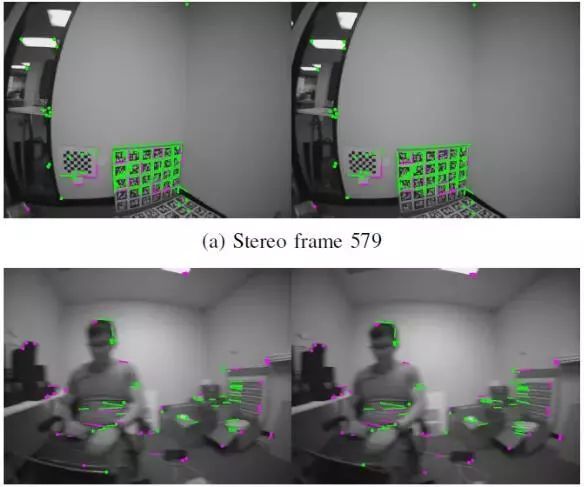

第三篇文章介绍了Trifo-VIO,使用点和线的紧耦合滤波双目VIO系统。

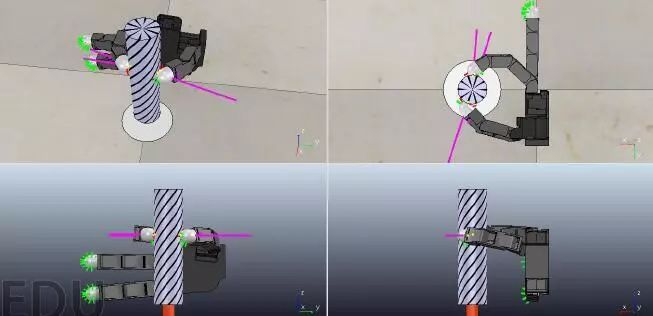

第四篇文章介绍了一种使用单目相机和惯导传感器,在线在未知的环境中填充入基于欧氏参考系的已知物体的模型。。

SLAM框架

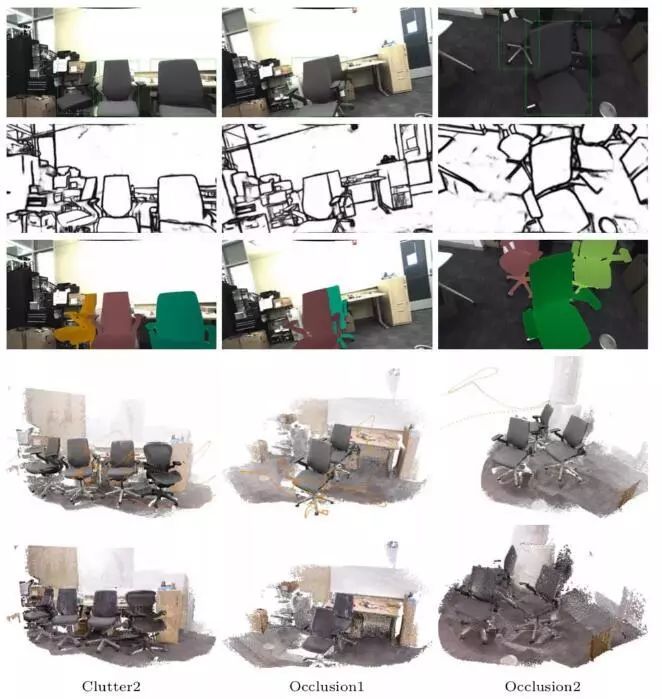

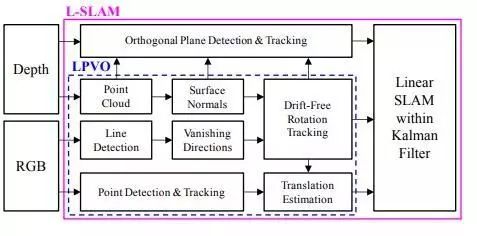

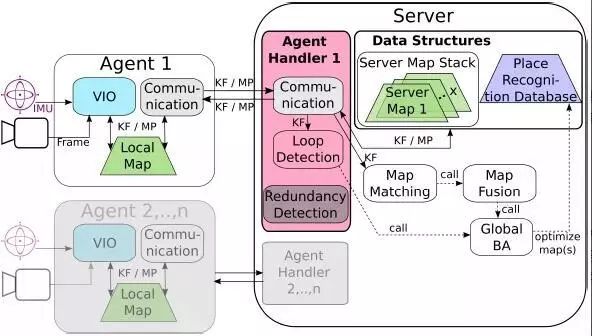

场景定位本周介绍了Linear RGB-D SLAM和CVI-SLAM 。

Linear RGB-D SLAM在线性卡尔曼滤波器框架内联合估计地图中的摄像机位置和平面地标,算法展示出了与其他最先进的SLAM方法相当的性能并且无需使用高代价的非线性优化方式。

CVI-SLAM是一种协作SLAM系统,可以在多代理、协作任务中,实现更高效和鲁棒的机器人感知。

语义分割

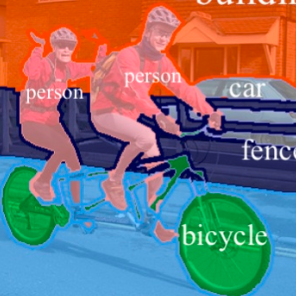

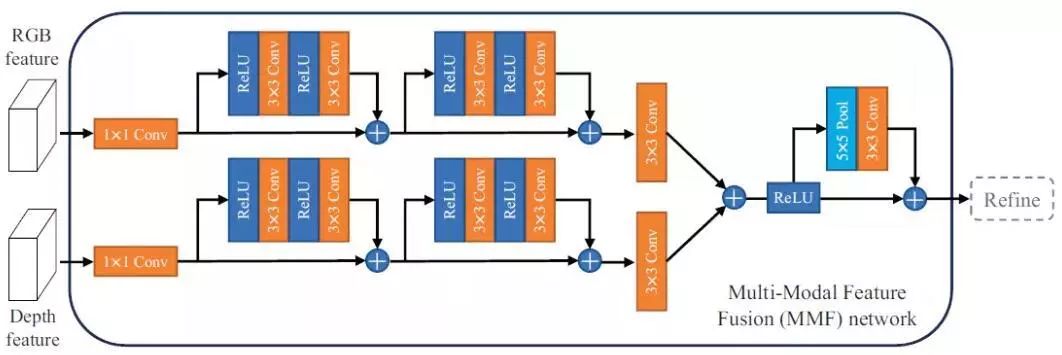

语义分割方面介绍了一种RGB-D多层级残差特征融合的室内语义分割方法,实现了多模态特征的最优融合。

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com