【泡泡一分钟】基于机器人的视觉惯性里程计(IROS2018-10)

每天一分钟,带你读遍机器人顶级会议文章

标题:Robocentric Visual-Inertial Odometry

作者:Zheng Huai and Guoquan Huang

来源:2018 IEEE/RSJ International Conference on Intelligent Robots and Systems

编译:王凯东

审核:陈世浪,颜青松

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权。

摘要

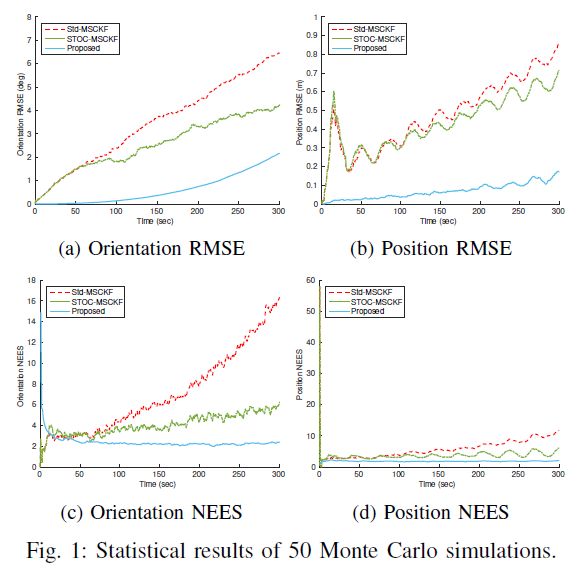

在本文中,作者提出了以机器为核心,基于多状态限制卡尔曼滤波器框架的框架视觉惯性slam系统,并提出了高效简洁的机器视觉惯性里程计算法(R-VIO),该算法可以用单目视觉在严苛的环境中持续定位。

此方法最主要是应用一个移动地方框架而不是在标准的以全球为中心的固定框架,它应用高准确度的相对运动估计进行全球定位更新。R-VIO的一个直接好处是它可以从任意位置开始,而不需要应用重力方向进行方位匹配。更重要的是,我们的分析表明,在标准全球中心框架普遍认为易导致估计偏差的系统中,这种机器人型基于卡尔曼滤波器的视觉惯性系统并没有表现出异常。

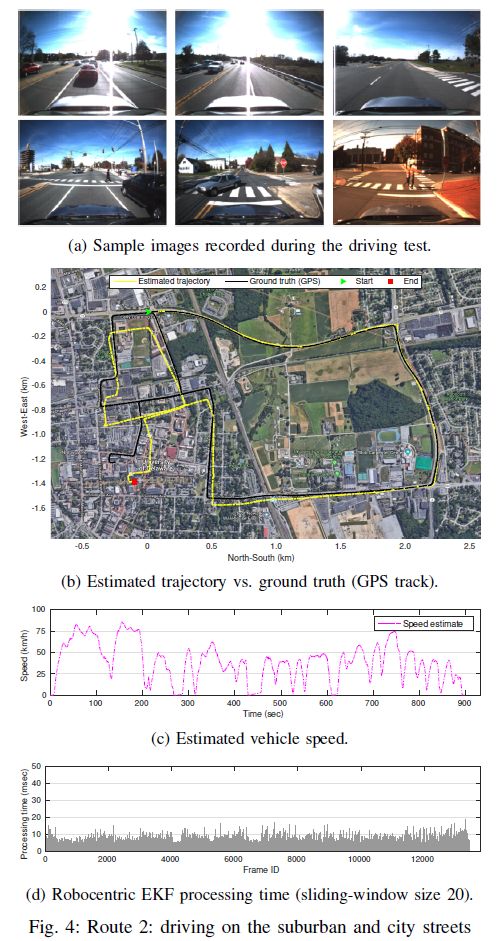

而且,R-VIO算法在蒙特卡罗模拟和真实世界中都用不同的传感器平台和不同环境进行过实验和测试,结果表明此方法在持续性,准确性与高效性方面都不逊于最先进的VINS算法。

Abstract

In this paper, we propose a novel robocentric formulation of visual-inertial navigation systems (VINS) within a multi-state constraint Kalman filter (MSCKF) framework and develop an efficient, lightweight, robocentric visual-inertial odometry (R-VIO) algorithm for consistent localization in challenging environments using only monocular vision. The key idea of the proposed approach is to deliberately reformulate the 3D VINS with respect to a moving local frame (i.e., robocentric), rather than a fixed global frame of reference as in the standard world-centric VINS, and instead utilize high-accuracy relative motion estimates for global pose update. As an immediate advantage of using this robocentric formulation, the proposed RVIO can start from an arbitrary pose, without the need to align its orientation with the global gravity vector. More importantly, we analytically show that the proposed robocentric EKF-based VINS does not undergo the observability mismatch issue as in the standard world-centric frameworks which was identified as the main cause of inconsistency of estimation. The proposed RVIO is extensively tested through both Monte Carlo simulations and real-world experiments using different sensor platforms in different environments and shown to achieve competitive performance with the state-of-the-art VINS algorithms in terms of consistency, accuracy and efficiency.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com