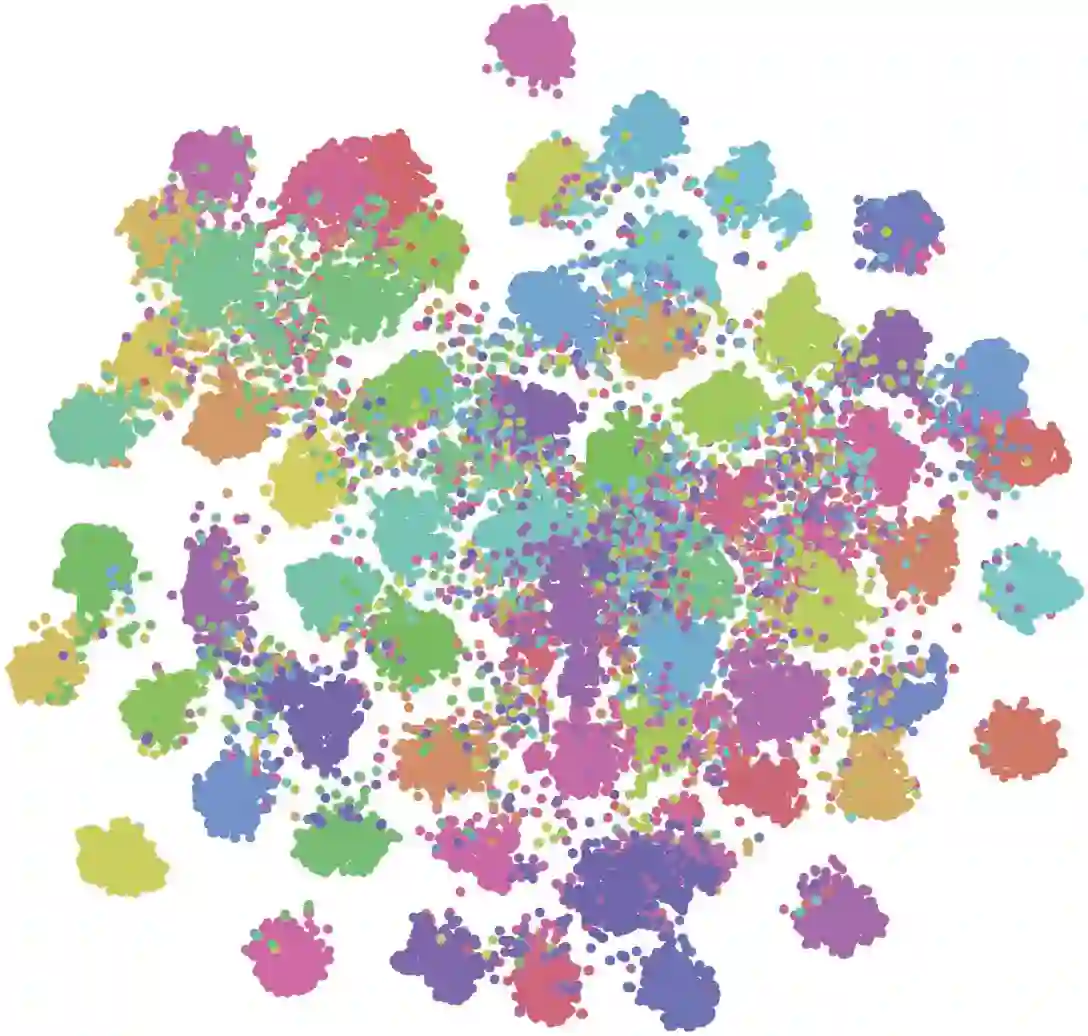

Few-shot learning is a challenging task, which aims to learn a classifier for novel classes with few examples. Pre-training based meta-learning methods effectively tackle the problem by pre-training a feature extractor and then fine-tuning it through the nearest centroid based meta-learning. However, results show that the fine-tuning step makes very marginal improvements. In this paper, 1) we figure out the key reason, i.e., in the pre-trained feature space, the base classes already form compact clusters while novel classes spread as groups with large variances, which implies that fine-tuning the feature extractor is less meaningful; 2) instead of fine-tuning the feature extractor, we focus on estimating more representative prototypes during meta-learning. Consequently, we propose a novel prototype completion based meta-learning framework. This framework first introduces primitive knowledge (i.e., class-level part or attribute annotations) and extracts representative attribute features as priors. Then, we design a prototype completion network to learn to complete prototypes with these priors. To avoid the prototype completion error caused by primitive knowledge noises or class differences, we further develop a Gaussian based prototype fusion strategy that combines the mean-based and completed prototypes by exploiting the unlabeled samples. Extensive experiments show that our method: (i) can obtain more accurate prototypes; (ii) outperforms state-of-the-art techniques by 2% - 9% in terms of classification accuracy. Our code is available online.

翻译:少见的学习是一项具有挑战性的任务,目的是学习新类的分类师,并举几个例子。 培训前的元学习方法通过预先训练一个功能提取器来有效解决问题,然后通过最近的以机器人为基础的元学习来微调。 但是,结果显示微调步骤的改进非常微不足道。 在本文中, 1 我们找出关键原因, 即, 在预培训的特征空间, 基础类已经形成集束, 而新类则以差异很大的组形式分布, 这意味着微调功能提取器的意义不大; 2 微调功能提取器, 而不是微调功能提取器, 我们的重点是在元学习期间估算更具代表性的原型。 因此, 我们提出一个新的基于完成原型的元学习框架。 这个框架首先引入原始知识( 类级部分或属性说明), 并提取具有代表性的属性特征。 然后, 我们设计一个原型的完成网络, 学习完成这些原型的原型。 为了避免原始知识噪音或阶级差异造成的原型完成错误, 我们进一步开发一个基于 Gausian 的原型系统原型模型, 将我们原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原型的原