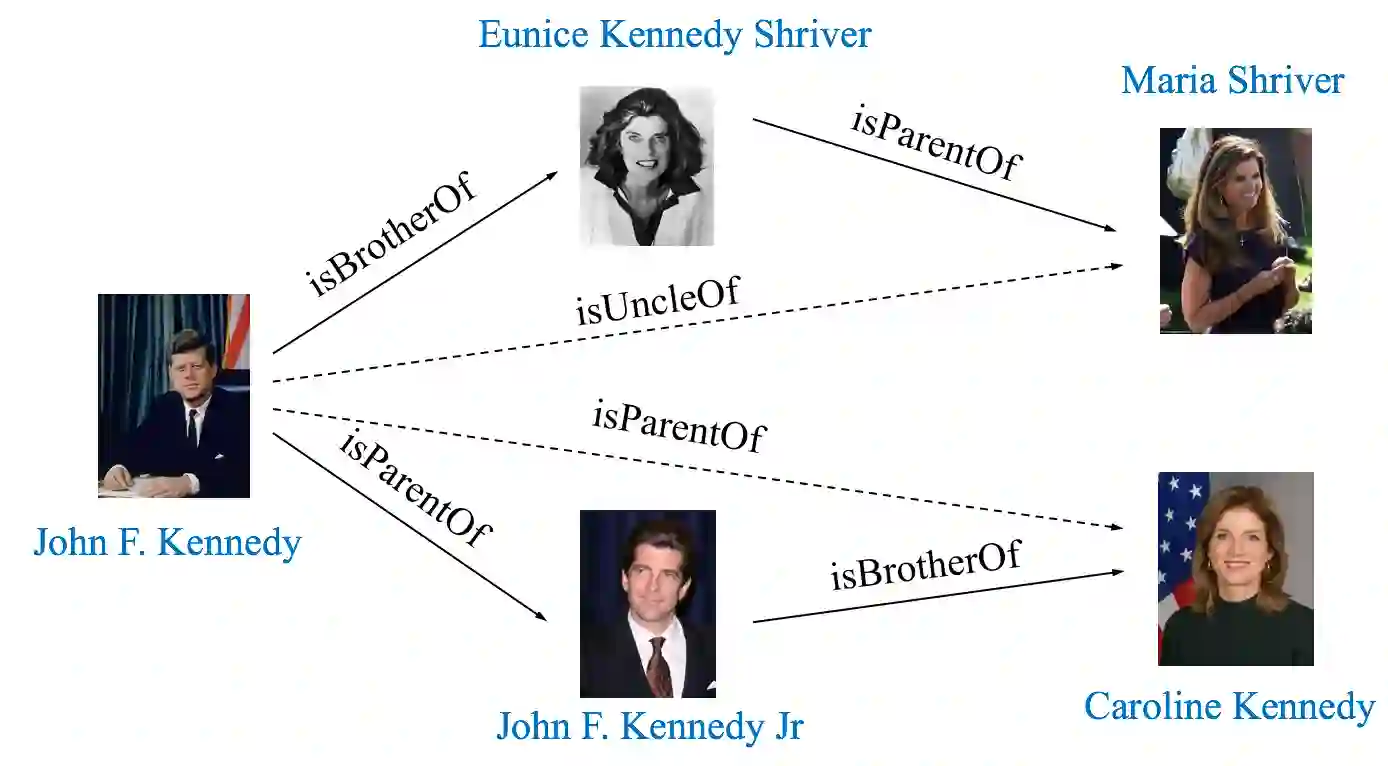

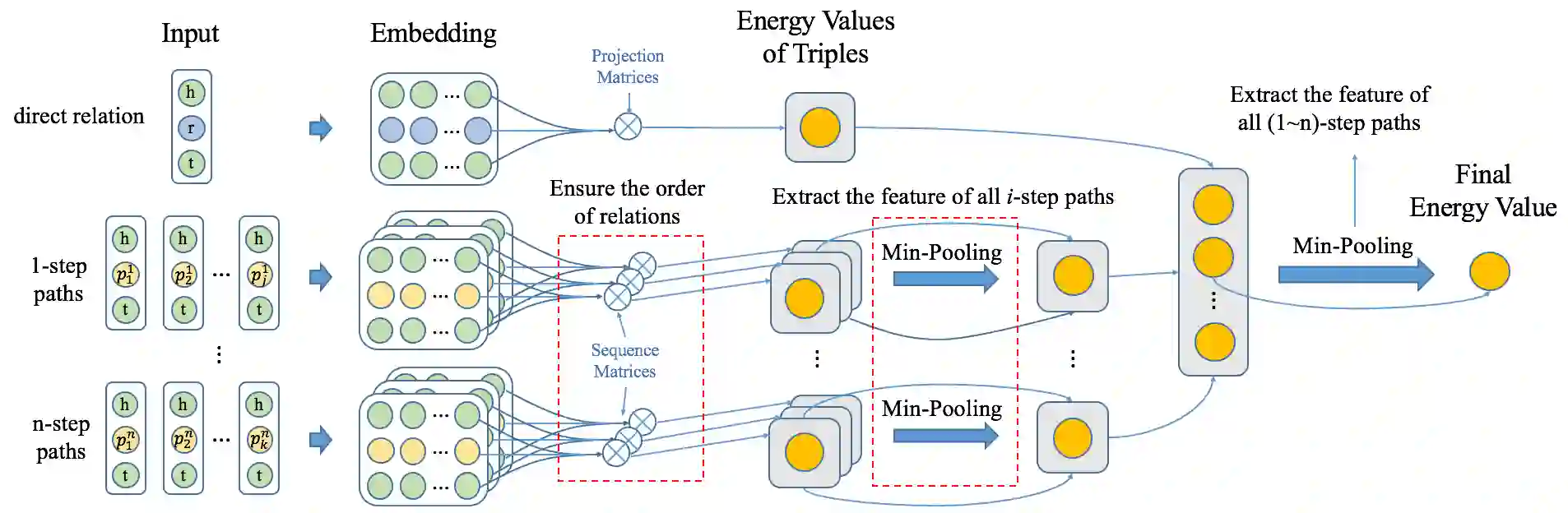

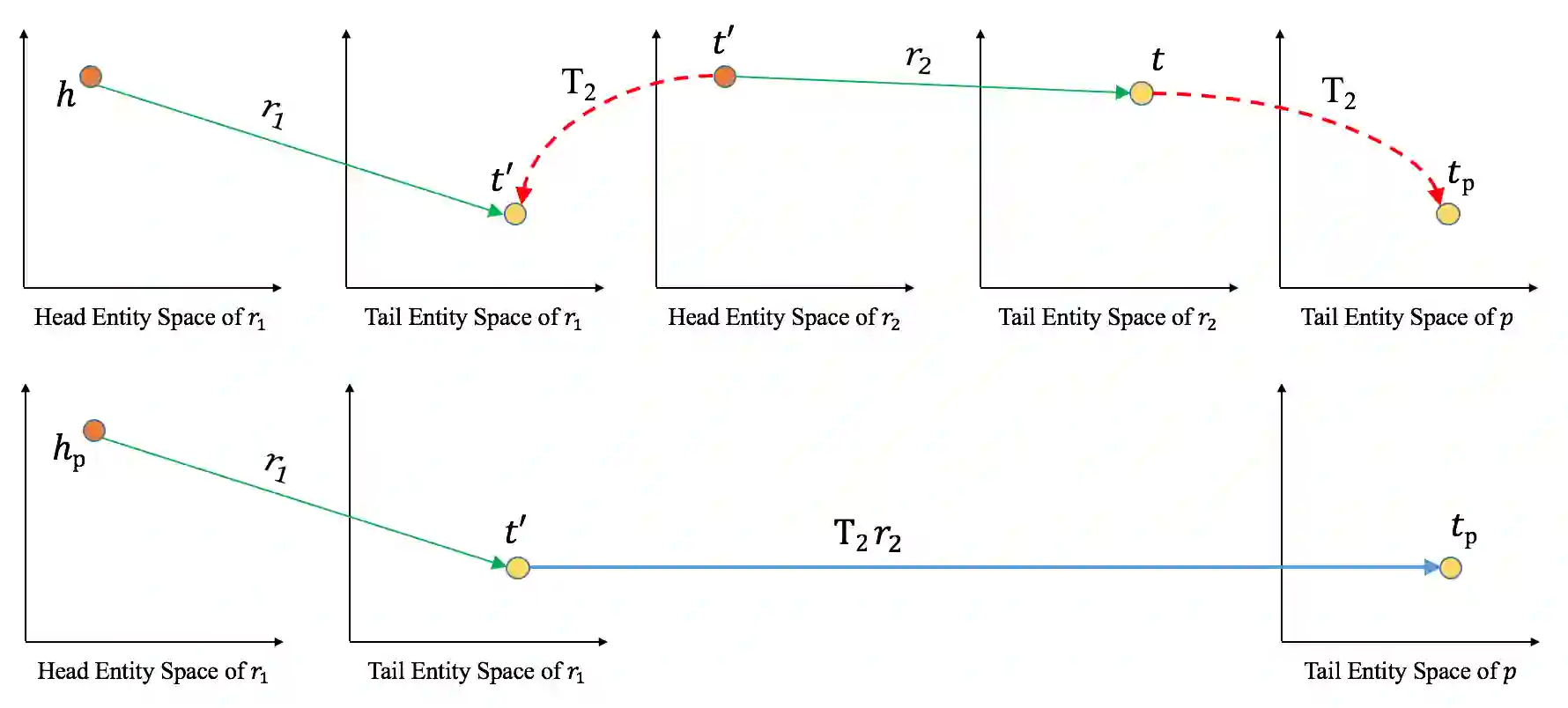

Incompleteness is a common problem for existing knowledge graphs (KGs), and the completion of KG which aims to predict links between entities is challenging. Most existing KG completion methods only consider the direct relation between nodes and ignore the relation paths which contain useful information for link prediction. Recently, a few methods take relation paths into consideration but pay less attention to the order of relations in paths which is important for reasoning. In addition, these path-based models always ignore nonlinear contributions of path features for link prediction. To solve these problems, we propose a novel KG completion method named OPTransE. Instead of embedding both entities of a relation into the same latent space as in previous methods, we project the head entity and the tail entity of each relation into different spaces to guarantee the order of relations in the path. Meanwhile, we adopt a pooling strategy to extract nonlinear and complex features of different paths to further improve the performance of link prediction. Experimental results on two benchmark datasets show that the proposed model OPTransE performs better than state-of-the-art methods.

翻译:对于现有知识图(KGs)来说,不完整是一个常见的问题,而旨在预测实体间联系的KG的完成是具有挑战性的。大多数现有的KG完成方法只考虑节点之间的直接关系,而忽略包含有用信息的联系路径,以便进行链接预测。最近,一些方法将关系路径考虑在内,但较少注意对推理很重要的路径关系顺序。此外,这些基于路径的模型总是忽视路径特性的非线性贡献,以便进行链接预测。为了解决这些问题,我们提议了一个名为OPTransE的新型KG完成方法。我们不把两个有关系的实体都嵌入与以往方法相同的潜伏空间,而是将每个关联的主体和尾端实体投入不同的空间,以保证路径关系的顺序。与此同时,我们采取联合战略,提取不同路径的非线性和复杂特征,以进一步改进连接预测的绩效。两个基准数据集的实验结果显示,拟议的OPTransE模型的表现优于最新方法。