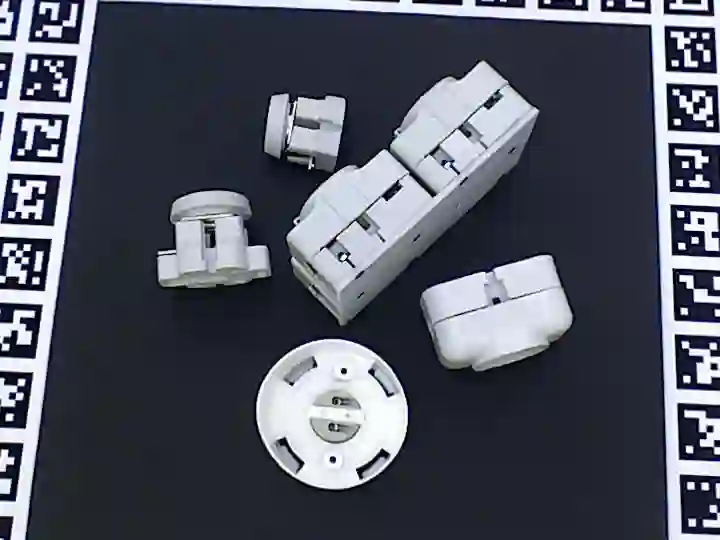

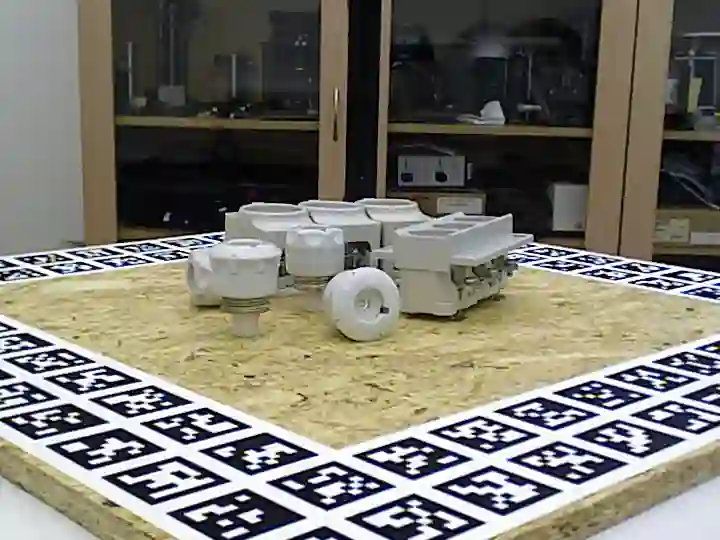

Few-shot object detection (FSOD) has thrived in recent years to learn novel object classes with limited data by transferring knowledge gained on abundant base classes. FSOD approaches commonly assume that both the scarcely provided examples of novel classes and test-time data belong to the same domain. However, this assumption does not hold in various industrial and robotics applications, where a model can learn novel classes from a source domain while inferring on classes from a target domain. In this work, we address the task of zero-shot domain adaptation, also known as domain generalization, for FSOD. Specifically, we assume that neither images nor labels of the novel classes in the target domain are available during training. Our approach for solving the domain gap is two-fold. First, we leverage a meta-training paradigm, where we learn the domain shift on the base classes, then transfer the domain knowledge to the novel classes. Second, we propose various data augmentations techniques on the few shots of novel classes to account for all possible domain-specific information. To constraint the network into encoding domain-agnostic class-specific representations only, a contrastive loss is proposed to maximize the mutual information between foreground proposals and class embeddings and reduce the network's bias to the background information from target domain. Our experiments on the T-LESS, PASCAL-VOC, and ExDark datasets show that the proposed approach succeeds in alleviating the domain gap considerably without utilizing labels or images of novel categories from the target domain.

翻译:近些年来,很少见的物体探测( FSOD) 蓬勃发展, 通过传授丰富基础类的知识, 学习新目标类, 并传授有限的数据。 FSOD 方法通常假定, 很少提供的新类和测试时间数据的例子属于同一领域。 但是, 这个假设并不存在于各种工业和机器人应用中, 模型可以从源域学习新类, 从目标域的分类中推断出。 在这项工作中, 我们处理对FSOD 进行零点域域适应的任务, 也称为域级通用。 具体类别演示时, 我们假设目标领域新类的图像和标签都没有提供。 我们解决域间差距的方法是两重的。 首先, 我们利用一个元培训模式, 我们学习基础类的域变换, 然后将域知识转移到新类的分类中。 我们提出了各种数据扩增技术, 以考虑所有可能的域域内特定信息。 将网络的域- 类别表显示差距, 将对比性损失缩小域域域域域图案, 以尽量扩大我们域域域域域域域域域域图的域域域图,, 以显示我们的域域域域域域域域域域域域域域域域域域域域域域图和域域域域域域域域域域域域域图, ; 显示内部域域域域域域域域域域图, ;