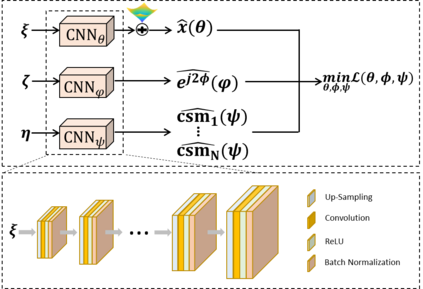

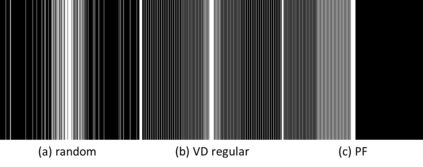

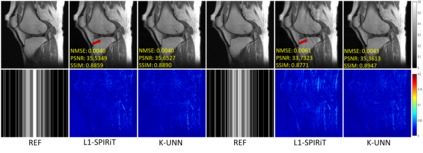

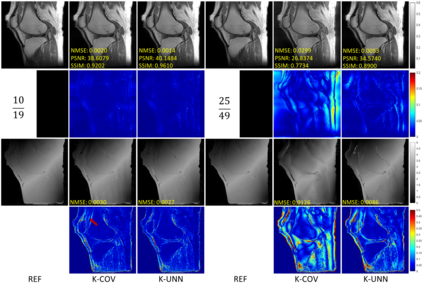

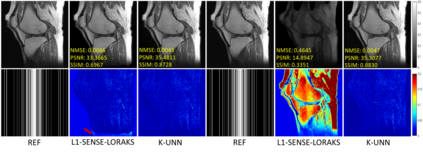

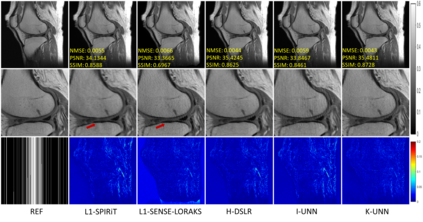

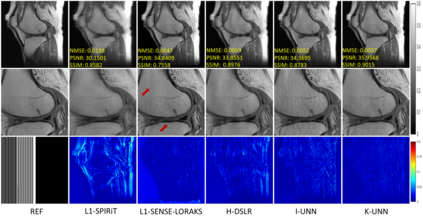

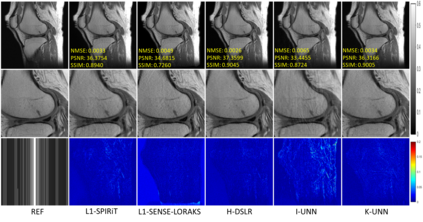

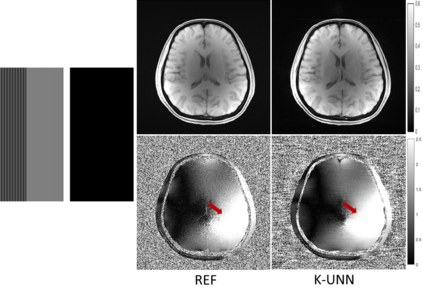

Recently, untrained neural networks (UNNs) have shown satisfactory performances for MR image reconstruction on random sampling trajectories without using additional full-sampled training data. However, the existing UNN-based approach does not fully use the MR image physical priors, resulting in poor performance in some common scenarios (e.g., partial Fourier, regular sampling, etc.) and the lack of theoretical guarantees for reconstruction accuracy. To bridge this gap, we propose a safeguarded k-space interpolation method for MRI using a specially designed UNN with a tripled architecture driven by three physical priors of the MR images (or k-space data), including sparsity, coil sensitivity smoothness, and phase smoothness. We also prove that the proposed method guarantees tight bounds for interpolated k-space data accuracy. Finally, ablation experiments show that the proposed method can more accurately characterize the physical priors of MR images than existing traditional methods. Additionally, under a series of commonly used sampling trajectories, experiments also show that the proposed method consistently outperforms traditional parallel imaging methods and existing UNNs, and even outperforms the state-of-the-art supervised-trained k-space deep learning methods in some cases.

翻译:最近,未经过培训的神经网络(UNNs)显示,在不使用其他完整培训数据的情况下,随机抽样轨迹的随机取样轨迹图像重建的MR图像重建工作表现令人满意;然而,基于UNN的现有方法没有充分利用MR图像物理前科,导致某些常见情景(如部分Fourier、定期取样等)的性能不佳,且缺乏重建准确性的理论保障;为弥合这一差距,我们提议对MRI采用一种有保障的K-空间间间插法,使用一个专门设计的UNN,由MR图像(或K-空间数据)的三个物理前科驱动的建筑结构增加了三倍,包括宽度、灵敏度平滑和阶段平滑。我们还证明,拟议的方法保证了内插K-空间数据的准确性。最后,通缩实验表明,拟议的方法比现有传统方法更准确地描述MR图像的物理前科。此外,在一系列常用的取样轨迹下,实验还表明,拟议的方法始终比传统的平行成像法和现有的联合国深空系统学习案例。