【泡泡图灵智库】基于上采样预积分测量值的3D Lidar-IMU校准来矫正运动失真

泡泡图灵智库,带你精读机器人顶级会议文章

标题:3D Lidar-IMU Calibration based on Upsampled Preintegrated Measurements for Motion Distortion Correction

作者:Cedric Le Gentil, Teresa Vidal-Calleja and Shoudong Huang

来源:ICRA 2018

播音员:

编译:林瑞豪

审核:张蕾

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——基于上采样预积分测量值的3D Lidar-IMU校准来矫正运动失真,该文章发表于ICRA 2018。

在这篇文章中,我们提出了一个概率框架来补偿Lidar-IMU感知系统的外部参数校准。与全局快门相机不同,激光雷达无法获取环境的单个快照。相反,激光雷达会收集一系列3D点,这些点以单个扫描为单位进行分组。如果假设这些点在公共帧中表示,则当传感器在环境中快速移动导致运动失真时,会产生误差。我们提出的框架的基本思想是预积分插值后的惯性测量值来表征每个激光雷达扫描中的运动失真。此外,通过使用一组平面作为校准目标,本文的方法利用激光雷达点到平面距离为输入,使用流形上优化来联合校准和定位系统。校准不依赖于预定目标,因为在第一个激光雷达扫描中,随机平面被检测到并建模。仿真和真实数据被用于验证所提出方法的有效性。

主要贡献

提出了一个概率公式来联合校准和定位lidar-IMU系统。预积分插值后的IMU数据,我们的公式提供了精确的步骤来移除3D点云中的运动失真。每个激光雷达的点被重投影到激光雷达的第一帧并计算点到平面的距离。流形上的优化用于恢复校准参数和IMU位姿、速度、偏置和时间漂移。

算法流程

1、我们的方法希望估计两个传感器的外部校准参数和IMU位姿、速度、偏置和时间漂移。

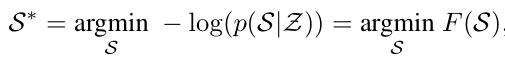

标定问题公式化为一个最大似然估计:

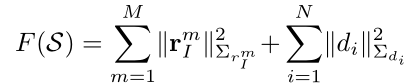

IMU预积分测量值:

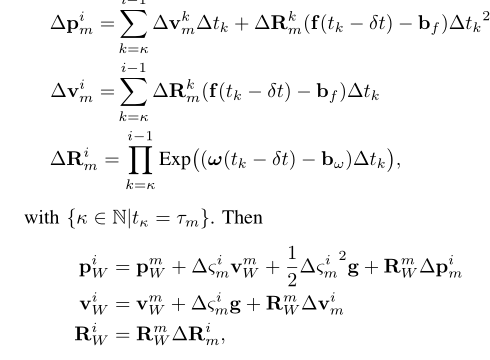

1.1 雷达因子

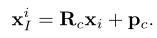

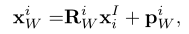

雷达点云到地图的重投影误差被作为雷达因子。首先,每个雷达点云被投影到IMU坐标系:

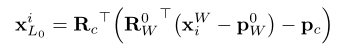

然后,投影到世界坐标系:

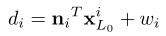

得到点到平面的距离:

1.2 IMU因子

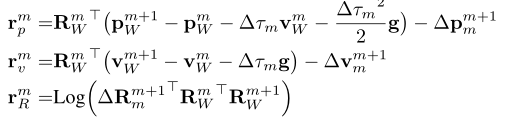

IMU因子是对IMU位姿和速度的约束。联合残差计算如下:

1.3 基于上采样IMU测量的预积分

雷达点云的数据速率比IMU要高,并且传感器没有同步,我们需要对原始的IMU数据进行插值。GP回归不只用于估计上采样测量值及其联合不确定性,也可以用于滤除原始数据中的高频噪声。

1.4 偏置和时间偏移

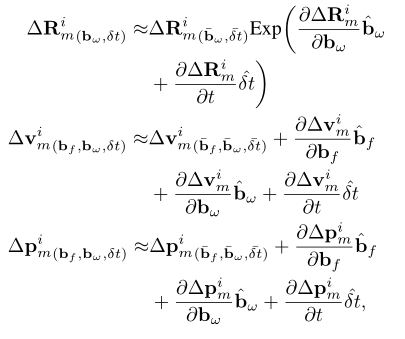

在任何优化之前,假设完全了解偏差和时移,预处理预积分项。这个假设一般不成立。为了解决这个问题,我们采用了一阶扩展,作为我们方法的偏差校正。

1.5 面分割和数据关联

在每一帧的激光点云中,使用基于RANSAC的平面拟合算法检测P个平面。点到平面的数据关联是一个迭代步骤,用来处理连续的两帧点云中检测到的平面法向量。这个迭代步骤将每个雷达点云和地图中的一个平面联系在一起。

主要结果

1、 仿真

1.1 噪声敏感性:

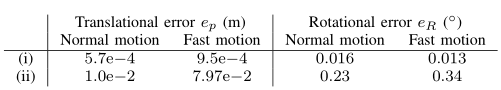

图1 在不同的噪声配置下的标定精度

1.2 雷达噪声敏感性:

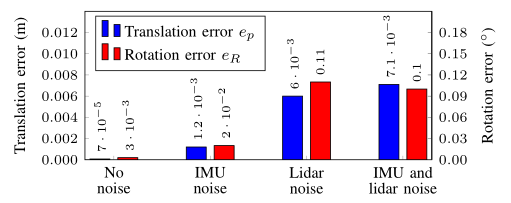

图2 不同雷达噪声下的标定精度。在这些实验中,惯导数据仿真为没有噪声。

1.3 上采样预积分测量值

图3 模型(i)使用了上采样预积分测量值而(ii)没有

2、 真实数据

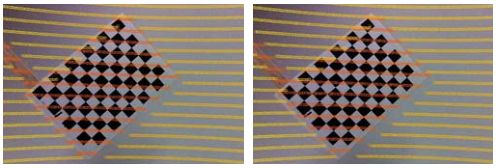

图4 左:在雷达-相机外部标定后,重投影雷达点到图像平面上;右:链式地标定lidar-imu,imu-camera后,重投影雷达点到图像平面上

Abstract

In this paper, we present a probabilistic framework to recover the extrinsic calibration parameters of a lidar- IMU sensing system. Unlike global-shutter cameras, lidars do not take single snapshots of the environment. Instead, lidars collect a succession of 3D-points generally grouped in scans. If these points are assumed to be expressed in a common frame, this becomes an issue when the sensor moves rapidly in the environment causing motion distortion. The fundamental idea of our proposed framework is to use preintegration over interpolated inertial measurements to characterise the motion distortion in each lidar scan. Moreover, by using a set of planes as a calibration target, the proposed method makes use of lidar point-to-plane distances to jointly calibrate and localise the system using on-manifold optimisation. The calibration does not rely on a predefined target as arbitrary planes are detected and modelled in the first lidar scan. Simulated and real data are used to show the effectiveness of the proposed method.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com