【泡泡一分钟】精确的农田无人机图像的长期鲁棒配准

每天一分钟,带你读遍机器人顶级会议文章

标题:Robust Long-Term Registration of UAV Images of Crop Fields for Precision Agriculture

作者:Nived Chebrolu Thomas Labe Cyrill Stachniss

来源:2018 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS)

编译:章绩伟

审核:颜青松,陈世浪

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

连续农作物监测是精准农业的一个重要方面并且需要在较长时间内对传感器数据进行配准。 通常,使用安装在无人驾驶飞行器(UAV)上的摄像机监视农田,但是生长的农作物和农田的视觉外观的强烈变化对传统的图像配准方法提出了严峻的挑战。

在本文中,我们提出了一种方法用于记录无人机在农作物生长季节拍摄的农田图像,并提供一个完整的流程用于计算田地的时间对齐3D点云。我们的方法利用了田间作物分布的固有几何形状,随着时间的推移这种农作物分布大部分是静态的。 这使我们即使在强烈的视觉变化的情况下也可以记录图像。 最后,我们提出了一种尺度不变的几何特征描述符,它对当地的植物排列几何形状进行编码。 实验表明,我们能够记录在农作物生长季节拍摄的图像,包括与现有的视觉描述符匹配失败的情况。 我们评估匹配系统在手动标记的地面实况方面的准确性。 我们进一步说明重建的3D模型在定性上是正确的,并且配准结果允许监测每个植物水平的生长参数。

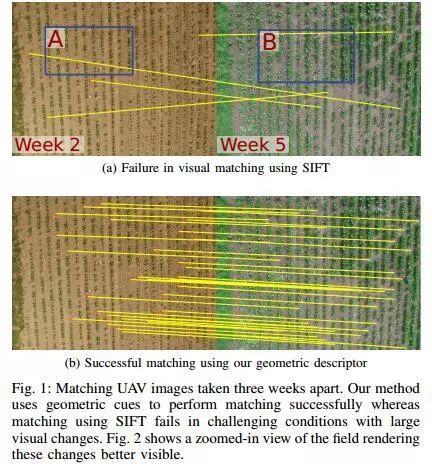

图1 a图匹配了三个星期相隔的无人机图像。 我们的方法使用几何线索成功执行匹配,而使用SIFT进行匹配在具有大视觉变化的挑战条件下失败。 b图显示了字段的放大视图,使这些更改更加清晰可见。

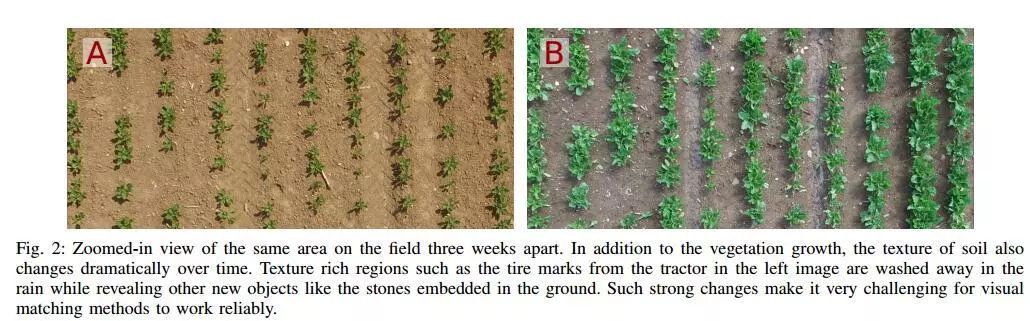

图2 三周之后放大了对场地同一区域的视野。 除了植被生长,土壤质地也随着时间的推移而发生显着变化。 纹理丰富的区域,例如左图中拖拉机的轮胎标记,在雨中被冲走,同时露出其他新物体,如嵌入地面的石头。 如此强烈的变化使得视觉匹配方法可靠地工作非常具有挑战性。

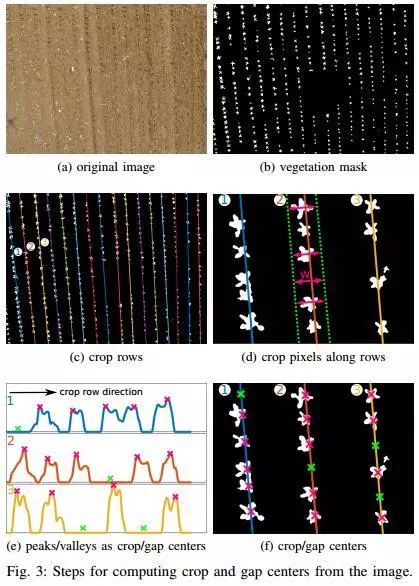

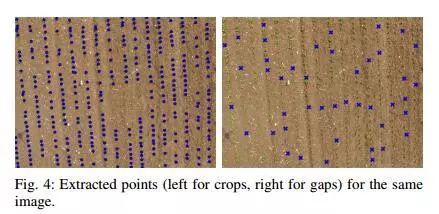

图3 从图像计算作物和间隙中心的步骤。

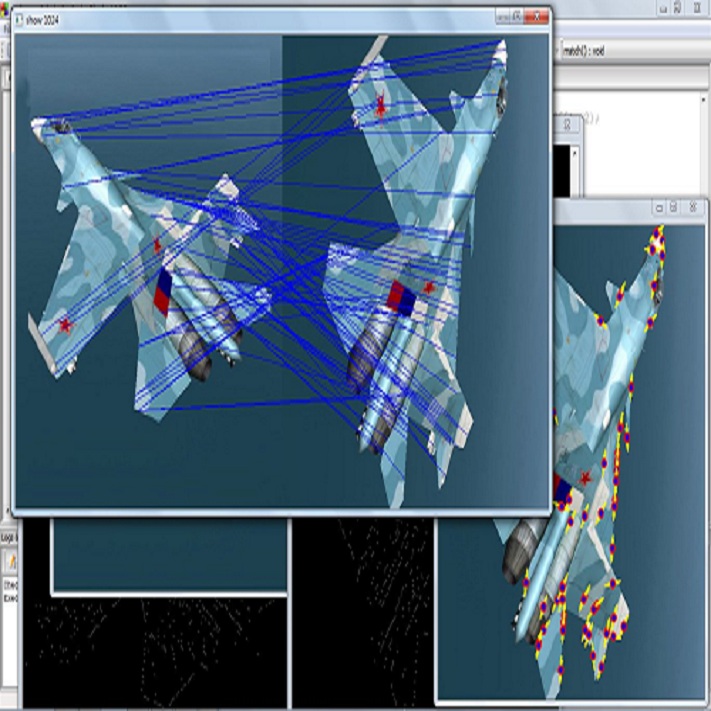

图4 同一图像的提取点(作物的左侧,间隙为右侧)。

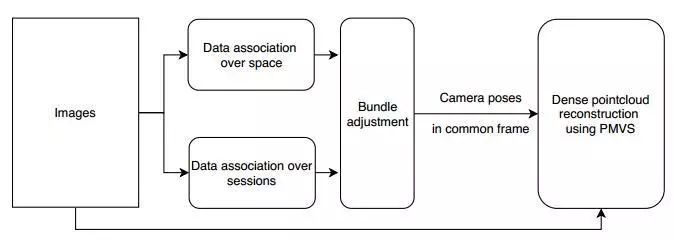

图5 3D重建过程显示用于计算来自不同模块时间对齐点云的步骤

Abstract

Continuous crop monitoring is an important aspect of precision agriculture and requires the registration of sensor data over longer periods of time. Often, fields are monitored using cameras mounted on unmanned aerial vehicles (UAVs) but strong changes in the visual appearance of the growing crops and the field itself poses serious challenges to conventional image registration methods. In this paper, we present a method for registering images of agricultural fields taken by an UAV over the crop season and present a complete pipeline for computing temporally aligned 3D point clouds of the field. Our approach exploits the inherent geometry of the crop arrangement in the field, which remains mostly static over time. This allows us to register the images even in the presence of strong visual changes. To this end, we propose a scale-invariant, geometric feature descriptor that encodes the local plant arrangement geometry. The experiments suggest that we are able to register images taken over the crop season, including situations where matching with an off-theshelf visual descriptor fails. We evaluate the accuracy of our matching system with respect to manually labeled ground truth. We furthermore illustrate that the reconstructed 3D models are qualitatively correct and the registration results allow for monitoring growth parameters at a per plant level.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com