【泡泡一分钟】扫描环境:用于3D点云地图中场景识别的自我中心空间描述符

每天一分钟,带你读遍机器人顶级会议文章

标题:Scan Context: Egocentric Spatial Descriptor for Place Recognition within 3D Point Cloud Map

作者:Giseop Kim, Ayoung Kim

来源:2018 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS)

编译:张宁

审核:颜青松,陈世浪

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

与用于视觉场景的各种特征检测器和描述符相比,使用结构信息描述地点的报道相对较少。同步定位和地图构建(SLAM)的最新进展提供了密集的环境3D地图,并且由不同的传感器提出了定位。针对基于结构信息的全局定位,我们提出了扫描上下文,一种来自3D光检测和测距(LiDAR)扫描的基于非直方图的全局描述符。

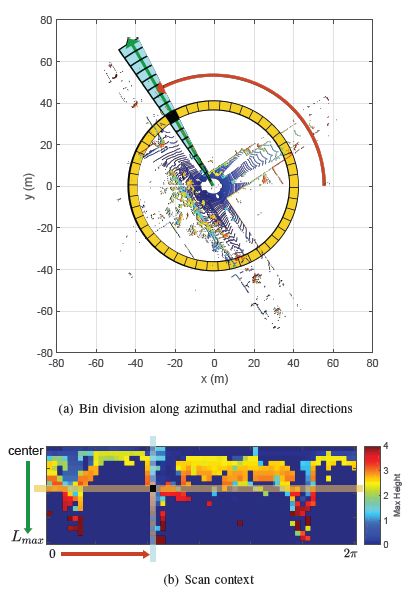

图1 两步扫描环境创建

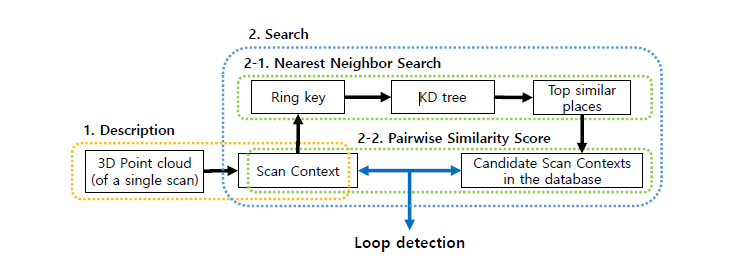

与先前提出的方法不同,本文所提出的方法直接记录来自传感器的可见空间的3D结构,并且不依赖于直方图或先前的训练。另外,该方法提出使用相似性得分来计算两个扫描环境之间的距离,并且还提出用于有效地检测回环的两阶段搜索算法。

图2 回环检测算法架构

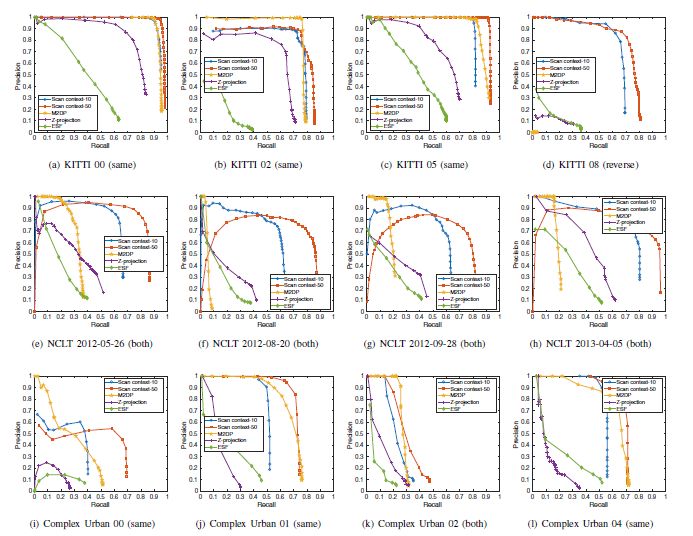

与使用点云的现有全局描述符相比,扫描上下文在各种数据集中显示出更高的环路检测性能。

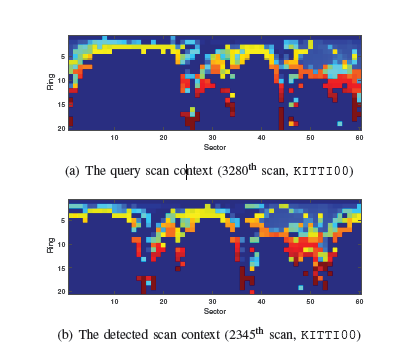

图3 来自具有时间间隔的相同位置的扫描环境的示例。

图4 评估数据集的精确回忆曲线。重新访问期间的路线方向显示在括号中。

Abstract

Compared to diverse feature detectors and descriptors used for visual scenes, describing a place using structural information is relatively less reported. Recent advances in simultaneous localization and mapping (SLAM) provides dense 3D maps of the environment and the localization is proposed by diverse sensors. Toward the global localization based on the structural information, we propose Scan Context, a nonhistogram-based global descriptor from 3D Light Detection and Ranging (LiDAR) scans. Unlike previously reported methods, the proposed approach directly records a 3D structure of a visible space from a sensor and does not rely on a histogram or on prior training. In addition, this approach proposes the use of a similarity score to calculate the distance between two scan contexts and also a two-phase search algorithm to efficiently detect a loop. Scan context and its search algorithm make loopdetection invariant to LiDAR viewpoint changes so that loops can be detected in places such as reverse revisit and corner. Scan context performance has been evaluated via various benchmark datasets of 3D LiDAR scans, and the proposed method shows a sufficiently improved performance.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com