【泡泡点云时空】完美配准:具有平滑密度的3D点云配准

泡泡点云时空,带你精读点云领域顶级会议文章

标题:The Perfect Match: 3D Point Cloud Matching with Smoothed Densities

作者:Zan Gojcic, Caifa Zhou, Jan D. Wegner, Andreas Wieser

来源:arxiv2019

编译:邹正

审核:徐二帅,吕佳俊

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

我们提出了3DSmoothNet,这是一个完整的3D点匹配工作流程,该流程使用siamese深度学习框架,并使用体素平滑密度值(SDV)表示完全卷积层。后者根据兴趣点计算并与局部参考帧(LRF)对齐以实现旋转不变性。在3DMatch数据集上使用该方法,我们构建了紧凑的,基于学习的和具有旋转不变性质的32维度3D点云描述符,获得94.9%的平均召回率,效果超过目前最优方法20%。这种非常低的特征输出维度允许算法在标准PC上以每个特征点0.1ms的速度进行近实时对应搜索。 我们的方法与传感器和场景无关,因为SDV,LRF和学习高度描述性特征过程都在完全卷积层中完成。论文的实验结果表明,只利用建筑物室内的RGB-D数据对3D平滑网络进行训练,在室外植被激光扫描场景中的平均召回率可达到79%,该性能比那些以学习为基础的3D点匹配方法性能方面提高了一倍以上。代码、数据和预训练模型参考网址:https://github.com/zgojcic/3DSmoothNet

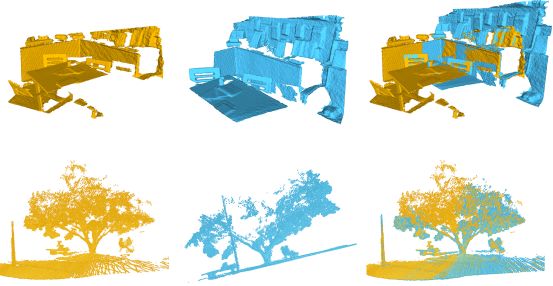

图1 3D平滑网络的泛化特性:该方法得到的描述子仅在室内场景进行训练(上图),可以无缝的推广到户外场景中(下图)。

主要贡献

本文的主要贡献如下:

提出了一种用于3D点云配准的局部特征描述子,它是一种紧凑学习型描述子,可以高效计算,且效果明显优于现有方法;

提出了一个具有完全卷积层的连体网络架构,它学习了非常紧凑的、具有旋转不变性的3D局部特征描述子;

对本文提出的低维特征描述子(只有16或32个输出尺寸)进行了演示,它能够大大加快对应搜索,从而实现实时应用。

算法流程

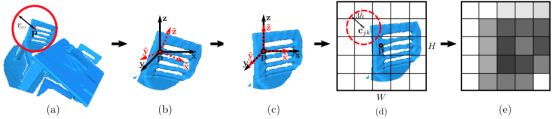

图2 输入参数:(a)利用(b)中计算出的LRF来提取兴趣点p周边的球状区域S;(c)每个数据立方体都转化为其标准的表示形式;(d)使用高斯平滑核进行体素化;(e)标准化后的3D SDV体素网格作为3DSmoothNet的输入。

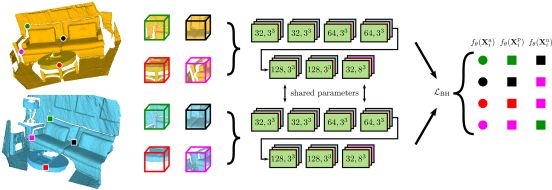

图3 3DSmoothNet的网络架构:我们先在两个片段的重叠区域中提取兴趣点。再以兴趣点为中心,得到每个兴趣点对应的立方体贴片(边界框用感兴趣点进行颜色编码),这些立方体贴片都与计算出来的LRF估计值对齐,并被转换为SDV体素网格,最终作为网络的输入。3DSmoothNet由卷积(绿色矩形),批标准化(橙色),ReLU激活函数(蓝色)和L2范数(品红)层组成。两个分支共享所有的参数。

主要结果

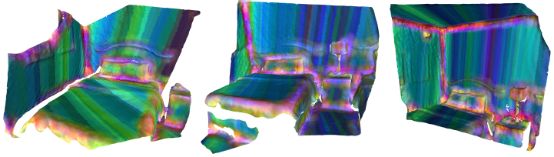

图4 3DSmoothNet描述子是具有几何信息的:通过PCA方法嵌入到3D空间(前三个组件通过RGB颜色编码)。平面区域位于蓝绿色光谱、橙色-粉红色光谱的边缘和角落,球形表面位于黄色光谱中。

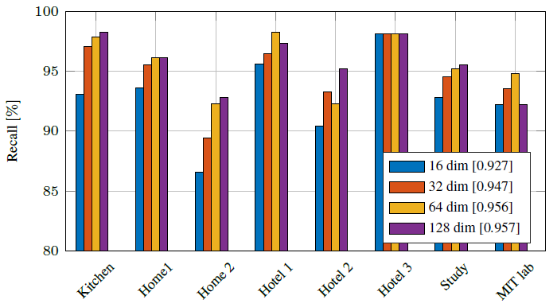

图5 召回率和3DSmoothNet输出维度间的关系,括号里的值表示所有场景的平均召回率.

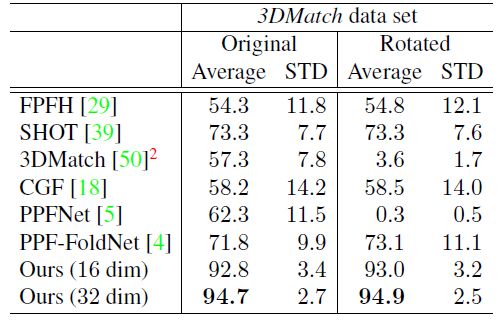

表1 3DMatch和3DRotatedMatch数据的结果。该表格展示了所有场景的平均召回率以及每种方法的标准偏差(STD),效果最好的用粗体显示。

Abstract

We propose 3DSmoothNet, a full workflow to match 3D point clouds with a siamese deep learning architecture and fully convolutional layers using a voxelized smoothed density value (SDV) representation. The latter is computed per interest point and aligned to the local referenceframe (LRF) to achieve rotation invariance. Our compact,learned, rotation invariant 3D point cloud descriptor achieves 94:9% average recall on the 3DMatch benchmark data set [50], outperforming the state-of-the-art bymore than 20 percent points with only 32 output dimensions.This very low output dimension allows for near realtime correspondence search with 0.1 ms per feature point on a standard PC. Our approach is sensor- and sceneagnostic because of SDV, LRF and learning highly descriptive features with fully convolutional layers. We show that 3DSmoothNet trained only on RGB-D indoor scenes of buildings achieves 79:0% average recall on laser scans of outdoor vegetation, more than double the performance of our closest, learning-based competitors[50, 18, 5, 4].Code, data and pre-trained models are available online at https://github.com/zgojcic/3DSmoothNet

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com