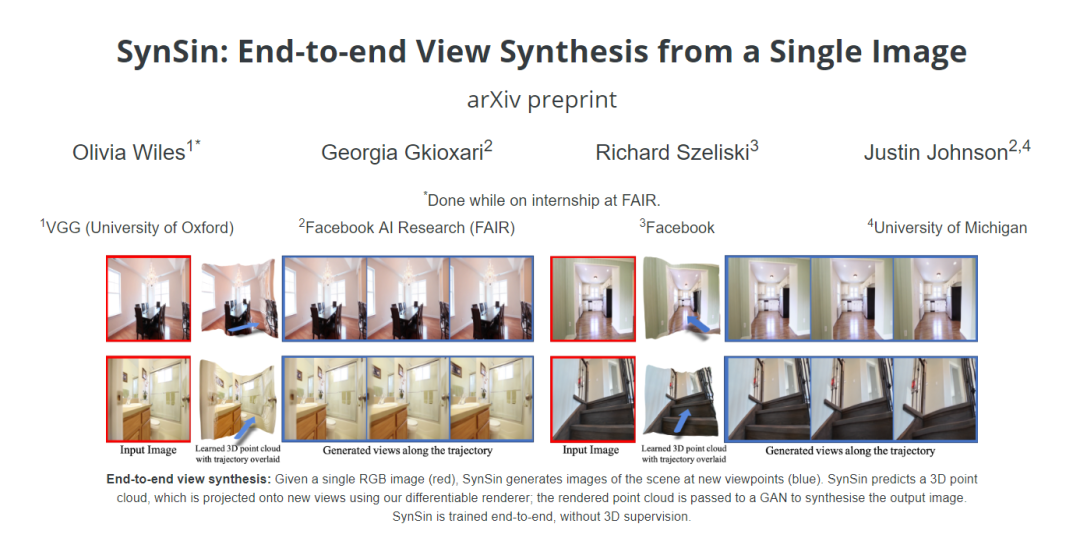

我们提出了一种单一图像视图合成方法,允许从单一输入图像生成新的场景视图。这是一个挑战,因为它需要从一个单一的图像全面理解3D场景。因此,目前的方法通常使用多幅图像,在地面真实深度上训练,或者局限于合成数据。为此,我们提出了一种新颖的端到端模型;它被训练在真实的图像上,没有使用任何真实的3D信息。为此,我们引入了一种新的可微点云渲染器,用于将潜在的3D点云特征转换为目标视图。我们的细化网络对投影特征进行解码,插入缺失区域,生成逼真的输出图像。我们的生成模型内部的3D组件允许在测试时对潜在特征空间进行可解释的操作,例如,我们可以从单个图像动画轨迹。与以前的工作不同,我们可以生成高分辨率的图像,并推广到其他输入分辨率。我们在Matterport、Replica和RealEstate10K数据集上超越基线和前期工作。

成为VIP会员查看完整内容

相关内容

CVPR is the premier annual computer vision event comprising the main conference and several co-located workshops and short courses. With its high quality and low cost, it provides an exceptional value for students, academics and industry researchers.

CVPR 2020 will take place at The Washington State Convention Center in Seattle, WA, from June 16 to June 20, 2020.

http://cvpr2020.thecvf.com/

专知会员服务

24+阅读 · 2020年4月4日

专知会员服务

22+阅读 · 2020年3月18日

Arxiv

5+阅读 · 2019年2月14日