XLM-K:通过多语言知识库提高跨语言预训练模型

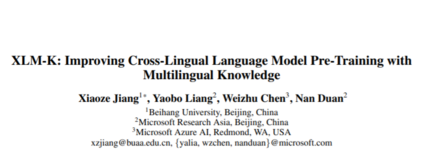

XLM-K: Improving Cross-Lingual Language Model Pre-Training with Multilingual Knowledge

https://www.zhuanzhi.ai/paper/f50b1d5ba3d41d06328348865c1549ea

论文摘要:

跨语言预训练的目标是提高模型在语言之间的迁移能力,使模型可以在一种语言上训练,然后在其他语言上直接测试。之前跨语言模型的能力主要来源于单语和双语的普通文本。我们的工作首次提出从多语言的知识库中来学习跨语言能力。我们提出了两个新的预训练任务:掩码实体预测和客体推理。这两个任务可以帮助模型实现更好的跨语言对齐,以及让模型更好的记忆知识。在具体任务上的测试表明了我们的模型可以显著提高知识相关的任务的性能,知识探针任务证明了我们模型更好的记忆了知识库。

论文开创性突破与核心贡献:利用结构化的多语言知识库来提升预训练模型,让模型通过掌握知识来提升跨语言迁移能力。

成为VIP会员查看完整内容