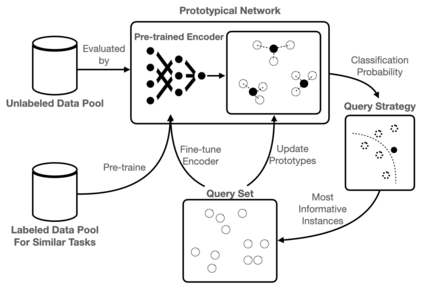

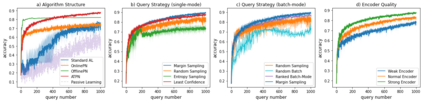

The paucity of labeled data is a typical challenge in the automotive industry. Annotating time-series measurements requires solid domain knowledge and in-depth exploratory data analysis, which implies a high labeling effort. Conventional Active Learning (AL) addresses this issue by actively querying the most informative instances based on the estimated classification probability and retraining the model iteratively. However, the learning efficiency strongly relies on the initial model, resulting in the trade-off between the size of the initial dataset and the query number. This paper proposes a novel Few-Shot Learning (FSL)-based AL framework, which addresses the trade-off problem by incorporating a Prototypical Network (ProtoNet) in the AL iterations. The results show an improvement, on the one hand, in the robustness to the initial model and, on the other hand, in the learning efficiency of the ProtoNet through the active selection of the support set in each iteration. This framework was validated on UCI HAR/HAPT dataset and a real-world braking maneuver dataset. The learning performance significantly surpasses traditional AL algorithms on both datasets, achieving 90% classification accuracy with 10% and 5% labeling effort, respectively.

翻译:标签数据缺乏是汽车工业的一个典型挑战。说明时间序列测量需要可靠的域内知识和深入探索性数据分析,这意味着要做出很高的标签努力。常规积极学习(AL)通过根据估计分类概率积极查询最信息实例和对模型进行迭代再培训来解决这一问题。然而,学习效率在很大程度上依赖初始模型,从而在初始数据集的大小和查询数字之间取舍。本文提议了一个基于小点点学习(FSL)的AR框架,通过在AL迭代中加入一个Protodom 网络(ProtoNet)来解决交易问题。结果显示,一方面,在初始模型的稳健性方面有所改进,另一方面,通过积极选择每个迭代的成套支持来提高ProtoNet的学习效率。这个框架在UCI HAR/HAPT数据集和真实世界制动调控数据集上得到了验证。学习成绩大大超过传统AL在数据集中的算法,分别实现了90%和5%的精确度。