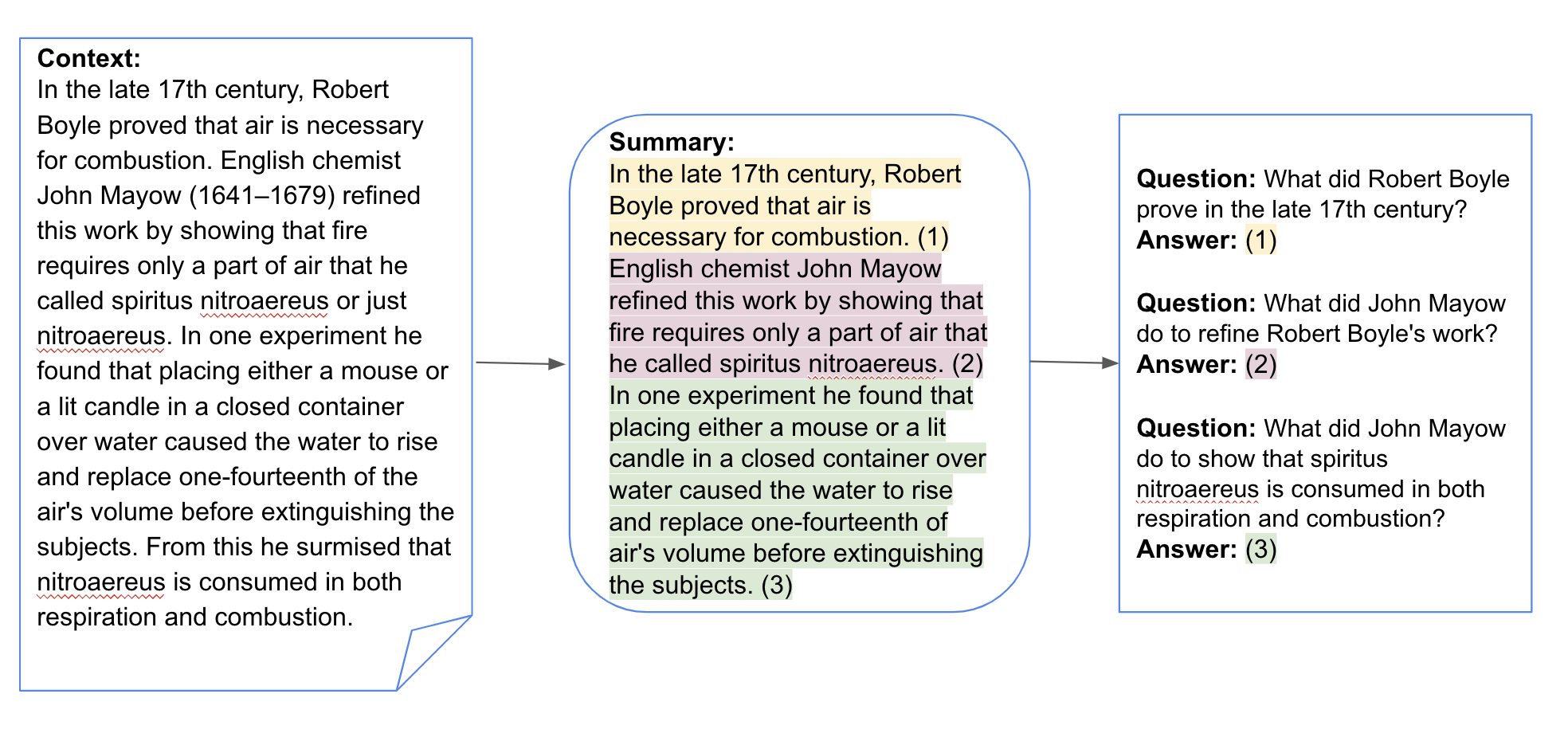

Asking good questions is an essential ability for both human and machine intelligence. However, existing neural question generation approaches mainly focus on the short factoid type of answers. In this paper, we propose a neural question generator, MixQG, to bridge this gap. We combine 9 question answering datasets with diverse answer types, including yes/no, multiple-choice, extractive, and abstractive answers, to train a single generative model. We show with empirical results that our model outperforms existing work in both seen and unseen domains and can generate questions with different cognitive levels when conditioned on different answer types. Our code is released and well-integrated with the Huggingface library to facilitate various downstream applications.

翻译:问好的问题是人类和机器智能的基本能力。 但是, 现有的神经问题生成方法主要侧重于短期事实类解答类型。 在本文中, 我们建议使用神经问题生成器MixQG来弥补这一差距。 我们将9个问题解答数据集与不同答案类型相结合, 包括是/ 不、 多重选择、 采掘和抽象答案, 以训练单一的基因化模型。 我们用经验显示, 我们的模型在可见和无形领域都比现有工作效果好, 当以不同答案类型为条件时, 可以产生不同认知水平的问题 。 我们的代码已经发布, 并且和 Huggingface 图书馆紧密结合, 以便利各种下游应用 。