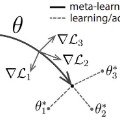

The potential market for modern self-driving cars is enormous, as they are developing remarkably rapidly. At the same time, however, accidents of pedestrian fatalities caused by autonomous driving have been recorded in the case of street crossing. To ensure traffic safety in self-driving environments and respond to vehicle-human interaction challenges such as jaywalking, we propose Level-$k$ Meta Reinforcement Learning (LK-MRL) algorithm. It takes into account the cognitive hierarchy of pedestrian responses and enables self-driving vehicles to adapt to various human behaviors. %which takes into account pedestrian responses while learning the optimal strategies. As a self-driving vehicle algorithm, the LK-MRL combines level-$k$ thinking into MAML to prepare for heterogeneous pedestrians and improve intersection safety based on the combination of meta-reinforcement learning and human cognitive hierarchy framework. We evaluate the algorithm in two cognitive confrontation hierarchy scenarios in an urban traffic simulator and illustrate its role in ensuring road safety by demonstrating its capability of conjectural and higher-level reasoning.

翻译:现代自行驾驶汽车的潜在市场是巨大的,因为它们正在迅速发展。但与此同时,在街头过境时记录了自驾驾驶造成的行人死亡事故。为了确保自行驾驶环境中的交通安全,并应对汽车与人之间的交互挑战,例如行车横行等,我们建议采用“水平-千美元”的“元强化学习”算法(LK-MRL),其中考虑到行人反应的认知等级,使自驾车辆能够适应人类的各种行为。%在学习最佳战略时会考虑到行人的反应。作为自行驾驶车辆算法,LK-MRL将“水平-k$”的思维结合到MAML中,为多行人做好准备,并根据超强力学习和人类认知等级框架的结合,改善交叉安全。我们评估城市交通模拟器两种认知对立等级假设的算法,并通过展示其预测和更高层次推理能力来说明其在确保道路安全方面的作用。