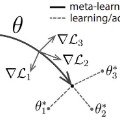

Personalizing a speech synthesis system is a highly desired application, where the system can generate speech with the user's voice with rare enrolled recordings. There are two main approaches to build such a system in recent works: speaker adaptation and speaker encoding. On the one hand, speaker adaptation methods fine-tune a trained multi-speaker text-to-speech (TTS) model with few enrolled samples. However, they require at least thousands of fine-tuning steps for high-quality adaptation, making it hard to apply on devices. On the other hand, speaker encoding methods encode enrollment utterances into a speaker embedding. The trained TTS model can synthesize the user's speech conditioned on the corresponding speaker embedding. Nevertheless, the speaker encoder suffers from the generalization gap between the seen and unseen speakers. In this paper, we propose applying a meta-learning algorithm to the speaker adaptation method. More specifically, we use Model Agnostic Meta-Learning (MAML) as the training algorithm of a multi-speaker TTS model, which aims to find a great meta-initialization to adapt the model to any few-shot speaker adaptation tasks quickly. Therefore, we can also adapt the meta-trained TTS model to unseen speakers efficiently. Our experiments compare the proposed method (Meta-TTS) with two baselines: a speaker adaptation method baseline and a speaker encoding method baseline. The evaluation results show that Meta-TTS can synthesize high speaker-similarity speech from few enrollment samples with fewer adaptation steps than the speaker adaptation baseline and outperforms the speaker encoding baseline under the same training scheme. When the speaker encoder of the baseline is pre-trained with extra 8371 speakers of data, Meta-TTS can still outperform the baseline on LibriTTS dataset and achieve comparable results on VCTK dataset.

翻译:语音合成系统个性化是一个非常理想的应用程序, 该系统可以用用户的声音生成语音, 注册记录很少。 在最近的作品中, 有两种主要方法可以建立这样的系统: 演讲者适应和用扬声器编码。 一方面, 演讲者调整方法微调一个训练有素的多发音文本到语音的模型, 注册样本很少。 但是, 它们需要至少数千个微调步骤来进行高质量的适应, 使得它难以应用于设备。 另一方面, 演讲者编码方法可以将录入的音量缩略语嵌入一个演讲者嵌入。 经过训练的 TTS 模型可以以相应的演讲者嵌入为条件, 将用户的演讲者发言流发送出去。 尽管如此, 演讲者调制的调制方法因所见者与隐蔽的演讲者之间的一般化差距而受到影响。 更具体地说, 我们使用模型Agnotic met- Lain( MAML) 来进行高音员调, 多发音员升级的TTTT 模型可以找到一个伟大的元化模型, 和高发者调的MTLM 数据 。 因此, 我们还可以用双声器的基调方法 。