【泡泡图灵智库】视觉语义里程计(ECCV)

泡泡图灵智库,带你精读机器人顶级会议文章

标题:VSO: Visual Semantic Odometry

作者:Konstantinos-Nektarios Lianos, Marc Pollefeys, Johannes L. Scho ̈nberger, Torsten Sattler

来源:ECCV2018

编译:刘小亮

审核:黄文超

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——视觉语义里程计,该文章发表于ECCV2018。

鲁棒地数据联合是视觉里程计中的一个核心问题,其中图像到图像的对应关系为相机位姿和地图估计提供了约束。当前最前沿的直接和间接法都使用短期的跟踪来获取连续的帧到帧的约束,而使用闭环检测来建立长期的约束。在本文中,我们提出了全新的视觉语义里程计(VSO)框架,使得能使用语义进行中长期的连续点跟踪。我们提出的框架可容易的被整合到现有的直接或间接法的视觉里程计当中。我们的实验在一个具有挑战性的现实世界数据集上面,证实了仅通过我们的语义约束,就可以使得自动驾驶环境下原有最先进的基准得到提升。

主要贡献

1、对于语义重投影误差,我们推到出一个新的代价函数,并表明可以使用期望最大化(EM)方案将其最小化。在语义感知方面,我们的方法是灵活的,因为它可以与任何语义分割算法结合使用。

2、我们实验证明将语义信息融合在VO算法中可以明显减少自动驾驶环境中的平移漂移。且我们的方法可以很容易地整合到现有的VO方法中,无论是依赖于直接还是间接的数据关联方法。

3、我们通过实验分析了我们的方法的行为,解释了它提供改进的条件,并讨论了当前的限制。

算法流程

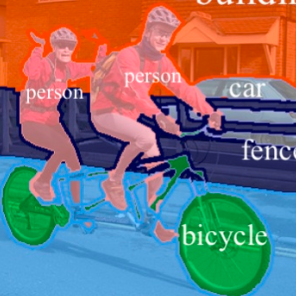

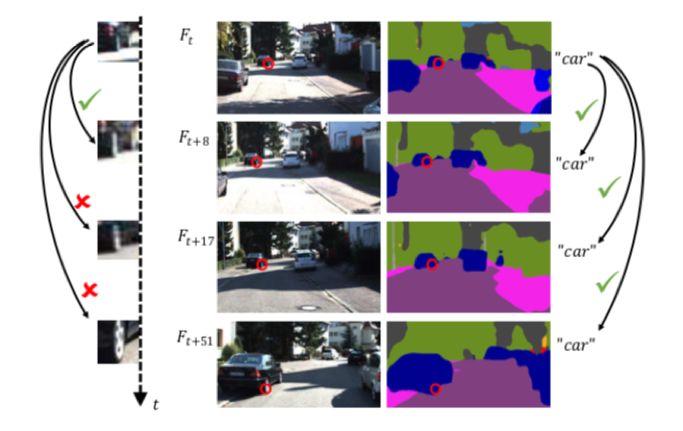

1. 整个算法背后的大概思想如图1所示:考虑位于停放在路边车的车轮上面的3D点(由红色圆圈标记)。随着我们越来越近,该圆圈块内的外观发生很大变化,以至于我们很快就无法将其和第一次观察联系起来。使得我们不能在帧Ft和其后面的帧之间建立足够的约束,以有效地限制估计轨迹的漂移。虽然该点在图像级外观发生的改变,但其语义信息还是相同的(即,都是汽车的一部分)。于是将该点与其语义标签相关联,并强制执行一致性,从而建立中长期的约束。图1所展示的自动驾驶领域前向行驶时普遍存在的情形,当中的点块是长时间可见的。正如我们的实验所示,阐述的问题通常存在且影响直接或间接法。

图1 在大尺度场景变化下的小块区域跟踪。每行显示时间t + τ的图片。红色圆圈是要被跟踪的。这个小圆圈块里的外观随着时间发生的巨大的改变,但其语义信息没有发生改变。当基于外观的跟踪发生失败时,其图像的语义可以被用于建立中长期的约束。

2. 视觉语义里程计框架

一般情况下,本文所提出的方法可以集成到任意基于窗口视觉里程计的系统中,下面将其简称为基本系统。给定一组输入图片

,视觉里程计解决的是使用给定一组相应的观察值

zi,k,联合优化相机位姿

和地图点

。观察值一般是图像中的关键点(一般间接法情况下),或图像(光)强度(一般直接法情况下)。为了可以实时运行,通常忽略点交叉相关情况,一般里程计目标函数表示为:

这里函数

表示为相机在第k位置中第i个点的代价,一般此函数可定义为光度误差(直接法)或几何误差(间接法中)。

现在描述语义代价函数,它可以很容易和Ebase结合。对于每张输入图像Ik, 我们需要一个稠密的像素方式的语义分割

,其中每个像素的都有一个来自集合C中的类标|C|。除了其位置之外Xi,,每个地图点也与分类变量Zi ∈ C相关联。p(Zi = c|Xi)是位置Xi处的点Pi为类c的概率。我们将每个点Pi的标签概率向量表示为

,其中

是点Pi属于类c的概率。 该概率向量是从语义分割在线估计的。 直观地,,鼓励点投影在语义上和光度上/几何上是一致的。直观地,我们提出语义概率的目的是促使点映射在语义上和光度上/几何上是一致。为了将我们的语义约束结合到里程计优化功能中,我们定义了语义代价函数

其中

为每个关联相机位姿Tk和点Pi,在图像分割观测值Sk下的代价。最后优化联合语义和基本代价函数:

其中λ详见原文。

主要结果

本文实验

数据集:KITTI和PlayingForBench- marks (P4B);

计算平台:四核2.5hzCPU,8GBRAM,NVIDIA 1080 GPU;

ORB-SLAM2 为当前最前沿的间接法实验代表;

PhotoBundle 为直接法VO代表。

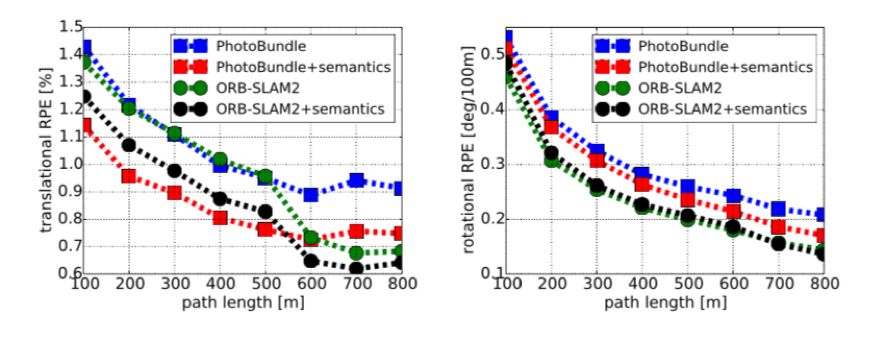

图2在KITTI数据集的序列上进行实验结果,平移(左)和旋转(右)。分别在立体ORB-SLAM2和PhotoBundle进行有没有加入语义信息的实验结果。可以看出,在两个方法中语义约束都减少了平移的飘逸。实验结果为取KITTI数据集的序列除01, 04、06, 10的平均值。

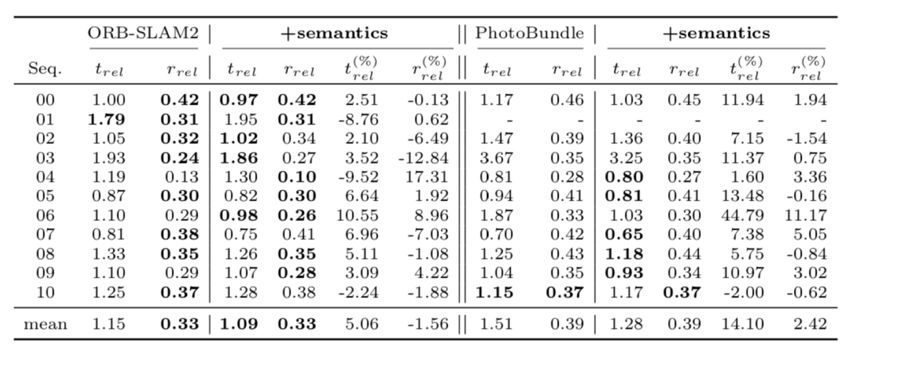

表1 KITTI RPE结果:平移trel (%)和旋转(deg./100m),100米到800米的平均结果(值越小越好)。t(%)和r(%)表示改进程度(以%表示,越高越好)。

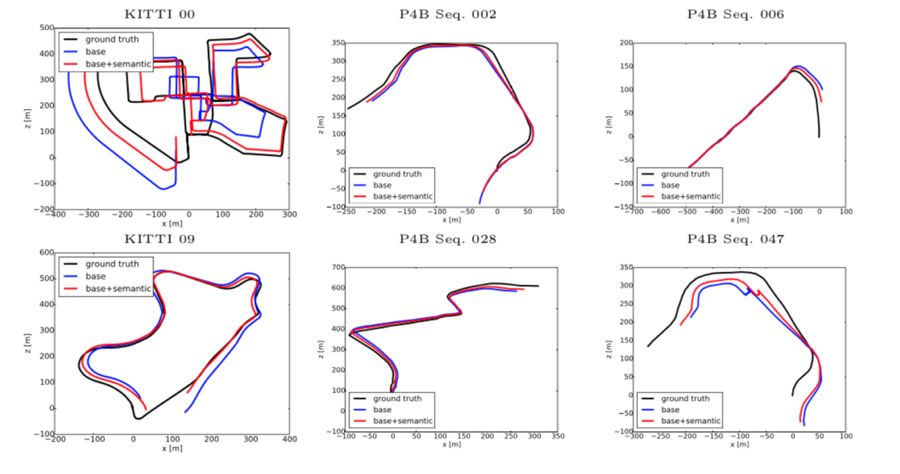

图3 KITTI和P4B下的单目ORB-SLAM2的轨迹图。 所有序列都是7-DoF且与Ground Truth匹配。

Abstract

Abstract. Robust data association is a core problem of visual odometry, where image-to-image correspondences provide constraints for camera pose and map estimation. Current state-of-the-art direct and indirect methods use short-term tracking to obtain continuous frame-to-frame constraints, while long-term constraints are established using loop closures. In this paper, we propose a novel visual semantic odometry (VSO) framework to enable medium-term continuous tracking of points using semantics. Our proposed framework can be easily integrated into existing direct and indirect visual odometry pipelines. Experiments on challenging real-world datasets demonstrate a significant improvement over state-of-the-art baselines in the context of autonomous driving simply by integrating our semantic constraints.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com