【泡泡图灵智库】基于动态边缘化的直接稀疏视觉惯性里程计(ICRA)

泡泡图灵智库,带你精读机器人顶级会议文章

标题:Direct Sparse Visual-Inertial Odometry using Dynamic Marginalization

作者:Lukas von Stumberg, Vladyslav Usenko, Daniel Cremers

来源:ICRA2018

编译:彭锐

审核:李建华

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——基于动态边缘化的直接稀疏视觉惯性里程计,该文章发表于ICRA 2018。

我们提出了VI-DSO,一种新的视觉惯性里程计方法,它通过最小化组合能量函数中的光度和IMU测量误差,共同估计相机姿态和稀疏场景几何信息。系统的视觉部分进行集束调整,如稀疏点集的优化,但是它不同于基于关键点的系统,它直接最小化光度测量误差。这使得系统不仅可以跟踪角点,还可以跟踪任何具有足够大强度梯度的像素。IMU信息通过测量预积分在多个帧之间累积,并且作为关键帧之间的附加约束插入到优化过程中。我们明确地将尺度和重力方向引入到我们的模型中,并联合其他变量,如姿态,将它们联合优化。由于通常使用IMU数据不能立即观测到尺度,这使得我们可以以任意的尺度初始化视觉惯性系统,而不是延迟初始化,直到所有事物都被观察到为止。我们执行部分边缘化的旧变量,以便更新可以在一个合理的时间内计算完毕。为了保持系统的一致性,我们提出了一种新的策略:“动态边缘化”。这种技术允许我们使用局部边缘化,即使在初始尺度估计远离最优的情况下。在具有挑战性的EUROC数据集上评估了我们的方法,结果表明VI-DSO优于当前最好的方法。

下图1为本文方法效果展示:

图1 本文方法效果展示

主要贡献

本文的主要贡献有:

1.一种直接稀疏法视觉惯性里程计系统。

2.一种新的初始化策略,其中尺度和重力方向包括在模型中,并初始化后联合优化。

3.我们引入“动态边缘化”技术,自适应地使用边缘化策略,即使在某些变量发生剧烈变化。

4.对具有挑战性的EUROC数据集进行广泛测试表明,整个系统和初始化策略都优于现有技术。

算法流程

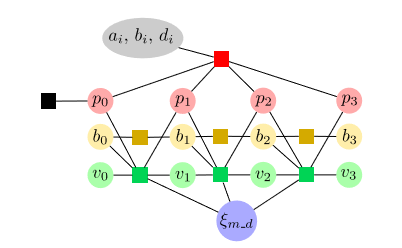

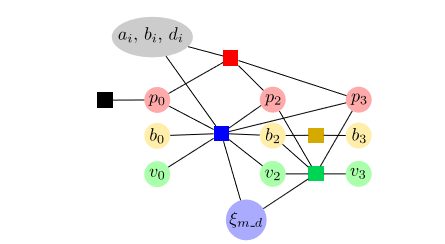

图2 算法流程

该系统包含并行运行的两个主要部分:

1.该算法采用直接图像配准和惯性误差项相结合的方法来估计最近帧的姿态。

2.当创建一个新的关键帧时,我们执行视觉惯性集束调整,图优化,估计所有活动关键帧的几何信息和姿态。

主要结果

实验结果展示:

将我们的方法与几种主流方法的轨迹估计精度定量比较后的结果如表1所示:

表1 本文方法与几种方法估计的轨迹精度定量分析

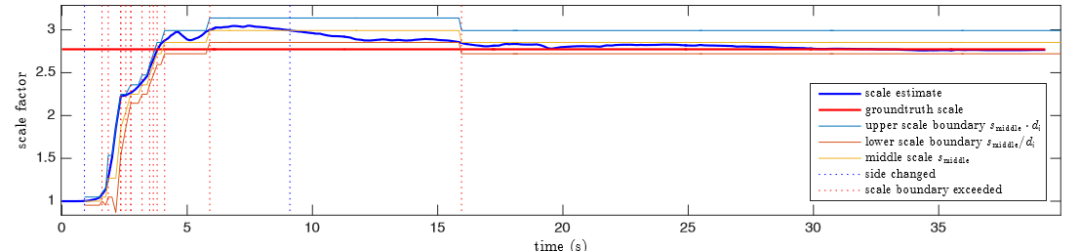

我们的方法对于尺度因子估计的定性结果如图3所示:

图3 本文方法对于尺度因子估计的定性分析

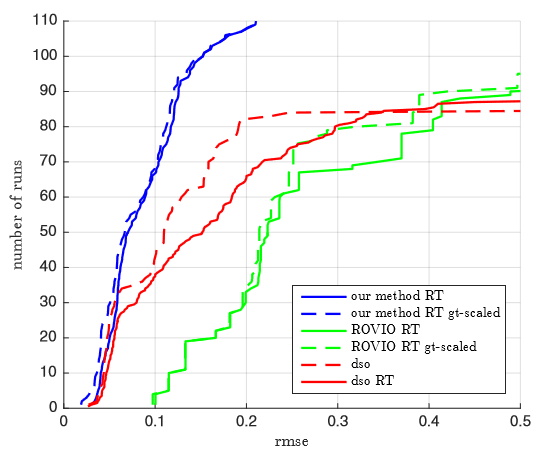

本文提出的方法与其他方法在实时累计误差方面的定性对比结果如图4所示:

图4 本文方法与多种方法实时累计误差的定性分析

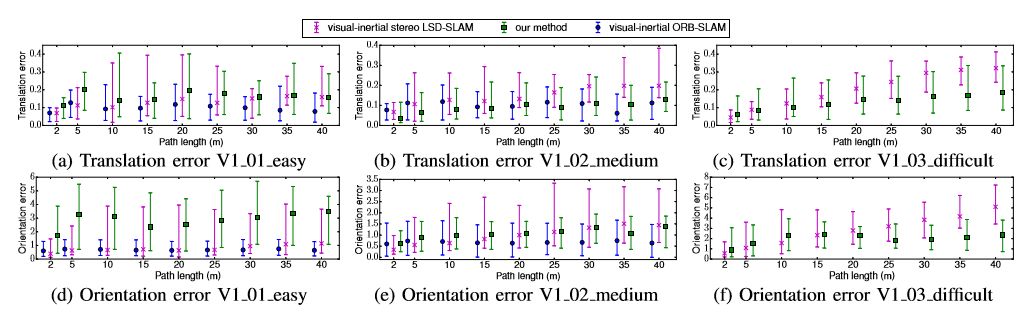

本文提出的方法与LSD、ORB_SLAM两种方法在相对位姿估计方面的误差定性分析结果如图5所示:

图5 本文方法与其他方法在相对位姿估计方面的误差定性分析

本文尺度估计的调整效果如图6所示:

图6 本文尺度估计调整效果定性结果

最后本文实验证明惯性信息不仅提供了可靠的尺度估计,而且还大大提高了精度和鲁棒性。

Abstract

We present VI-DSO, a novel approach for visual-inertial odometry, which jointly estimates camera poses and sparse scene geometry by minimizing photometric and IMU measurement errors in a combined energy functional. The visual part of the system performs a bundle-adjustment like optimization on a sparse set of points, but unlike key-point based systems it directly minimizes a photometric error. This makes it possible for the system to track not only corners, but any pixels with large enough intensity gradients. IMU information is accumulated between several frames using measurement preintegration, and is inserted into the optimization as an additional constraint between keyframes. We explicitly include scale and gravity direction into our model and jointly optimize them together with other variables such as poses. As the scale is often not immediately observable using IMU data this allows us to initialize our visual-inertial system with an arbitrary scale instead of having to delay the initialization until everything is observable. We perform partial marginalization of old variables so that updates can be computed in a reasonable time. In order to keep the system consistent we propose a novel strategy which we call ”dynamic marginalization”. This technique allows us to use partial marginalization even in cases where the initial scale estimate is far from the optimum. We evaluate our method on the challenging EuRoC dataset, showing that VI-DSO outperforms the state of the art.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com