转载机器之心机器之心编辑部RLHF 方法虽然强大,但它并没有解决开发人性化人工智能的基本挑战。

自 ChatGPT 问世,OpenAI 使用的训练方法人类反馈强化学习(RLHF)就备受关注,已经成为微调大型语言模型(LLM)的核心方法。RLHF 方法在训练中使用人类反馈,以最小化无益、失真或偏见的输出,使 AI 模型与人类价值观对齐。

然而,RLHF 方法也存在一些缺陷,最近来自 MIT CSAIL、哈佛大学、哥伦比亚大学等机构的数十位研究者联合发表了一篇综述论文,对两百余篇领域内的研究论文进行分析探讨,系统地研究了 RLHF 方法的缺陷。

论文地址:https://huggingface.co/papers/2307.15217

总的来说,该论文强调了 RLHF 的局限性,并表明开发更安全的 AI 系统需要使用多方面方法(multi-faceted approach)。研究团队做了如下工作:

调查了 RLHF 和相关方法的公开问题和基本限制; * 概述了在实践中理解、改进和补充 RLHF 的方法; * 提出审计和披露标准,以改善社会对 RLHF 系统的监督。

具体来说,论文的核心内容包括以下三个部分:

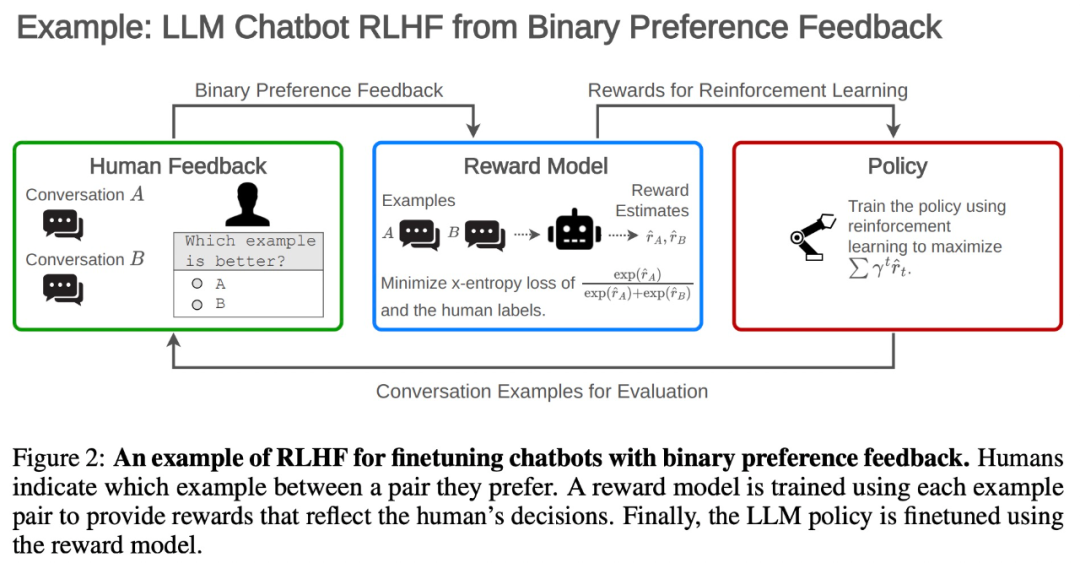

1.RLHF 面临的具体挑战。研究团队对 RLHF 相关问题进行了分类和调查,并区分了 RLHF 面临的挑战与 RLHF 的根本局限性,前者更容易解决,可以在 RLHF 框架内使用改进方法来解决,而后者则必须通过其他方法来解决对齐问题。

-

将 RLHF 纳入更广泛的技术安全框架。论文表明 RLHF 并非开发安全 AI 的完整框架,并阐述了有助于更好地理解、改进和补充 RLHF 的一些方法,强调了多重冗余策略(multiple redundant strategy)对减少问题的重要性。

-

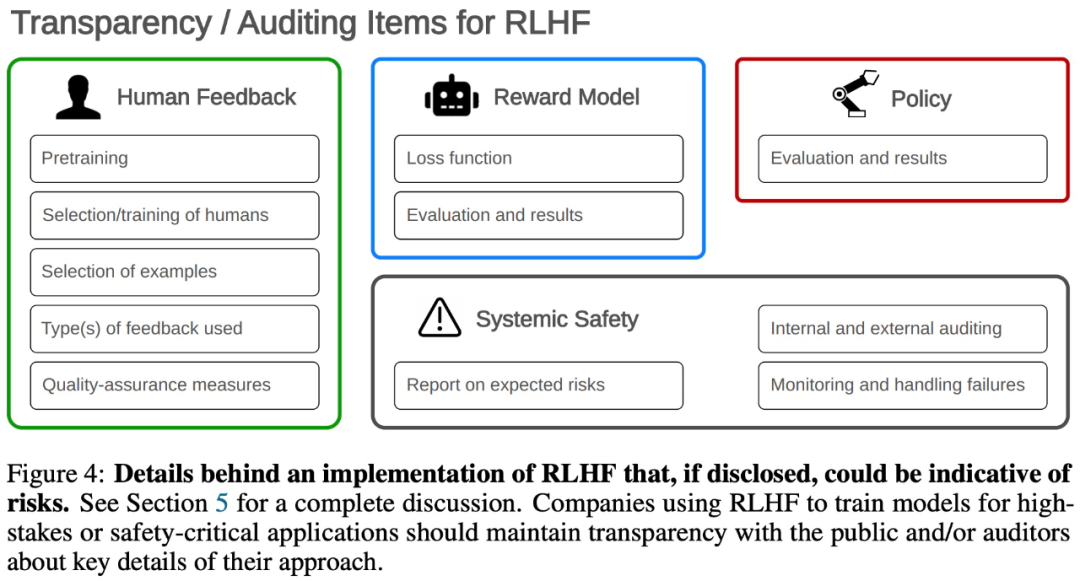

治理与透明度。该论文分析探讨了改进行业规范面临的挑战。例如,研究者讨论了让使用 RLHF 训练 AI 系统的公司披露训练细节是否有用。

我们来看下论文核心部分的结构和基本内容。

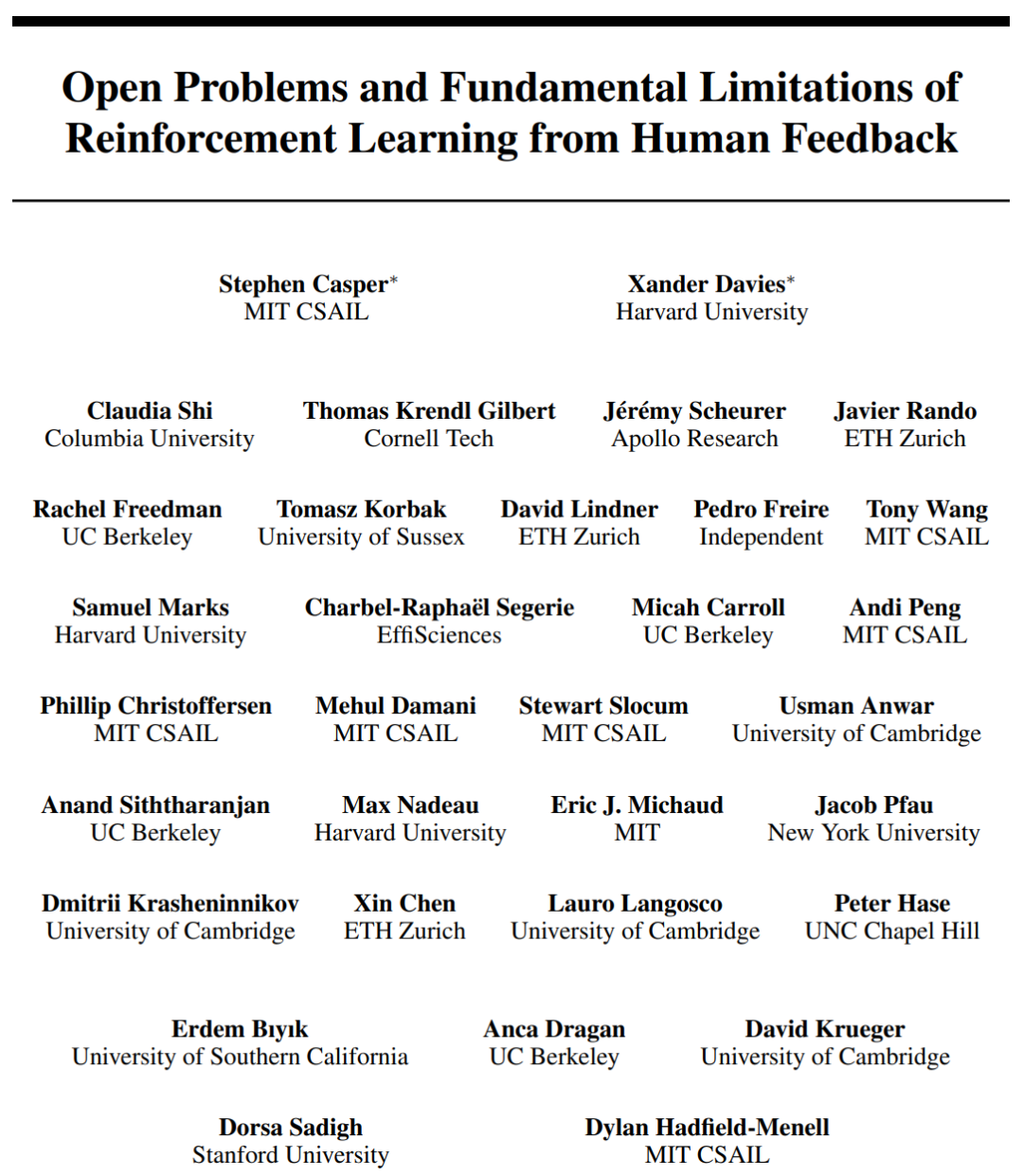

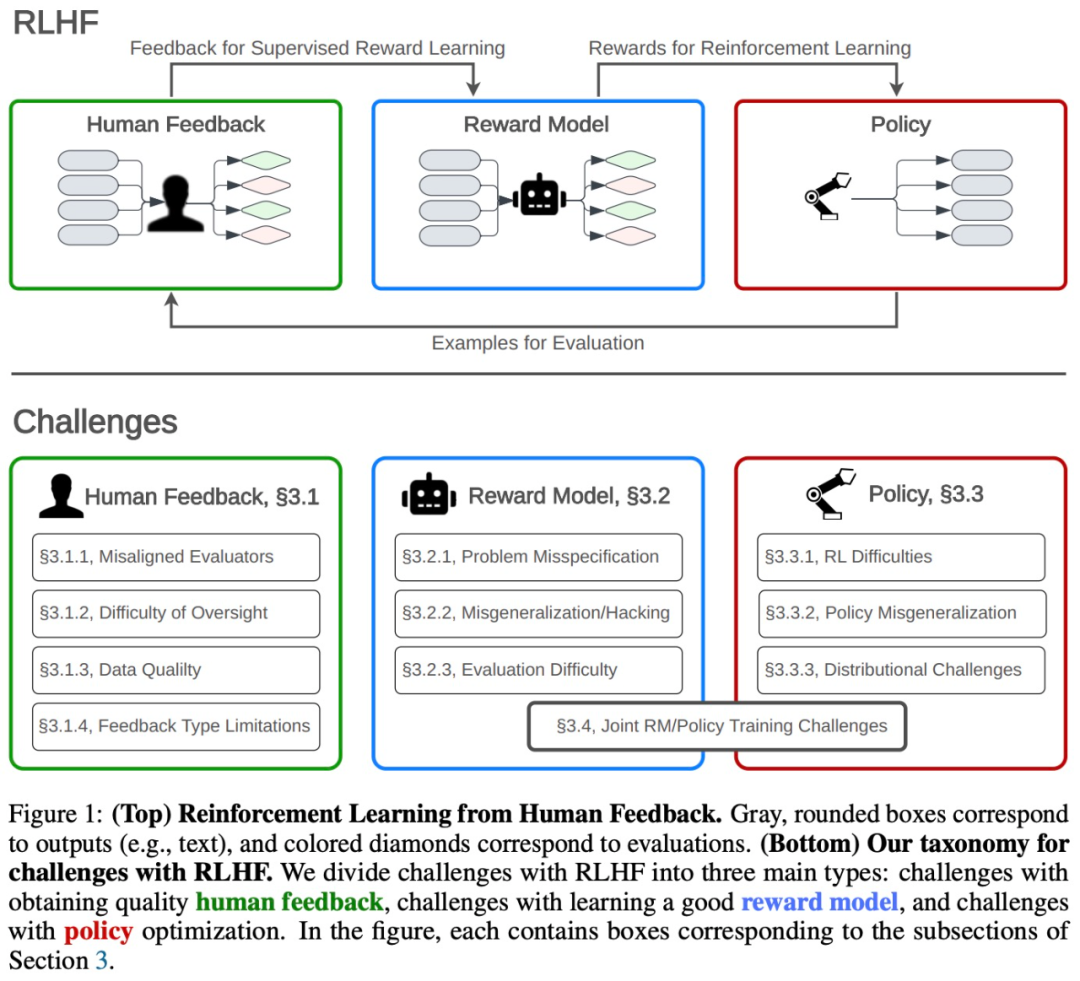

如下图 1 所示,该研究分析了与 RLHF 相关 3 个过程:收集人类反馈、奖励建模和策略优化。其中,反馈过程引出人类对模型输出的评估;奖励建模过程使用监督学习训练出模仿人类评估的奖励模型;策略优化过程优化人工智能系统,以产生奖励模型评估更优的输出。论文第三章从这三个过程以及联合训练奖励模型和策略四个方面探讨了 RLHF 方法存在的问题和挑战。

论文第三章总结的问题表明:严重依赖 RLHF 来开发人工智能系统会带来安全风险。虽然 RLHF 很有用,但它并没有解决开发人性化人工智能的基本挑战。

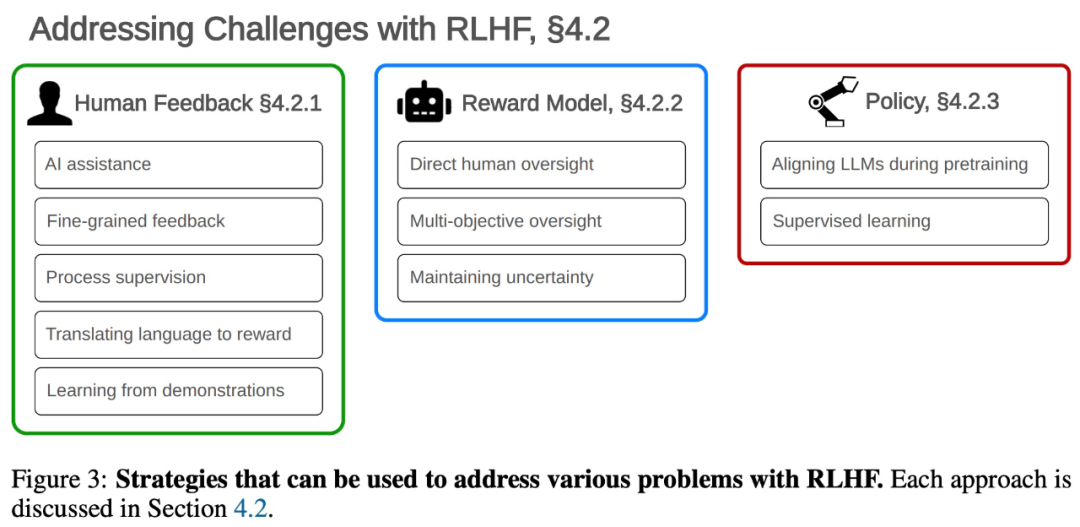

研究团队认为:任何单一策略都不应被视为综合解决方案。更好的做法是采用多种安全方法的「深度防御」,论文第四章从理解、改进、补充 RLHF 这几个方面详细阐述了提高 AI 安全性的方法。

论文第五章概述了 RLHF 治理面临的风险因素和审计措施。

总结

该研究发现,实践中很多问题来源于 RLHF 的根本局限性,必须采用非 RLHF 的方法来避免或弥补。因此,该论文强调两种策略的重要性:(1) 根据 RLHF 和其他方法的根本局限性来评估技术进步,(2) 通过采取深度防御安全措施和与科学界公开共享研究成果,来应对 AI 的对齐问题。

此外,该研究阐明一些挑战和问题并非是 RLHF 所独有的,如 RL 策略的难题,还有一些是 AI 对齐的基本问题。