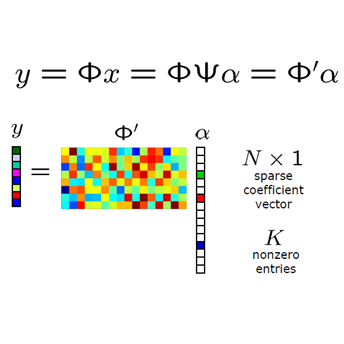

In this letter, we introduce over-the-air computation into the communication design of federated multi-task learning (FMTL), and propose an over-the-air federated multi-task learning (OA-FMTL) framework, where multiple learning tasks deployed on edge devices share a non-orthogonal fading channel under the coordination of an edge server (ES). Specifically, the model updates for all the tasks are transmitted and superimposed concurrently over a non-orthogonal uplink fading channel, and the model aggregations of all the tasks are reconstructed at the ES through a modified version of the turbo compressed sensing algorithm (Turbo-CS) that overcomes inter-task interference. Both convergence analysis and numerical results show that the OA-FMTL framework can significantly improve the system efficiency in terms of reducing the number of channel uses without causing substantial learning performance degradation.

翻译:在这封信中,我们在联合多任务学习(FMTL)的通信设计中引入了超空计算,并提议了一个超空联合多任务学习(OA-FMTL)框架,在边缘设备上部署的多重学习任务在一个边缘服务器(ES)的协调下共享一个非垂直淡化通道。具体地说,所有任务的模型更新都通过一个非垂直上链通道同时传输和同步进行,而所有任务的模型组合在ES通过一个经过修改的涡轮压缩感应算法(Turbo-CS)来重建,以克服跨任务干扰。 趋同分析和数字结果都表明,OA-FMTL框架可以大幅提高系统效率,减少频道的使用数量,而不会导致学习性能的大幅退化。