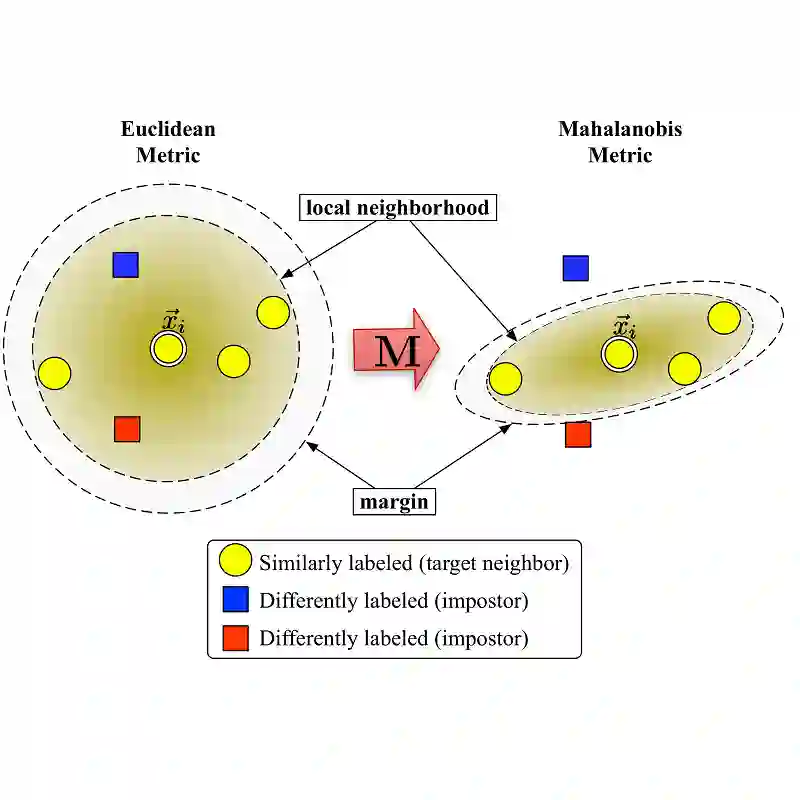

In this paper, we reveal that metric learning would suffer from serious inseparable problem if without informative sample mining. Since the inseparable samples are often mixed with hard samples, current informative sample mining strategies used to deal with inseparable problem may bring up some side-effects, such as instability of objective function, etc. To alleviate this problem, we propose a novel distance metric learning algorithm, named adaptive neighborhood metric learning (ANML). In ANML, we design two thresholds to adaptively identify the inseparable similar and dissimilar samples in the training procedure, thus inseparable sample removing and metric parameter learning are implemented in the same procedure. Due to the non-continuity of the proposed ANML, we develop an ingenious function, named \emph{log-exp mean function} to construct a continuous formulation to surrogate it, which can be efficiently solved by the gradient descent method. Similar to Triplet loss, ANML can be used to learn both the linear and deep embeddings. By analyzing the proposed method, we find it has some interesting properties. For example, when ANML is used to learn the linear embedding, current famous metric learning algorithms such as the large margin nearest neighbor (LMNN) and neighbourhood components analysis (NCA) are the special cases of the proposed ANML by setting the parameters different values. When it is used to learn deep features, the state-of-the-art deep metric learning algorithms such as Triplet loss, Lifted structure loss, and Multi-similarity loss become the special cases of ANML. Furthermore, the \emph{log-exp mean function} proposed in our method gives a new perspective to review the deep metric learning methods such as Prox-NCA and N-pairs loss. At last, promising experimental results demonstrate the effectiveness of the proposed method.

翻译:在本文中,我们发现,如果不进行信息丰富的采样采样,那么衡量学习就会遇到严重的密不可分的问题。由于分解的样本往往与硬样本混杂在一起,目前用于处理密不可分问题的信息丰富的采样策略可能会产生一些副作用,例如目标功能的不稳定性等等。为了缓解这一问题,我们建议采用新的远程衡量算法,称为适应性邻里衡量学习(ANML ) 。在ANML中,我们设计了两个阈值,以适应性地识别培训程序中不可分割的相似和不同样本,从而在同一程序内实施分解和衡量参数学习。由于拟议的ANML不连续,我们开发了一种名为 emph{log-Explex 平均函数的遗传功能,以构建一种连续的配方,通过渐渐渐下降法方法来有效解决这个问题。 与Triplletet 一样,ANML可以使用拟议的线和深度嵌入式方法,因此,当ANML使用直流的直线嵌式计算方法来学习线性嵌入、当前著名的直径测深深层算法,例如MLML的内值的缩缩缩缩缩算法, IMLLLL 演示中的拟议的缩算法是用来在深度分析中, 。