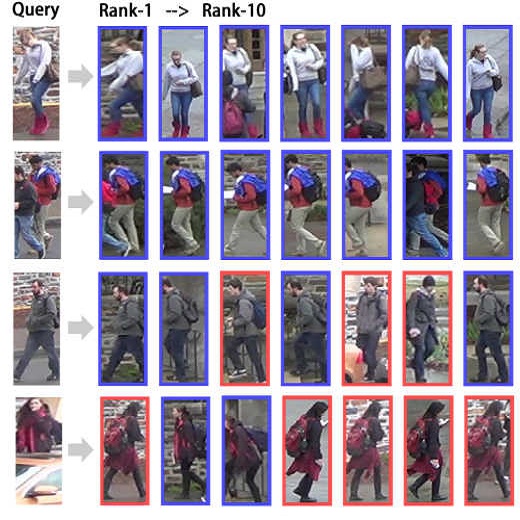

Person re-identification (re-ID) in the scenario with large spatial and temporal spans has not been fully explored. This is partially because that, existing benchmark datasets were mainly collected with limited spatial and temporal ranges, e.g., using videos recorded in a few days by cameras in a specific region of the campus. Such limited spatial and temporal ranges make it hard to simulate the difficulties of person re-ID in real scenarios. In this work, we contribute a novel Large-scale Spatio-Temporal (LaST) person re-ID dataset, including 10,860 identities with more than 224k images. Compared with existing datasets, LaST presents more challenging and high-diversity reID settings, and significantly larger spatial and temporal ranges. For instance, each person can appear in different cities or countries, and in various time slots from daytime to night, and in different seasons from spring to winter. To our best knowledge, LaST is a novel person re-ID dataset with the largest spatiotemporal ranges. Based on LaST, we verified its challenge by conducting a comprehensive performance evaluation of 14 re-ID algorithms. We further propose an easy-to-implement baseline that works well on such challenging re-ID setting. We also verified that models pre-trained on LaST can generalize well on existing datasets with short-term and cloth-changing scenarios. We expect LaST to inspire future works toward more realistic and challenging re-ID tasks. More information about the dataset is available at https://github.com/shuxjweb/last.git.

翻译:部分原因在于,现有基准数据集主要在有限的空间和时间范围内收集,例如,使用校区特定区域几天内摄像头录制的视频,使用校园内某个特定区域几天内摄像头录制的视频。这种有限的空间和时间范围使得很难模拟真实情景中人重新识别的困难。在这项工作中,我们贡献了一个新型的大型Spatio-Temporal(LaST)人重新识别数据集,包括10 860个具有超过224k图像的身份。与现有的数据集相比,LaST提供了更具有挑战性和高度多样性的重置设置,以及更大的空间和时间范围。例如,每个人可以在不同的城市或国家出现,在从白天到晚上,在不同的时间段里,模拟人重新识别的难度。根据我们的最佳知识,LaST是一个具有最大感应感触摸力的短期重置数据集。基于LaST,我们核实了它的挑战,通过对14个重新定位数据库进行更具有挑战性和高度多样性的重新定位。我们还可以在14个基础上提出一个容易的更新的数据。