CPNDet:简单地给CenterNet加入two-stage,更快更强 | ECCV 2020

↑ 点击蓝字 关注极市平台

极市导读

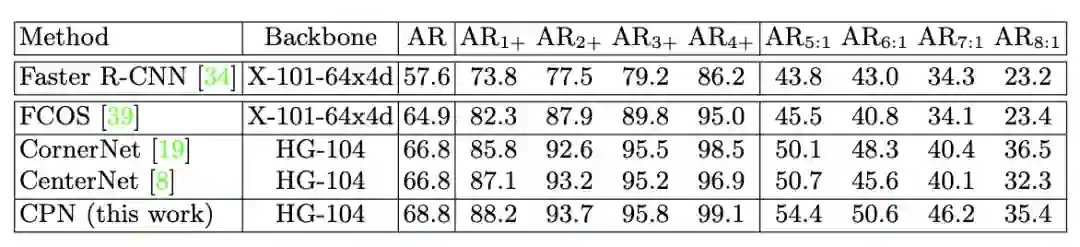

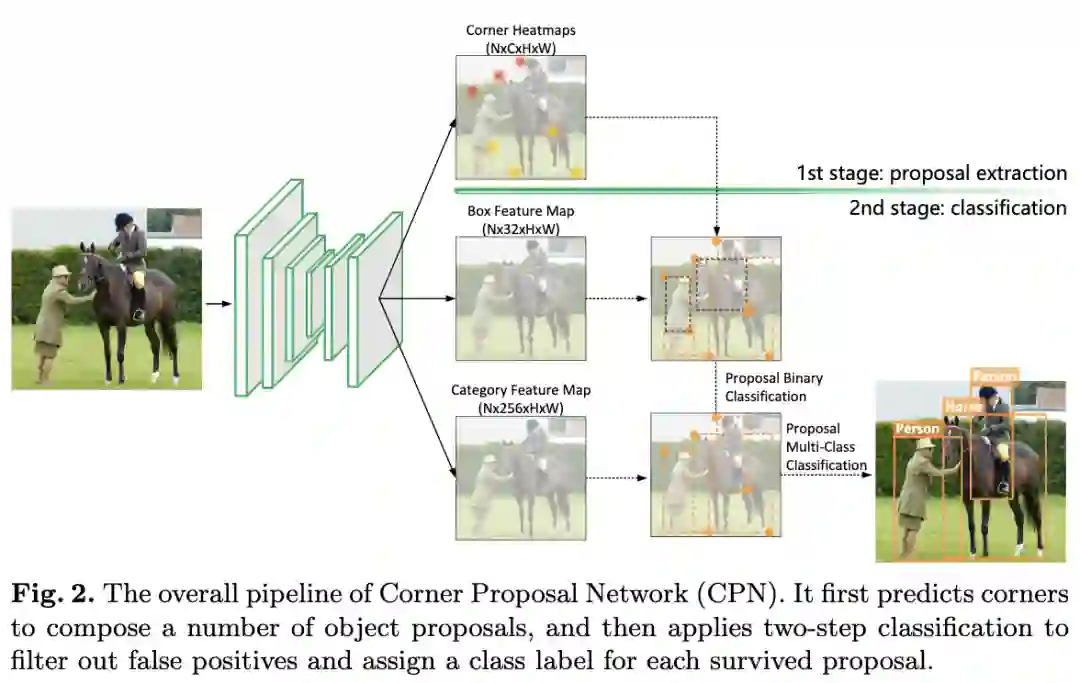

本文介绍了一篇关于目标检测算法的论文,该文提出anchor-free/two-stage目标检测算法CPN,使用关键点提取候选框再使用两阶段分类器进行预测。文章从四个部分分别阐述了CPN的基本概念,anchor-free以及two-stage的选择问题,CPN的基本框架以及相关实验结果展示。 >>加入极市CV技术交流群,走在计算机视觉的最前沿

本文为CenterNet作者发表的,论文提出anchor-free/two-stage目标检测算法CPN,使用关键点提取候选框再使用两阶段分类器进行预测。论文整体思路很简单,但CPN的准确率和推理速度都很不错,比原本的关键点算法更快,源码也会公开,到时可以一试。

论文: Corner Proposal Network for Anchor-free,Two-stage Object Detection

论文地址:https://arxiv.org/abs/2007.13816

论文代码:https://github.com/Duankaiwen/CPNDet

Introduction

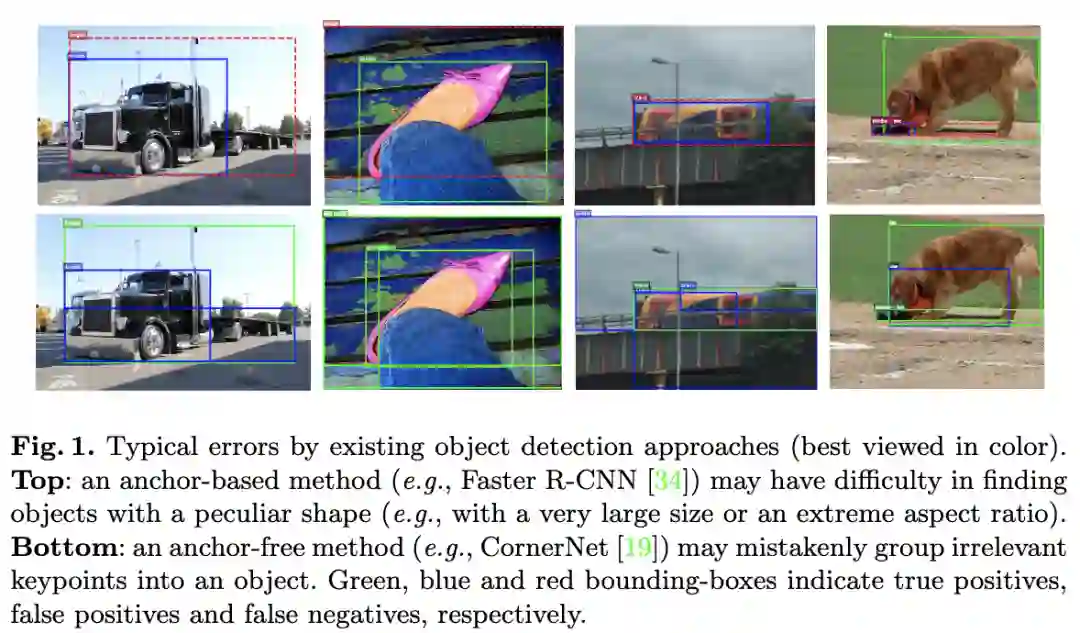

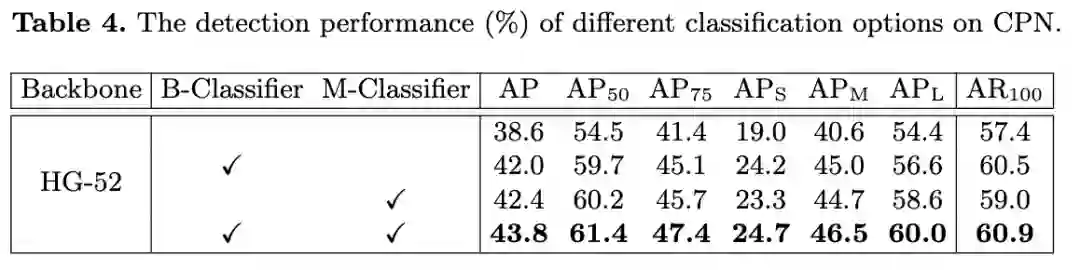

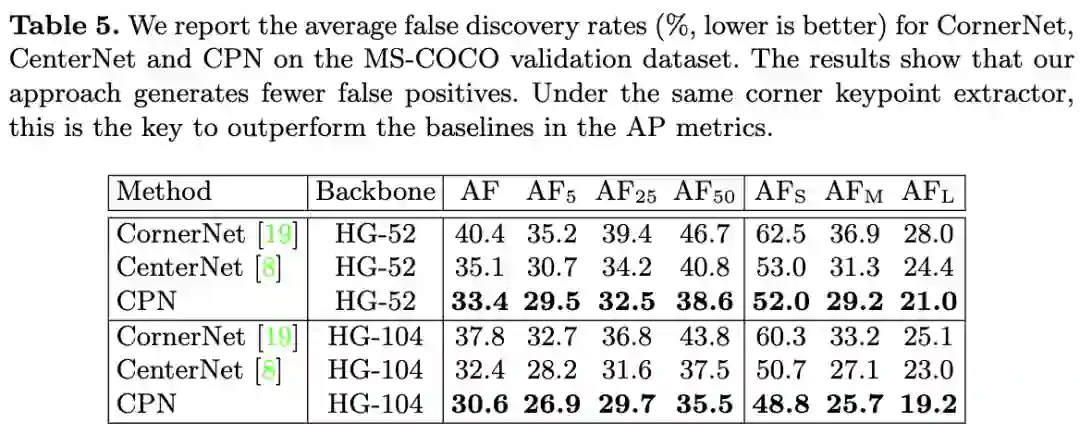

目前,amchor-based目标检测方法和anchor-free目标检测方法都涌现了大量的优秀检测方案。论文认为,对于形状特异的目标,anchor-free目标检测方式比较占优,但acnhor-free方法通常会出现大量的误检,如图1所示,需要一个独立的分类器来提升检测的准确率。为此,论文提出CPNDet(Corner Proposal Network),结合了anchor-free和two-stage的检测范式。先基于CornerNet进行角点检测,将有效的角点枚举组合成大量候选预测框。由于候选框包含大量负样本,先训练一个二值分类器过滤大部分的候选预测框,再使用多类别分类器进行标签预测。

Anchor-based or Anchor-free? One-stage or Two-stage?

这里论文主要讨论anchor-based vs anchor-free以及one-stage vs two-stage的问题。

Anchor-based or Anchor-free?

Anchor-based方法将大量的anchor平铺在特征图上,然后预测每个anchor是否包含物体以及标签。通常,anchor是与图片特定的位置关联,大小也是相对固定的,bbox回归能够轻微地改变其几何形状。Anchor-free方法则不受预设的anchor限制,直接定位目标的关键点,然后再预测其形状和标签。所以,论文认为anchor-free方法在任意形状目标的定位上更灵活,召回率也更高。

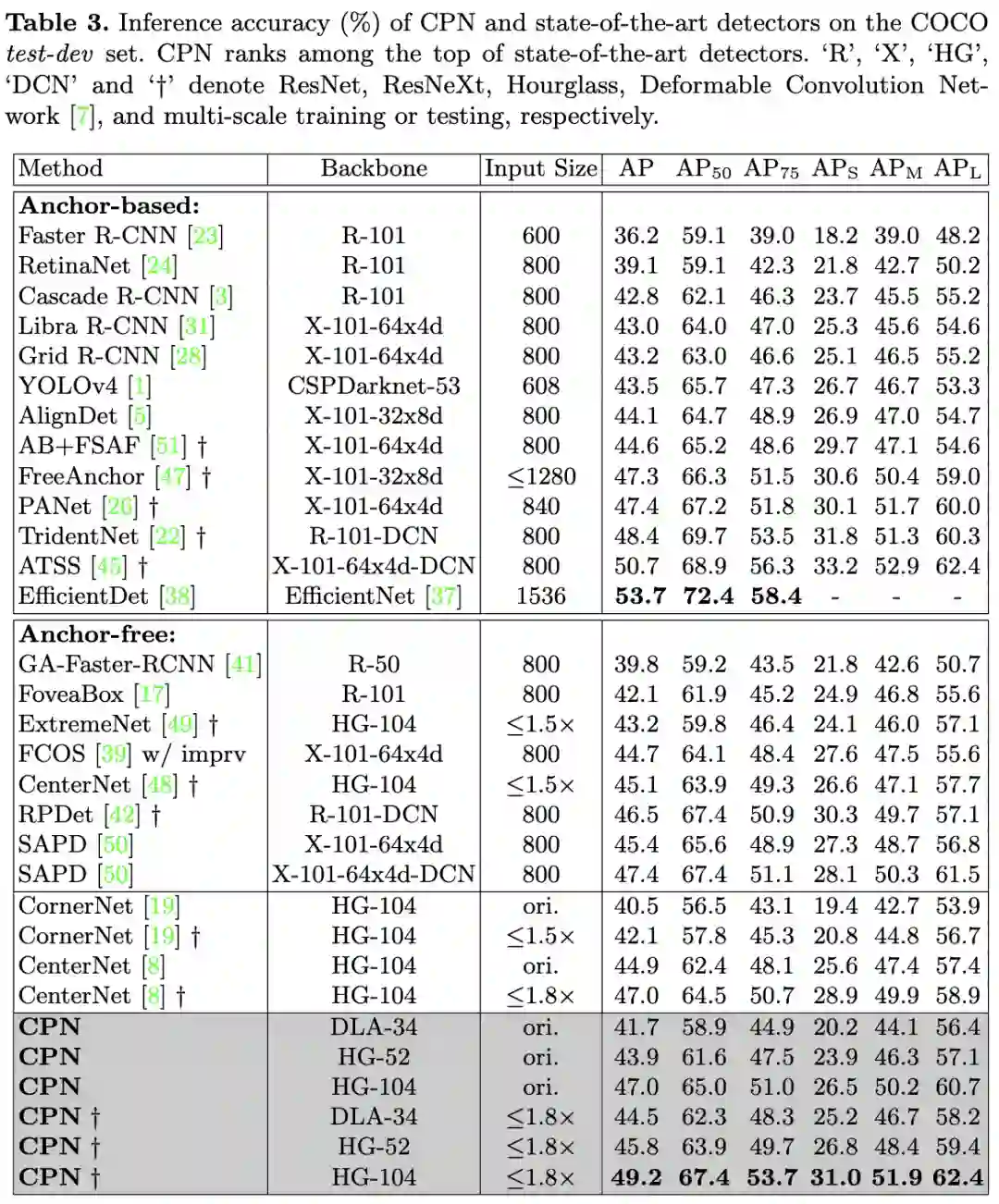

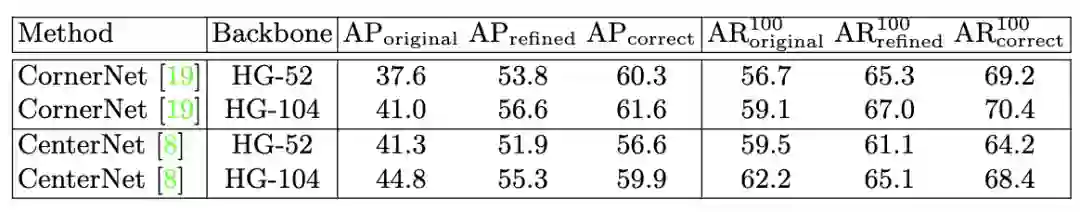

论文也对anchor-based方法和anchor-free方法在不同大小以及不同比例的目标上的进行召回率对比,结果如上表所示。可以看出anchor-free方法通常有较高的召回率,特别是在长宽比较大的物体上,anchor-based方法由于预设的anchor与目标差异大,召回率偏低。其次,FCOS虽然也是anchor-free方法,但其最后需要预测关键点到边界的距离,这在这种场合下也难以预测。

One-stage or Two stage?

虽然anchor-free方法解决了寻找目标候选框的约束,但由于缺乏目标的内部信息,难以很好地建立关键点与目标之间的联系,会给检测的准确率带来较大的影响,而关键点和目标之间的联系的建立通常需要丰富的语义信息。

The Framework of Corner Proposal Network

Stage 1: Anchor-free Proposals with Corner Keypoints

-

关键点是否属于同一个类别 -

左上角点必须在右上角点的左上位置

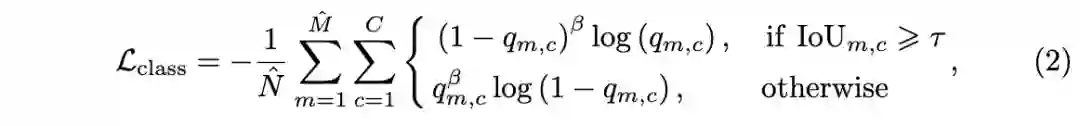

Stage 2: Two-step Classification for Filtering Proposals

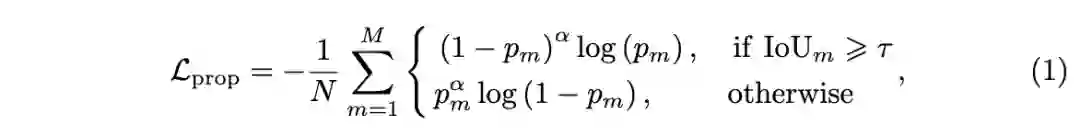

第一步训练二值分类器来决定候选框是否为目标,采用 的RoIAlign提取每个候选框的在box特征图上的特征,然后使用1个 的卷积层来输出每个预测框的分类置信度,损失函数为:

The Inference Process

Experiments

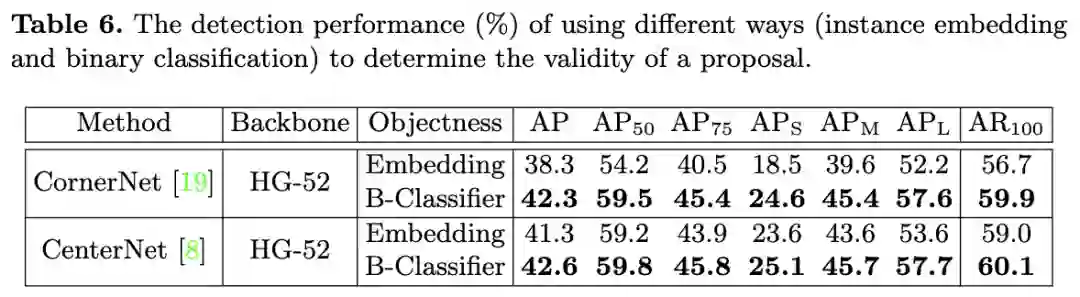

二值分类器与CornerNet的embedding向量的性能对比。

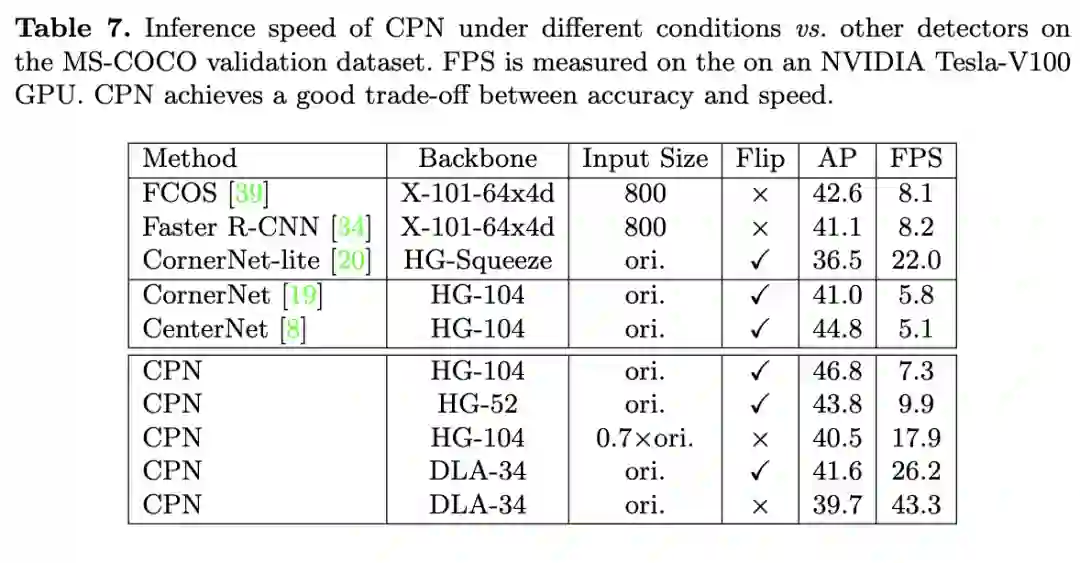

推理速度对比。

推理速度对比。

CONCLUSION

推荐阅读