【泡泡一分钟】多运动视觉里程计(MVO):摄像机和第三方运动的同时估计

每天一分钟,带你读遍机器人顶级会议文章

标题:Multimotion Visual Odometry (MVO): Simultaneous Estimation of Camera and Third-Party Motions

作者:Kevin M. Judd, Jonathan D. Gammell, Paul Newman

来源:2018 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS)

编译:张建

审核:颜青松 陈世浪

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

从图像中估计运动是计算机视觉和机器人学中研究的很透彻的问题。先前的工作已经开发了用于估计运动相机在很大程度上静态的环境(例如,视觉里程计)中的运动以及使用已知的相机运动(例如,多目标跟踪)来分割或跟踪动态场景中的运动的技术。

同时估计摄像机的未知运动和动态场景更具挑战性。大多数以前的工作需要先验对象模型(例如,通过检测跟踪)、运动约束(例如,平面运动)或未能估计场景的完整SE(3)运动(例如,场景流)。虽然这些方法在特定的应用领域工作良好,但它们不能推广到无约束运动。

本文扩展了传统的视觉里程计(VO)的流程来估计立体/RGBD摄像机和动态场景的全SE(3)运动。这种多运动视觉里程计(MVO)的流程不需要环境或动态对象的先验知识。

它的性能是在真实世界的动态数据集上评估的,该数据集具有来自运动捕获系统的所有运动的真值。

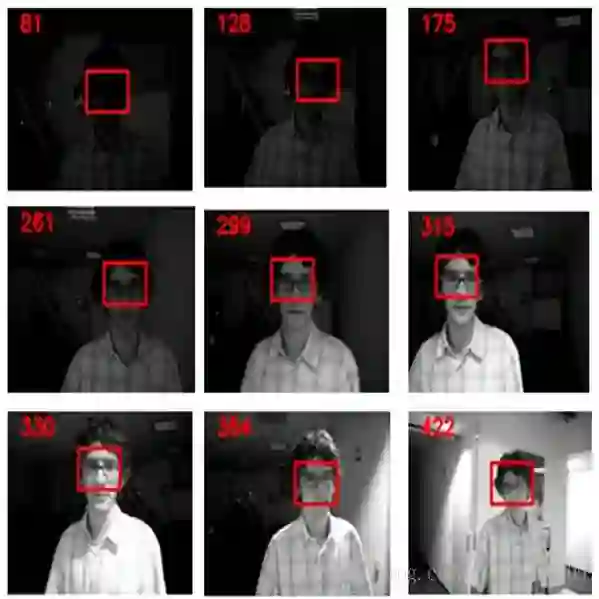

图1。运动分割由我们的多运动视觉里程计(MVO)系统产生。

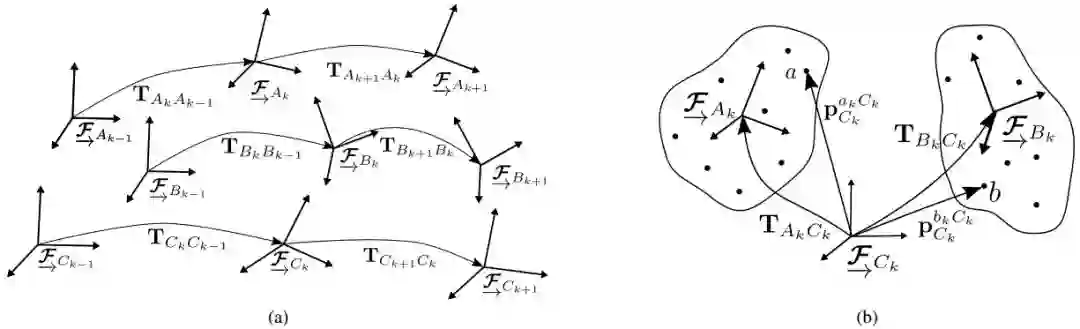

图2。多运动估计问题的说明,展示出帧随时间的运动,(a)和相对点观测,(b)。

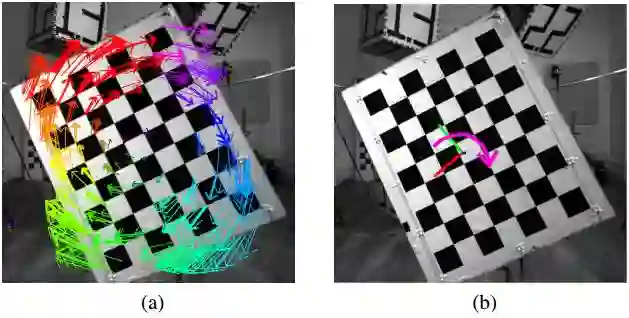

图3。场景流,(a),和MVO,(b),在绕光轴旋转的棋盘上。

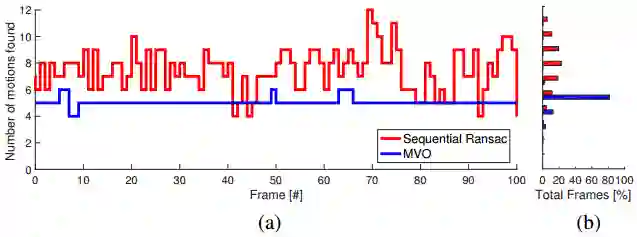

图4。通过连续RANSAC(红色)和MVO(蓝色)在500帧的五运动实验中发现的模型数量的比较。

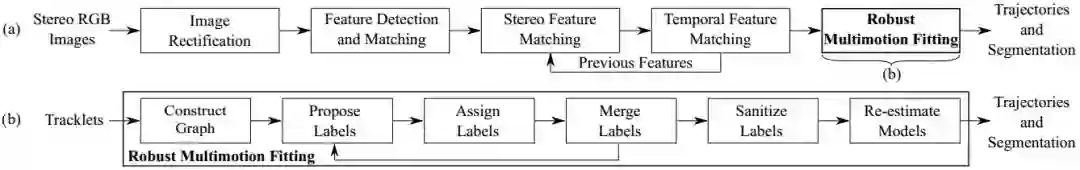

图5。立体多运动视觉里程计(MVO)流程的图示,(a),包括多运动拟合组件的细节,(b)。该流程对RGB立体图像对进行操作,估计场景中所有运动的分割和轨迹。

Abstract

Estimating motion from images is a well-studied problem in computer vision and robotics. Previous work has developed techniques to estimate the motion of a moving camera in a largely static environment (e.g., visual odometry) and to segment or track motions in a dynamic scene using known camera motions (e.g., multiple object tracking). It is more challenging to estimate the unknown motion of the camera and the dynamic scene simultaneously. Most previous work requires a priori object models (e.g., trackingby-detection), motion constraints (e.g., planar motion), or fails to estimate the full SE (3) motions of the scene (e.g., scene flow). While these approaches work well in specific application domains, they are not generalizable to unconstrained motions. This paper extends the traditional visual odometry (VO) pipeline to estimate the full SE (3) motion of both a stereo/RGBD camera and the dynamic scene. This multimotion visual odometry (MVO) pipeline requires no a priori knowledge of the environment or the dynamic objects. Its performance is evaluated on a real-world dynamic dataset with ground truth for all motions from a motion capture system.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com