【泡泡一分钟】基于运动估计的激光雷达和相机标定方法

每天一分钟,带你读遍机器人顶级会议文章

标题:LiDAR and Camera Calibration using Motions Estimated by Sensor Fusion Odometry

作者:Ryoichi Ishikawa, Takeshi Oishi and Katsushi Ikeuchi

来源:2018 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS)

编译:章绩伟

审核:颜青松,陈世浪

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

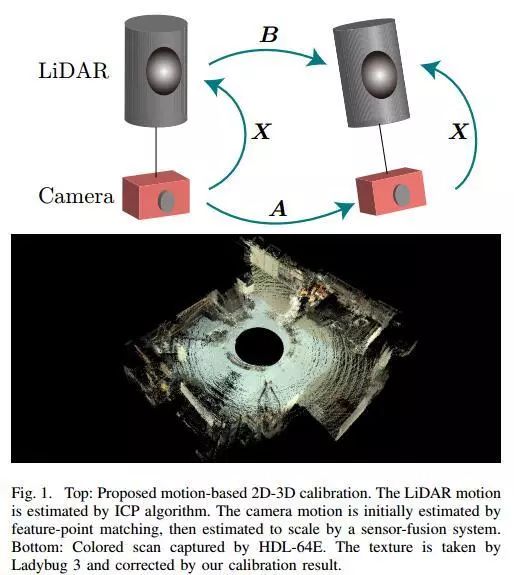

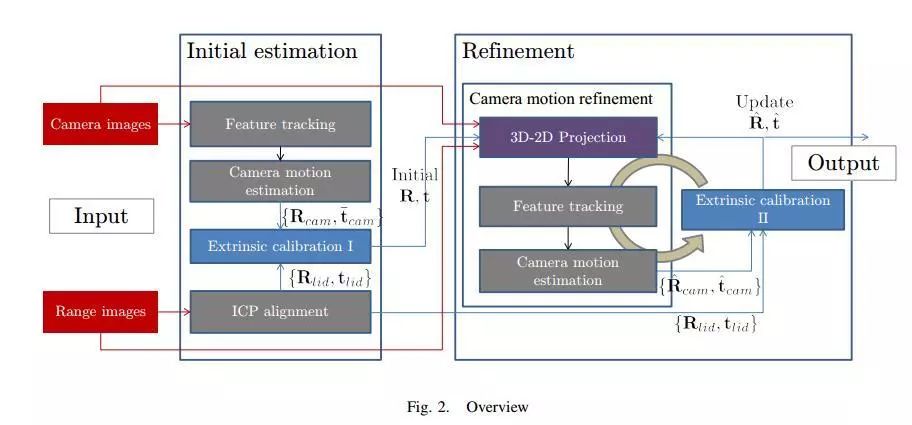

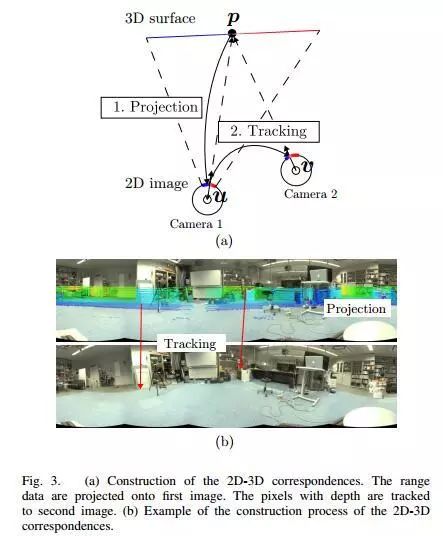

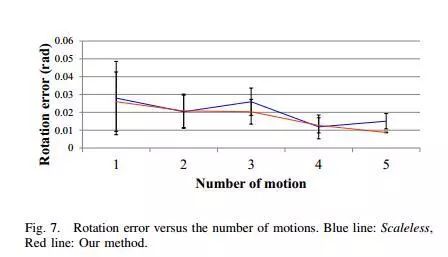

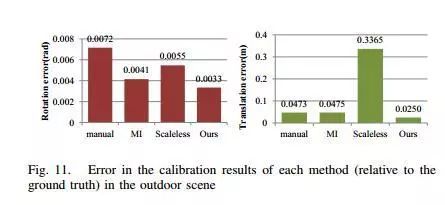

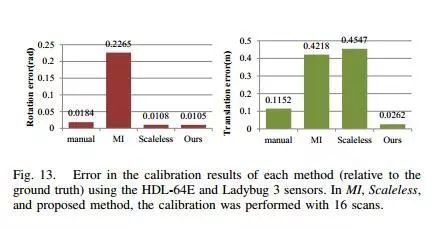

本文提出了一种无目标自动相机-LiDAR校准方法。 我们的方法将手眼校准框架扩展到2D-3D校准。使用传感器融合测距方法精确地计算具有尺度的相机运动。 我们还为我们的校准方法阐明了合适的运动。 而其他校准方法需要LiDAR反射率数据和初始外部参数,而本文所提出的方法仅需要三维点云和相机图像。在室内和室外场景中使用多种传感器配置的实验证明了该方法的有效性。我们的方法比最先进的方法获得更高的准确性。

Abstract

This paper proposes a targetless and automatic camera-LiDAR calibration method. Our approach extends the hand-eye calibration framework to 2D-3D calibration. The scaled camera motions are accurately calculated using a sensor fusion odometry method. We also clarify the suitable motions for our calibration method. Whereas other calibrations require the LiDAR reflectance data and an initial extrinsic parameter, the proposed method requires only the three-dimensional point cloud and the camera image. The effectiveness of the method is demonstrated in experiments using several sensor configurations in indoor and outdoor scenes. Our method achieved higher accuracy than comparable state-of-the-art methods.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com