(KDD'21) 异构图神经网络到底哪家强?清华、微软、阿里、中科院等推出HGB基准!

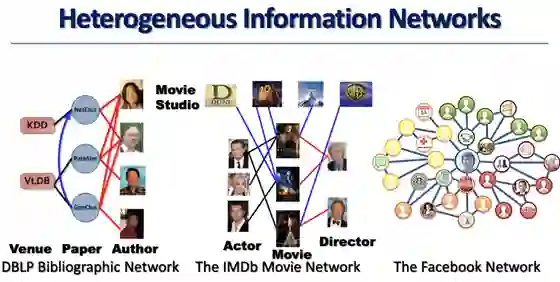

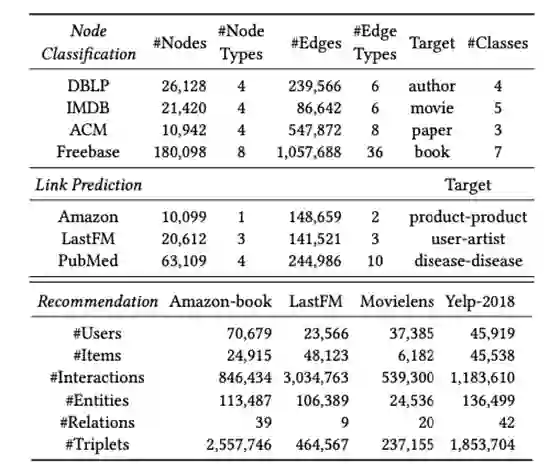

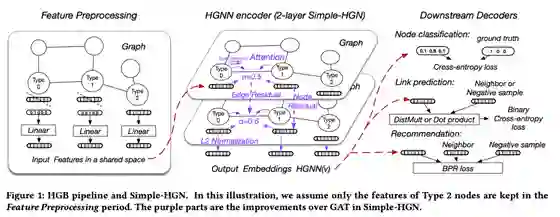

异构图在工业界的诸多场景有着广泛的应用,随着图神经网络的兴起,许多异构图神经网络也如雨后春笋般涌现出来。然而由于缺乏有效的基准数据集,很多工作难以公平比较。今年 KDD上,来自清华、微软、阿里、中科院、宾大等单位的合作者共同推出 Heterogenous Graph Benchmark(HGB)和强基线方法 Simple-HGN,希望可以推动该领域更快更健康地发展。

文章链接: http://keg.cs.tsinghua.edu.cn/jietang/publications/KDD21-Lv-et-al-HeterGNN.pdf

令人担忧的测评结果

强大的新基线模型Simple-HGN

如何开始 HGB 刷榜之旅?

登录查看更多