【泡泡一分钟】在单核CPU上基于RGBD数据实时跟踪3D模型的新方法(CVPR-9)

每天一分钟,带你读遍机器人顶级会议文章

标题:Real-Time 3D Model Tracking in Color and Depth on a Single CPU Core

作者:Kehl, W., Tombari, F., Ilic, S., Navab, N.

来源:CVPR2017

编辑:鲁涛

播音:火箭姚小麦

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

今天介绍一种可以在单核CPU上基于RGBD数据来实时跟踪3D模型的新方法,该文章发表在CVPR2017。

作者展示了如何利用深度数据使跟踪算法更加鲁棒,并最终形式化了一个新的综合了轮廓与ICP(迭代最近点)的跟踪能量函数。通过引入近似性,本文将当前基于区域的最先进跟踪算法加速了一个数量级,且精度几乎不受影响。此外,与现有技术相比,本文的算法效果更好,运行速度更快,可以用单核CPU实现上述所有功能。

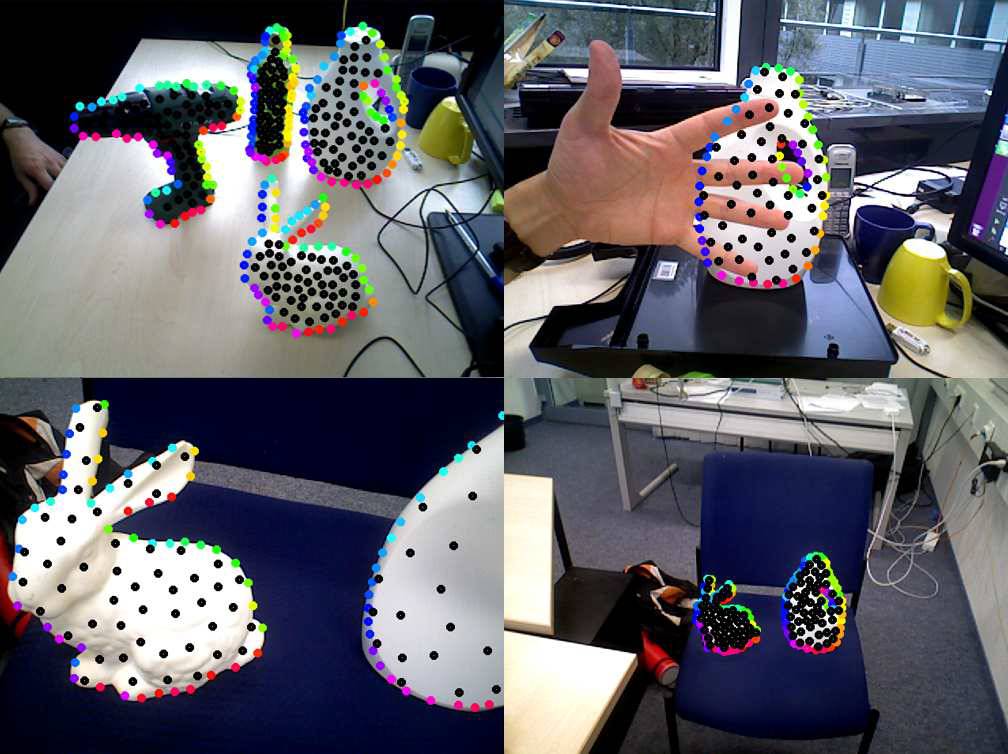

图1.CPU上实时运行效果

具体来说,作者的思路分为三部分:

首先,在离线步骤中提取目标的被遮挡轮廓和内部信息,进而从多个视角预渲染给定目标的3D模型,这样就避免了在线渲染。

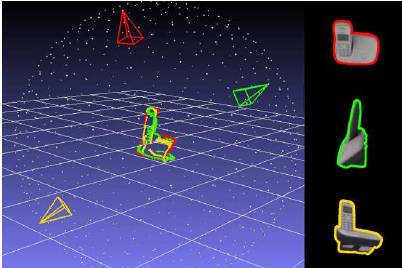

图2. 多个视角采样示意图

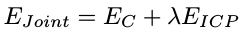

然后,作者一方面综合颜色和深度信息建立了物体轮廓的约束,另一方面,作者形式化了点云对齐的约束,前者的目标是最小化投影误差,而后者则尝试最小化几何误差,这两个不同的优化问题被作者纳入了统一的优化框架中(如下)。

最后,考虑到算法运行过程中,只需要考虑轮廓上的点,而且轮廓上相邻的点提供的信息冗余很多,作者在离线预渲染模型时,只是等间隔地采样了一批点,从而大大降低了计算量。

值得一提的是,在i7平台上,本文算法的C++版大约能以30Hz的频率同时跟踪10个物体。

今天的泡泡一分钟就到这里了,如果你觉得有收获,欢迎转发到朋友圈,让更多人一起学习机器人顶级会议文章。

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

回复关键字“RGBD Tracking”,即可获取本文下载链接。

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com