【泡泡一分钟】基于深度自编码的3D激光点云定位方法(CVPR-14)

每天一分钟,带你读遍机器人顶级会议文章

标题:3D Point Cloud Registration for Localization using a Deep Neural Network Auto-Encoder

作者:Gil Elbaz, Tamar Avraham, Anath Fischer

来源:CVPR 2017

编译:宋方

播音员:清蒸鱼

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是"3D Point Cloud Registration for Localization using a Deep Neural Network Auto-Encoder"——基于深度自编码的3D激光点云定位方法,该文章选自CVPR2017。

本文将介绍一种3D点云定位方法,该方法需要一个全局的3D点云地图,以及几次连续扫描得到局部的点云子集,而无需考虑先验信息。

局部的点云子集又称为超点集。超点集是连续几次扫描得到的、外围具有重合区域的点云,并初步过滤了低质量的、不重要的区域。它们表示环境的几何结构信息。

图1 绿色为超点集,灰色为全局的3D点云地图

然后使用低维描述子表示超点集。通过最先进的自编码深度神经网络的无监督机器学习,进行浅层训练后,可以通过这些描述子进行高效的粗略匹配。

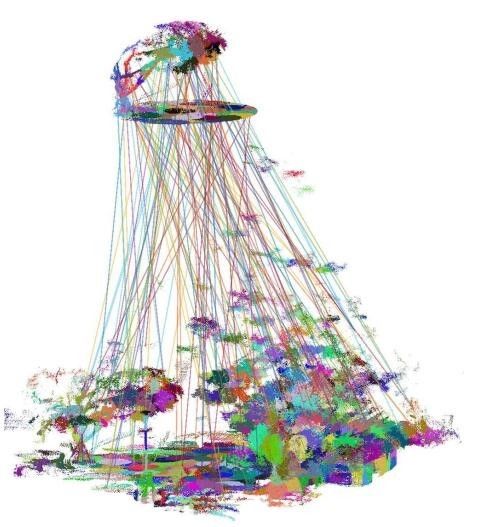

图2 用低维描述子表示超点集后,进行匹配

通常的方法是人工设计关键点描述子的进行粗略匹配,本文利用超点集代替了关键点,这样可以充分利用点云的几何结构关系,进行更准确仿射变换。并借鉴了机器视觉的研究趋势,将自编码深度神经网络应用于局部3D点云。本方法经过许多具有挑战性的点云数据检验,相比以往的方法,在有噪音、缺少数据的情况下,更加鲁棒。

今天的泡泡一分钟就到这里了,如果你觉得有收获,欢迎转发到朋友圈,让更多人一起学习机器人顶级会议文章。

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

回复关键字“点云定位”,即可获取本文下载链接。

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com