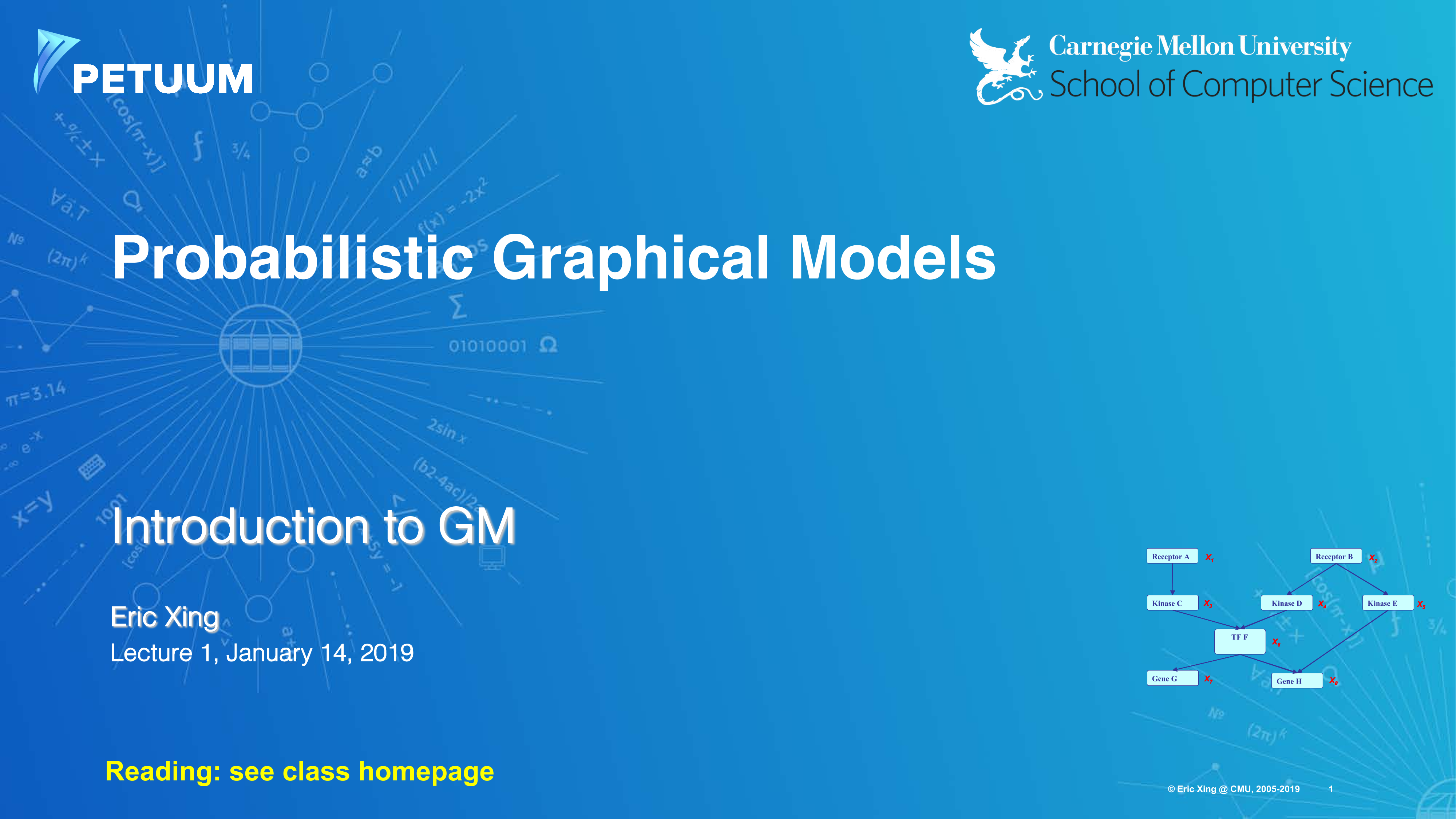

课程介绍

在人工智能、统计学、计算机系统、计算机视觉、自然语言处理和计算生物学等许多领域中的问题,都可以被视为从局部信息中寻找一致的全局结论。概率图模型框架为这些普遍问题提供了统一的视角解决方案,支持在具有大量属性和庞大数据集的问题中进行有效的推理、决策和学习。本研究生课程将为您运用图模型到复杂的问题和解决图模型的核心研究课题提供坚实的基础。

课程大纲

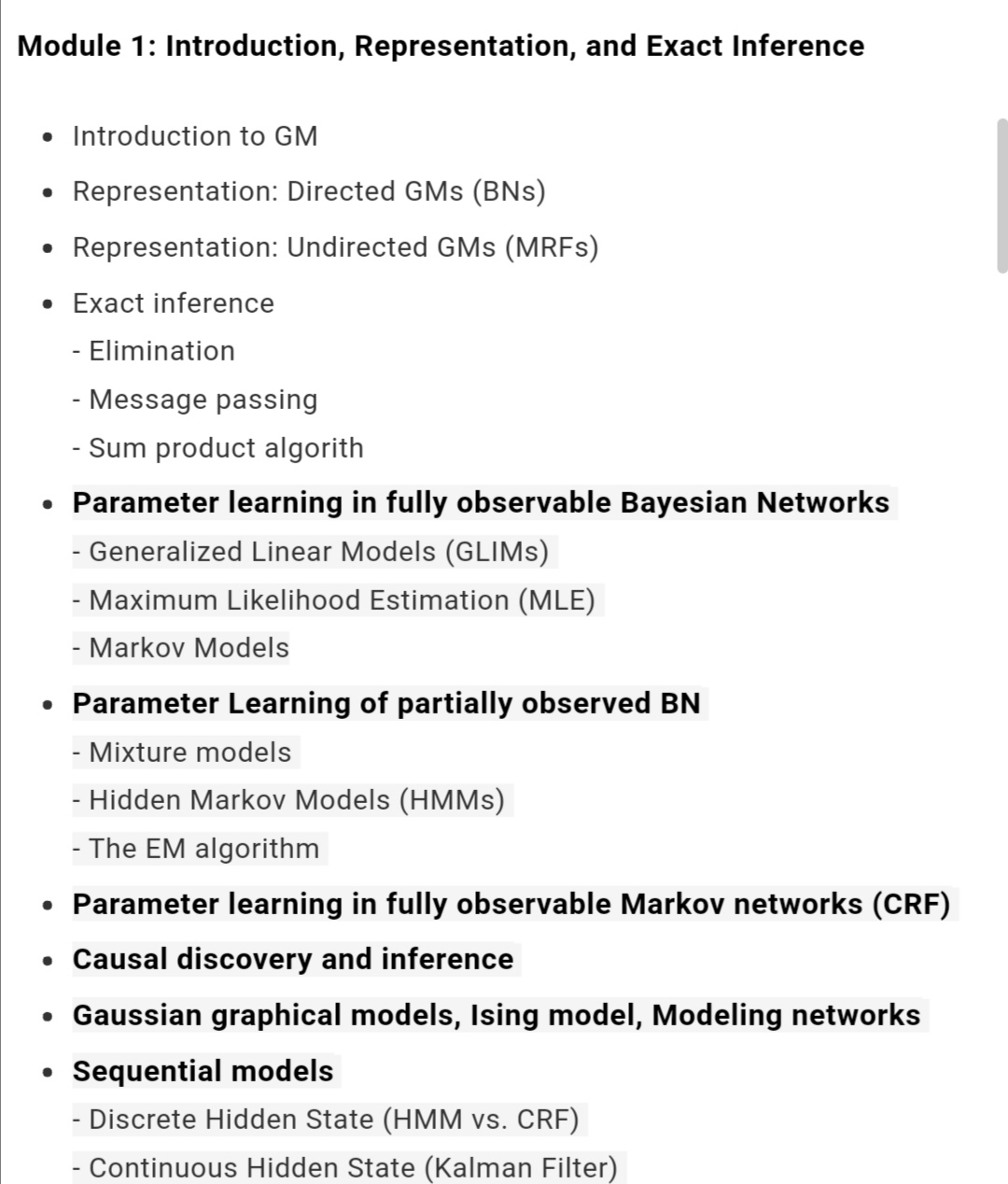

- 模块1 - 简介,表示形式和精确推断

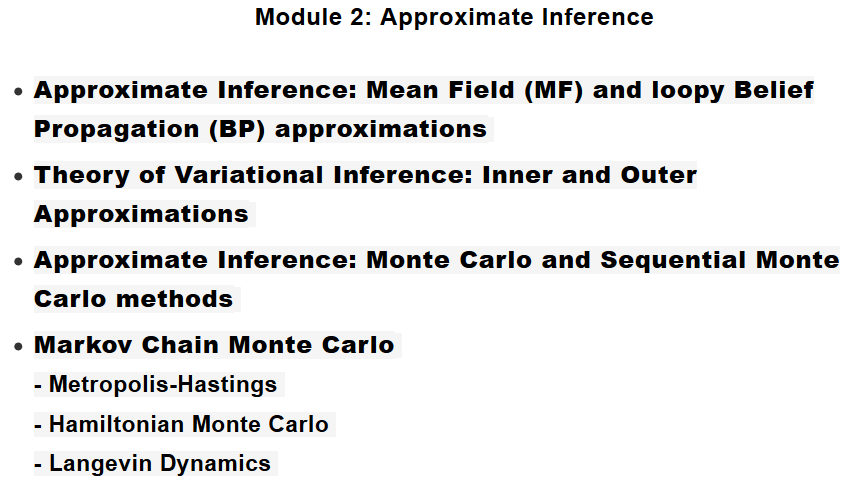

- 模块2 - 近似推断

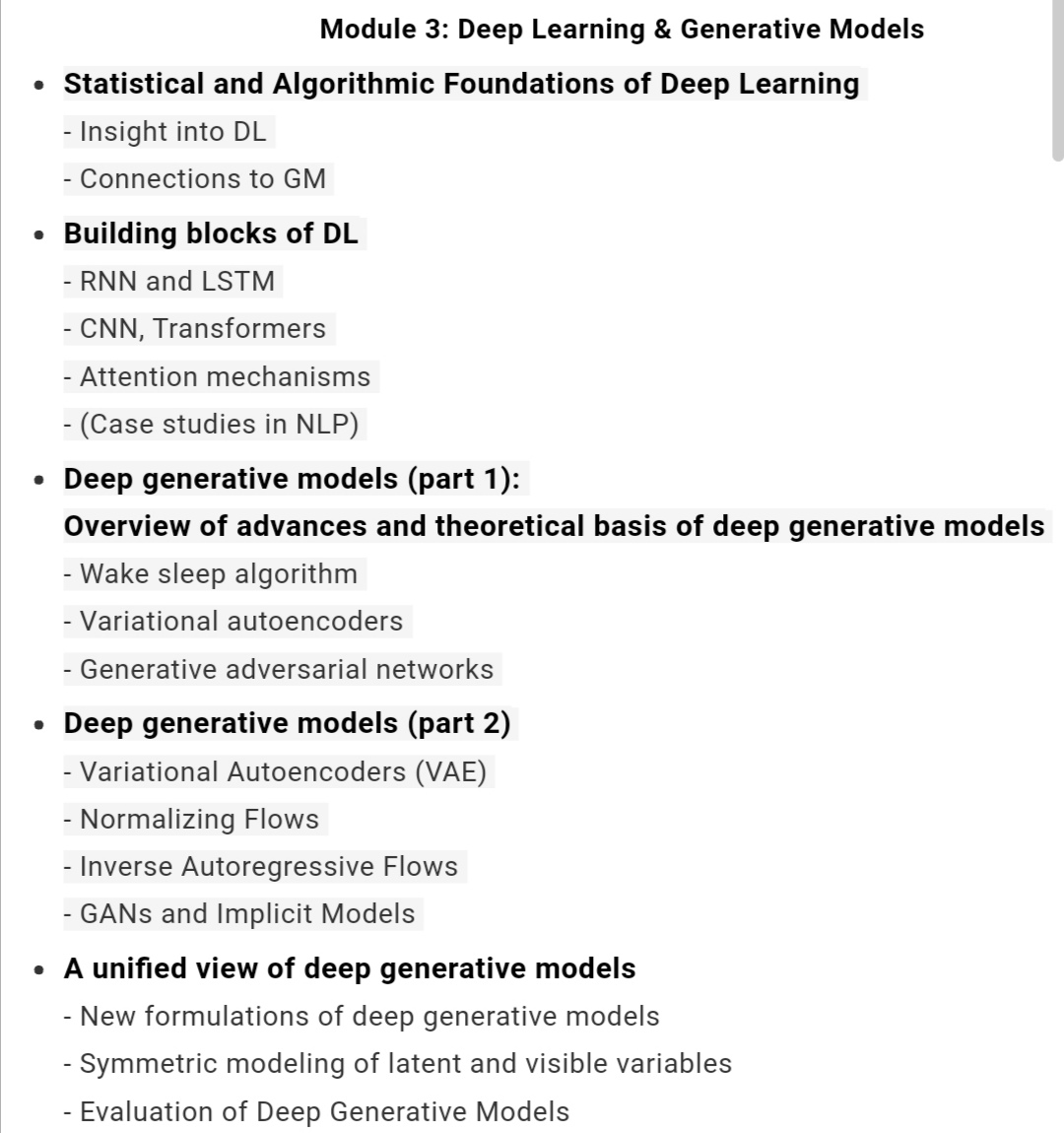

- 模块3 - 深度学习和生成模型

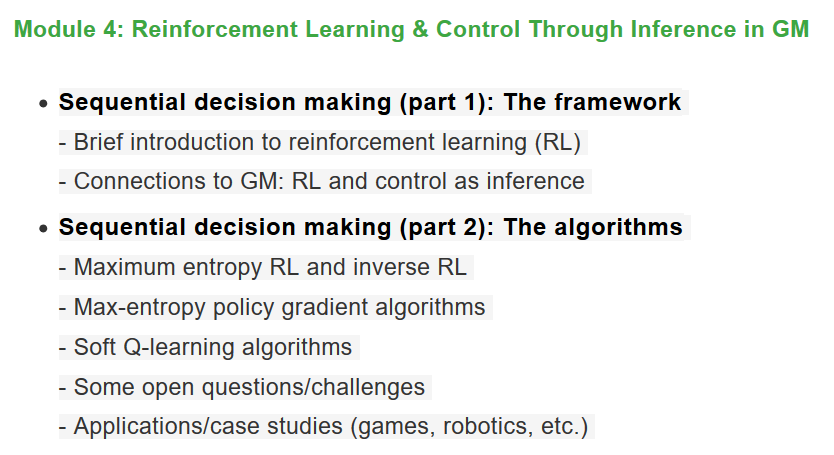

- 模块4 - 通过GM中的推理进行强化学习和控制

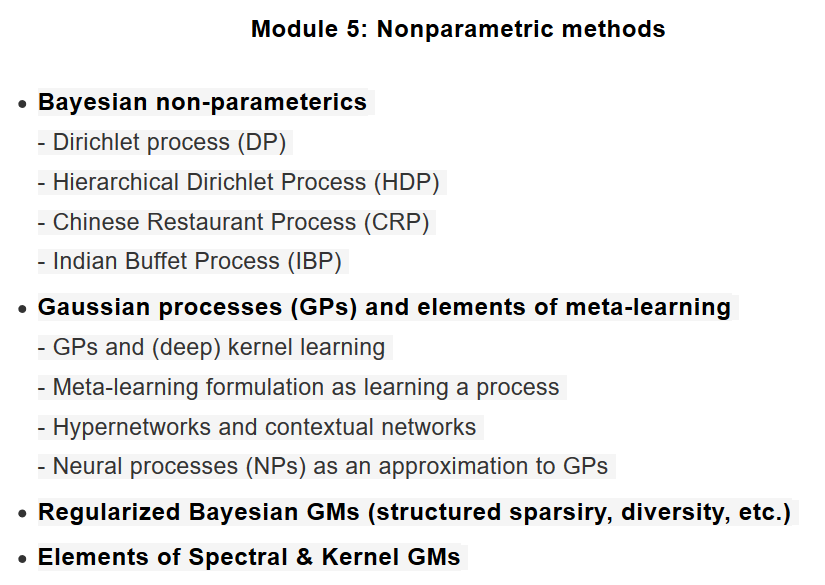

- 模块5 - 非参数方法

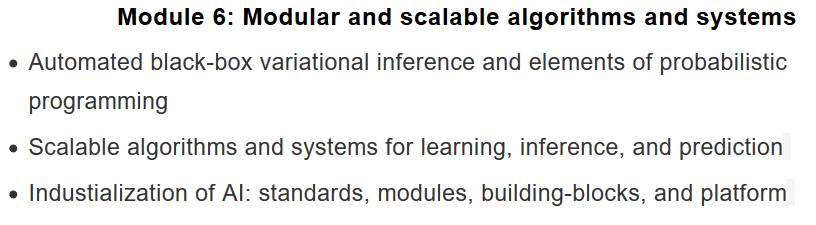

- 模块6 - 模块化和可扩展的算法和系统

讲师:邢波

讲师简介

邢波,卡耐基梅隆大学教授,曾于2014年担任国际机器学习大会(ICML)主席。主要研究兴趣集中在机器学习和统计学习方法论及理论的发展,和大规模计算系统和架构的开发。他创办了Petuum 公司,这是一家专注于人工智能和机器学习的解决方案研发的公司,腾讯曾投资了这家公司。

个人主页:

成为VIP会员查看完整内容

相关内容

卡耐基梅隆大学(Carnegie Mellon University)坐落在宾夕法尼亚州的匹兹堡,是一所享誉世界的私立顶级研究型大学,学校面积不大,学科门类不多,但在其所设立的几乎所有专业都居于世界领先水平。卡内基梅隆大学享誉全国的认知心理学、管理和公共关系学、写作和修辞学、应用历史学、哲学和生物科学专业。它的计算机、机器人科学、理学、美术及工业管理都是举世公认的一流专业。