【课程】斯坦福大学CS236:深度生成模型,附课程材料下载

【导读】本文为大家带来了一份斯坦福大学的最新课程CS236——深度生成模型,目前更新到第一课,感兴趣的同学可以多多关注,跟随学习。

原始链接:

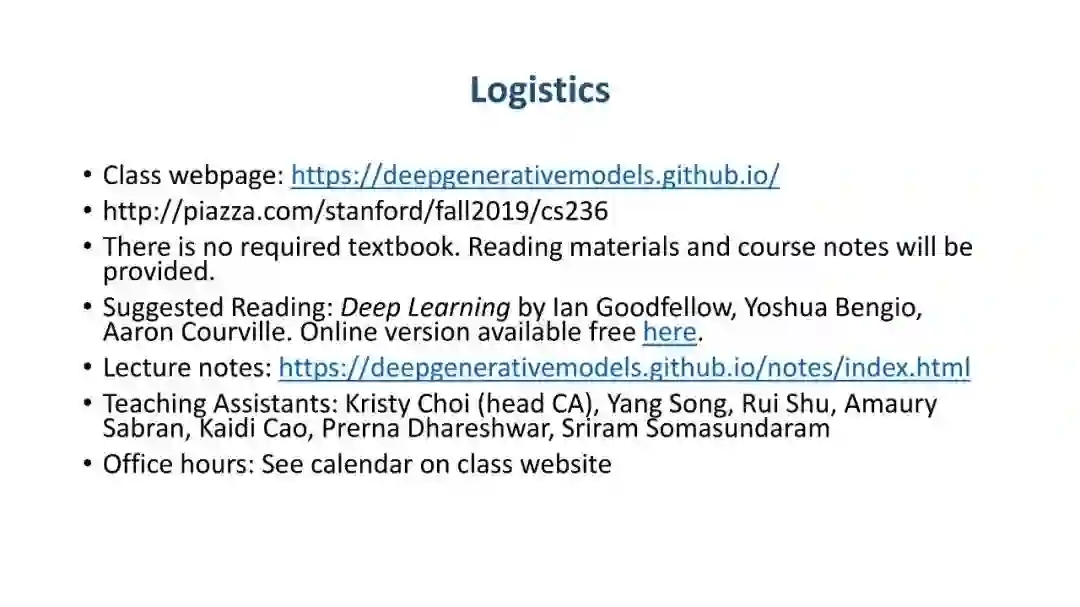

https://deepgenerativemodels.github.io/

1 课程介绍

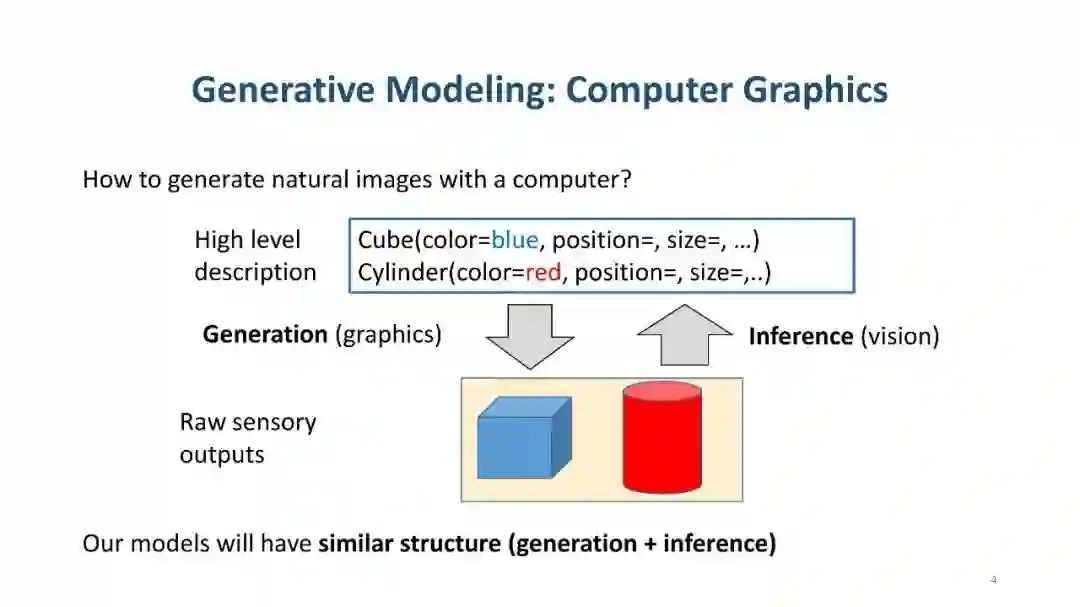

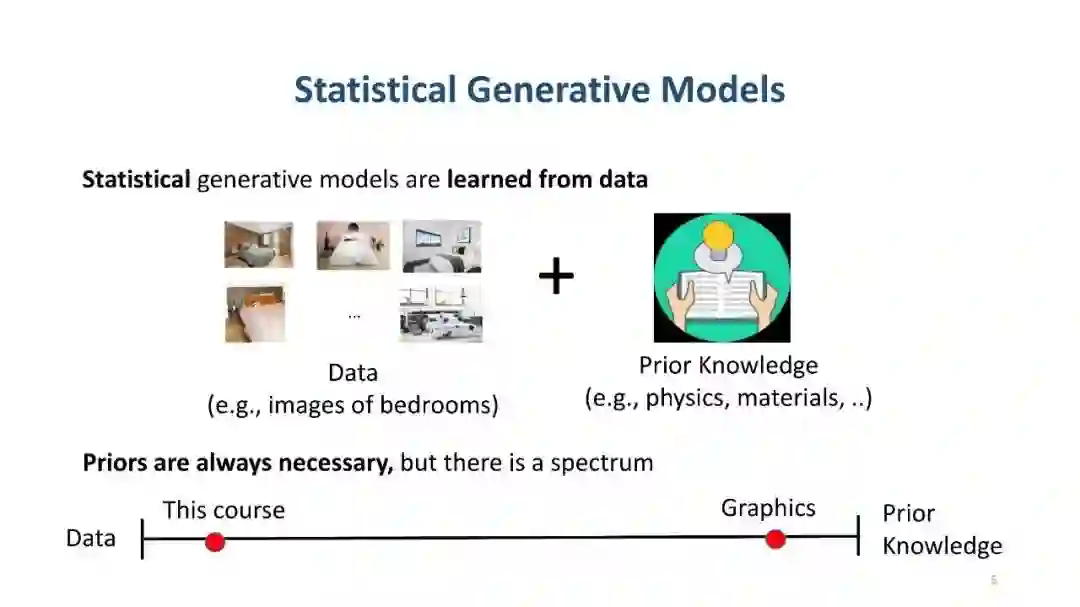

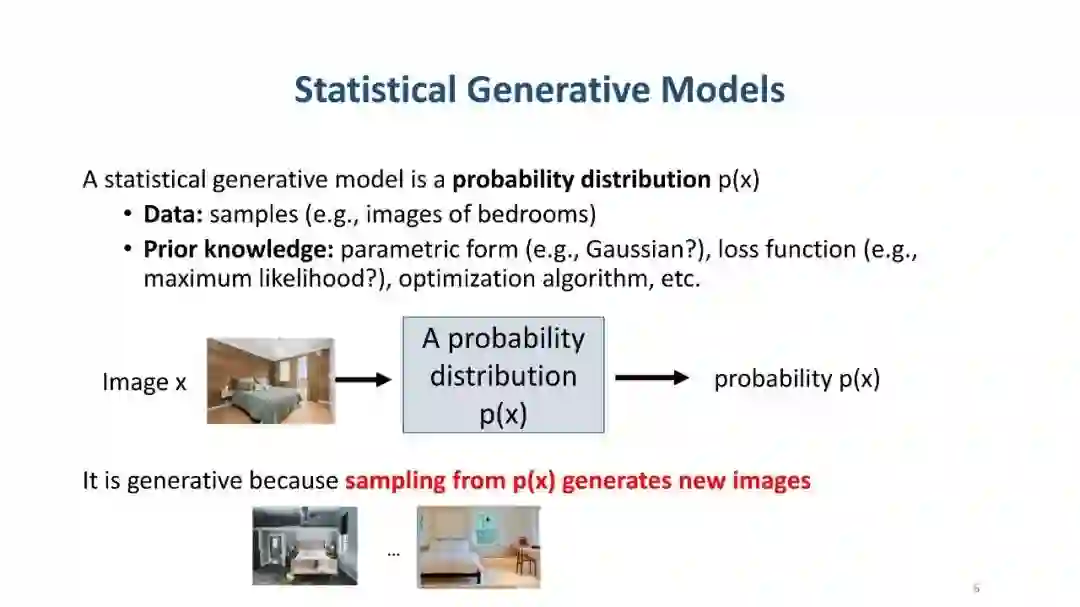

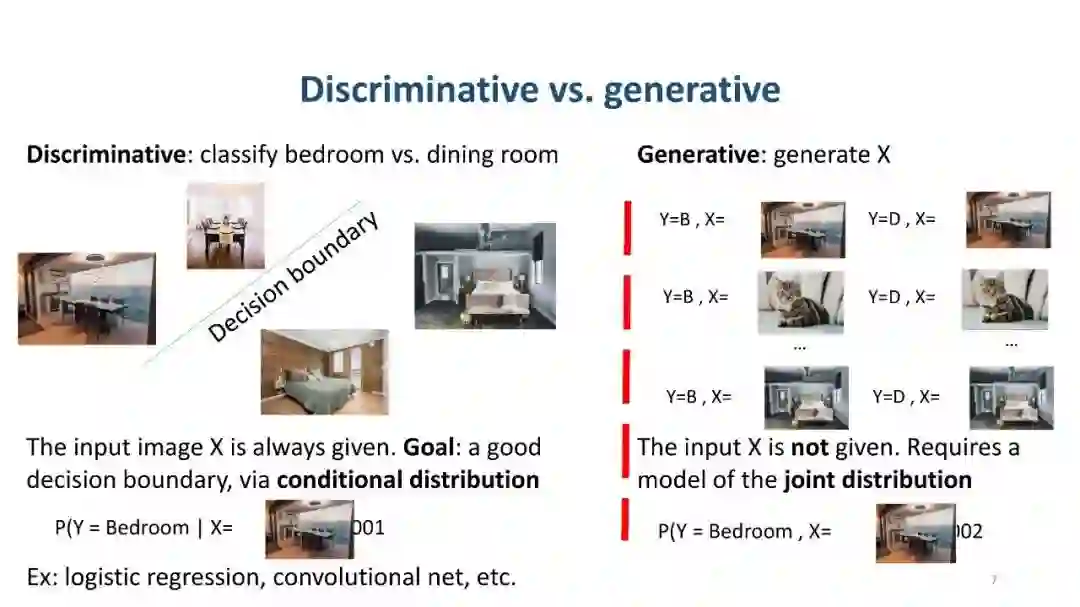

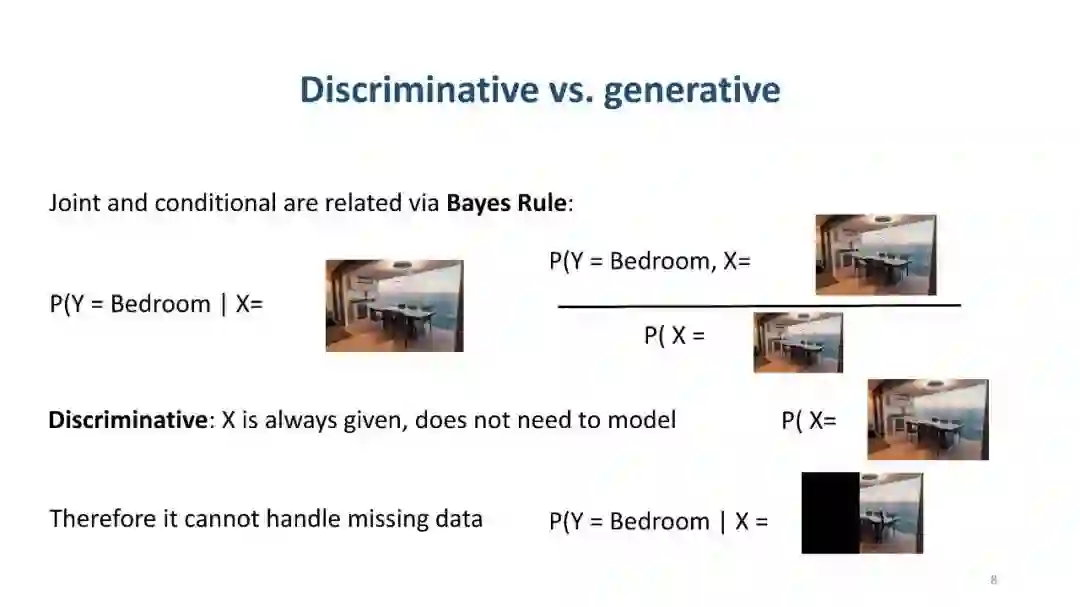

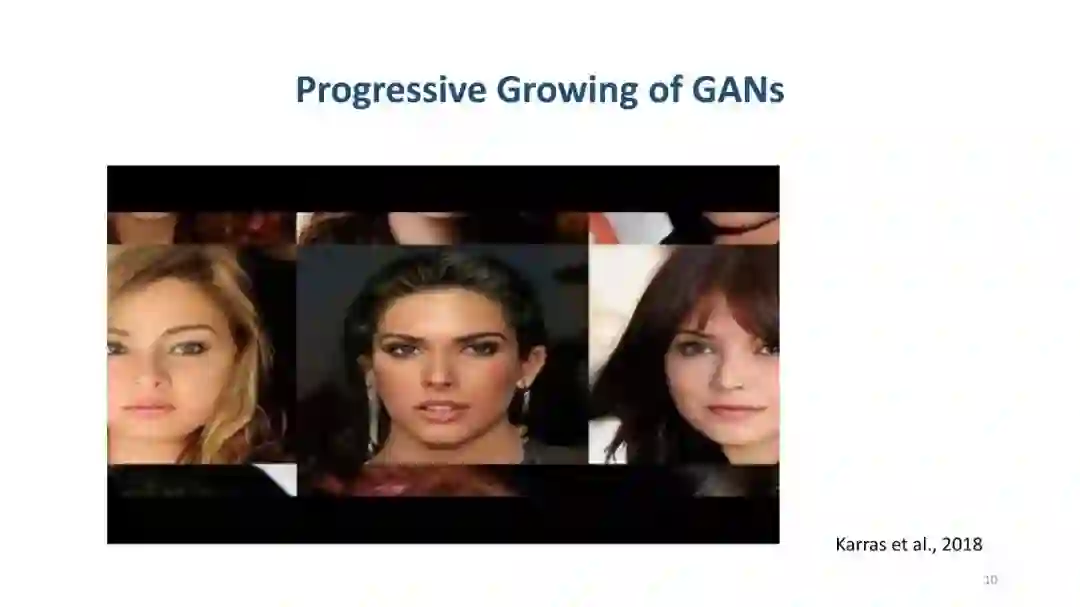

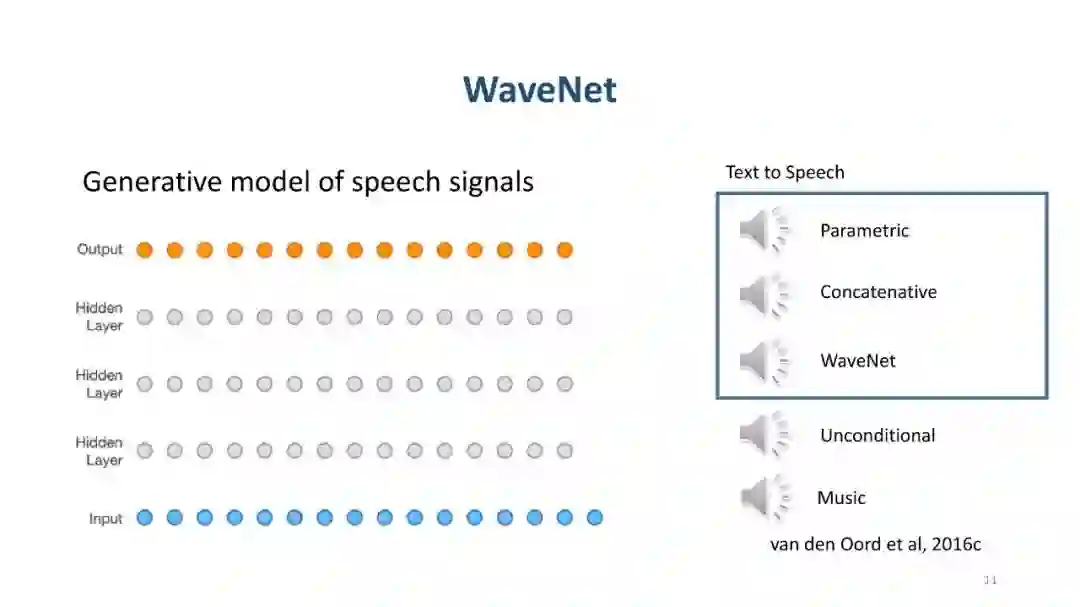

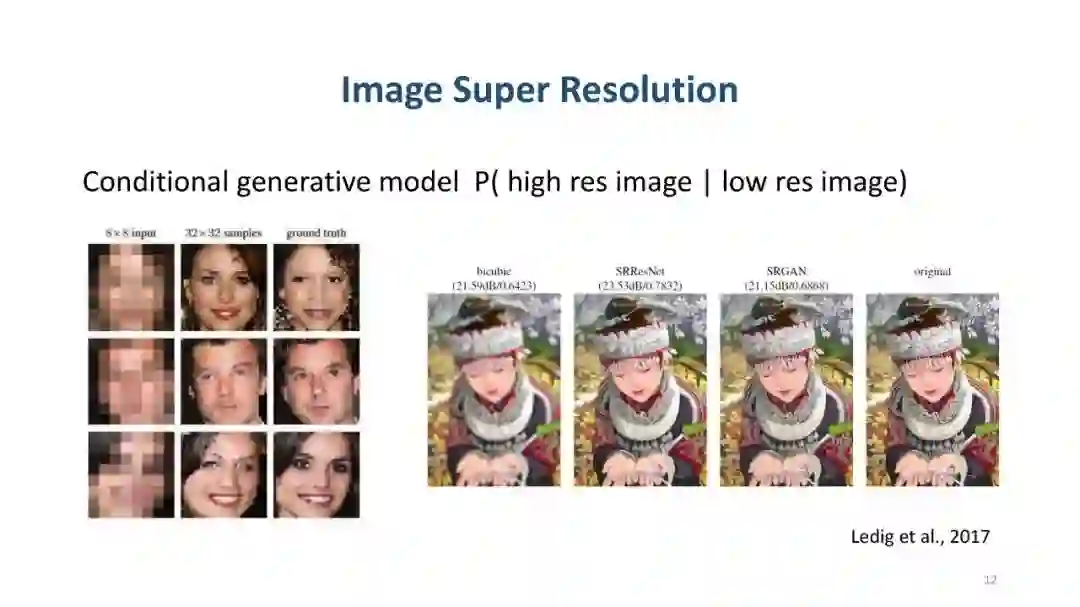

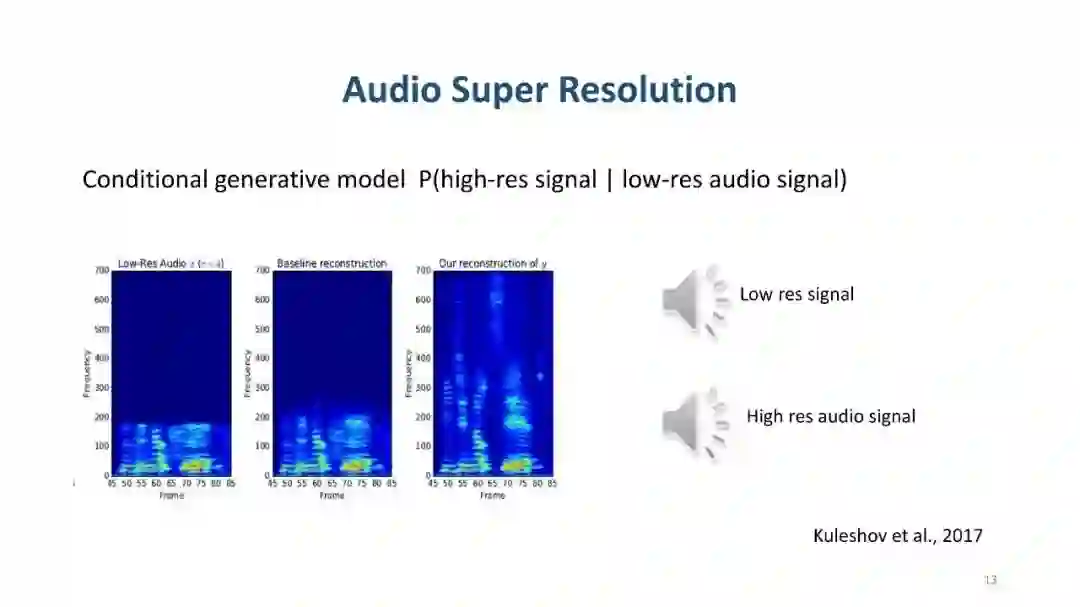

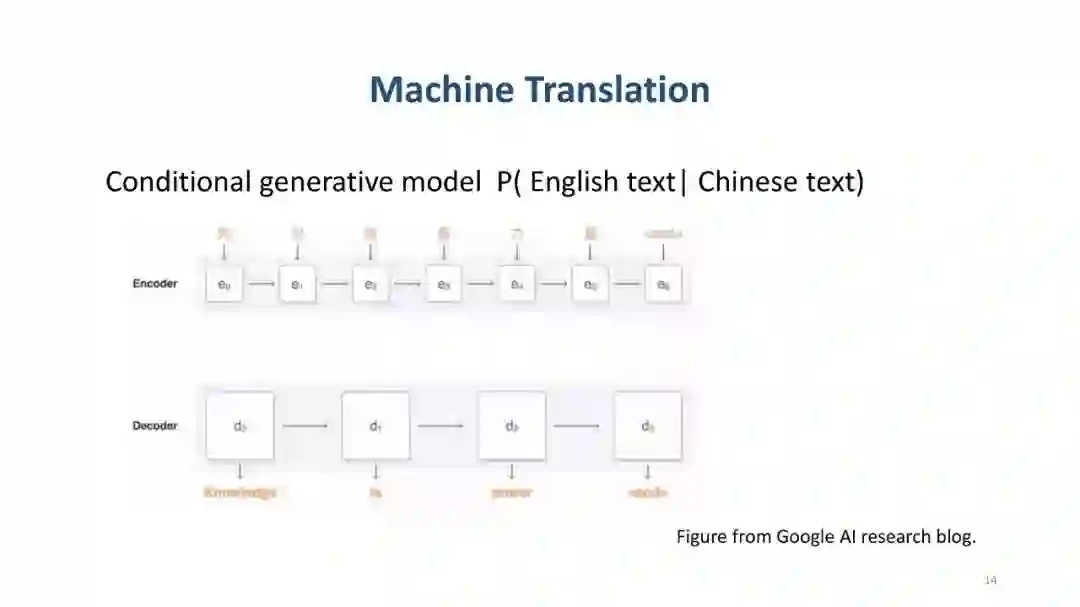

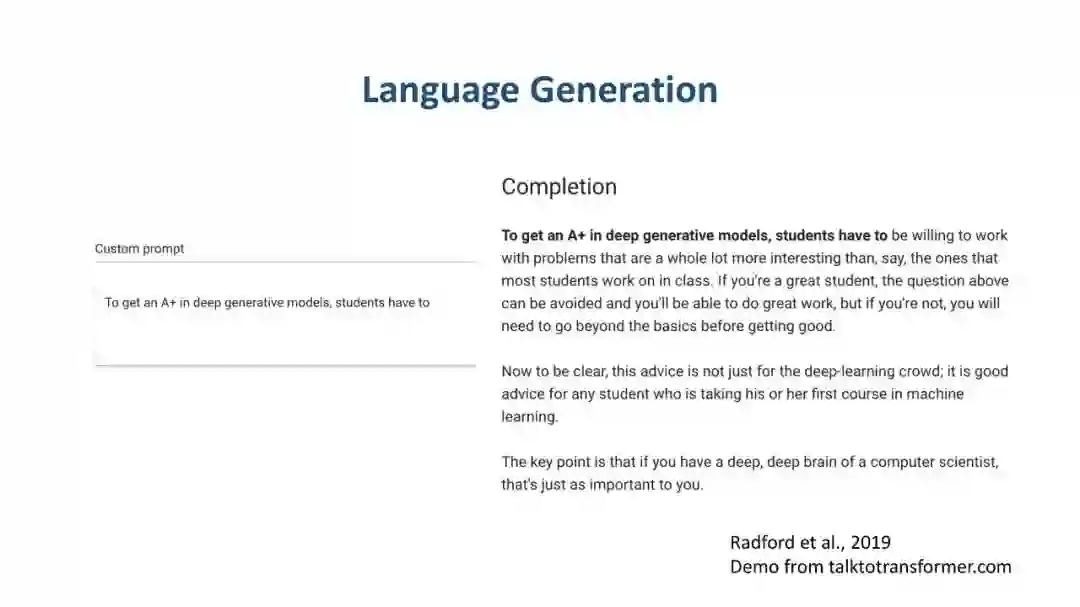

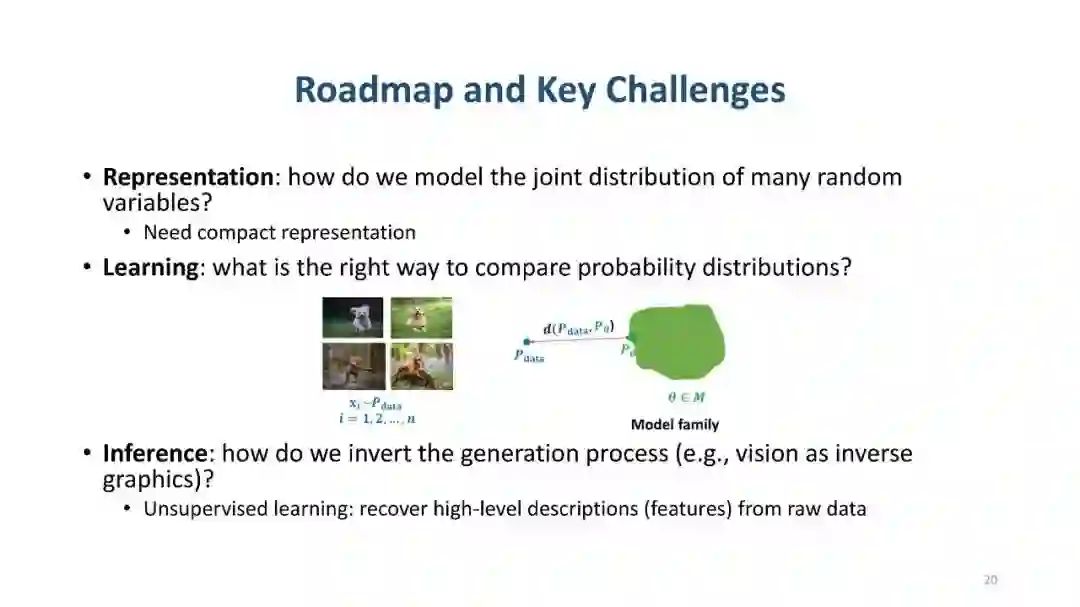

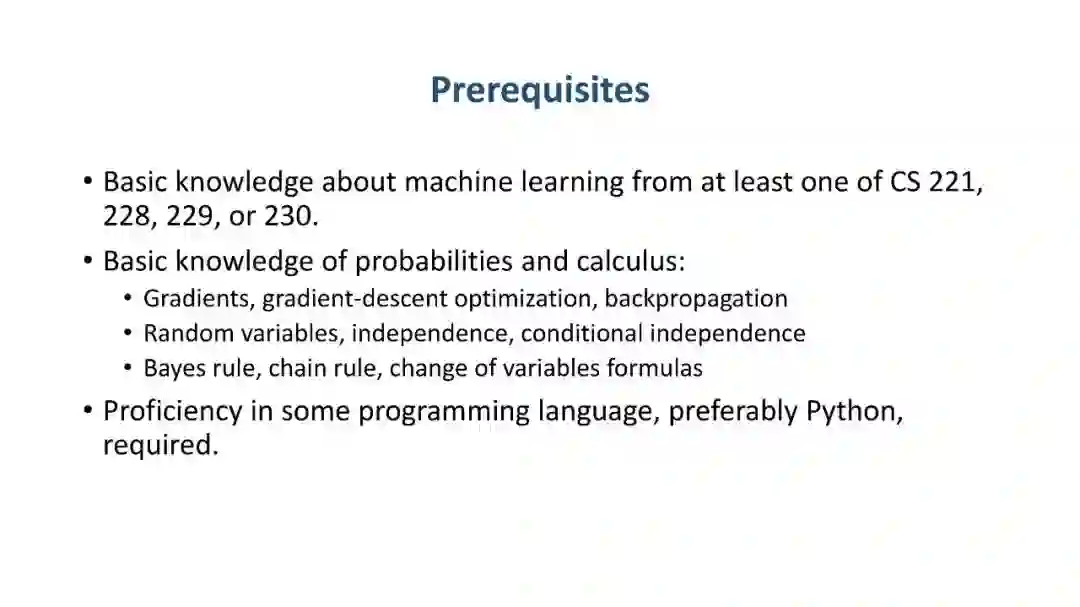

生成式模型被广泛应用到人工智能和机器学习的诸多领域当中。最近,通过结合随机梯度下降的优化方法,使用深度神经网络参数化这些模型所取得的进展,已经使得对于包括图像,文本和语音在内的复杂,高维度数据建模成为可能。在本次课程中,我们将要学习深度生成式模型的概率基础和学习算法,包括自动编码器(AE)的各种变体,生成式对抗网络,自回归模型和标准化流模型(normalizing flow models)。本课程还将讨论从深度生成式模型中获益的应用领域,例如计算机视觉,语音,自然语言处理,图挖掘和强化学习。

2 讲师介绍

Stefano Ermon

斯坦福大学计算机科学学院助理教授,伍兹环境研究所Fellow。他主要研究在图形模型中的可伸缩技术以及精确推理,数据统计建模,大规模组合优化和不确定性下的鲁班决策,特别是在新兴的计算可持续领域。

Aditya Grover

Aditya是斯坦福大学计算机科学在读博士研究生,师从Stefano Ermon。研究主要集中在概率机器学习上,包括生成式模型、近似推理和深度学习。他的研究得到了微软博士奖学金、利伯曼奖学金和数据科学奖学金的资助。自2018年起,他成为斯坦福大学的一名授课型教师,他与人合作设计并教授一门关于深度生成式模型的新课程。

3 附加阅读

Tutorial on Deep Generative Models.

作者Aditya Grover 和Stefano Ermon.IJCAI,2018年7月

https://ermongroup.github.io/generative-models/

Tutorial on Generative Adversarial Networks.

CVPR,2018年6月

https://sites.google.com/view/cvpr2018tutorialongans/

Tutorial on Deep Generative Models.

作者Shakir Mohamed 和 Danilo Rezende.UAI,2017年7月

https://www.youtube.com/watch?v=JrO5fSskISY

Tutorial on Generative Adversarial Networks.

NIPS,2016年11月

https://www.youtube.com/watch?v=AJVyzd0rqdc

Learning deep generative models.

作者Ruslan Salakhutdinov.期刊Annual Review of Statistics and Its Application,2015年4月

https://www.cs.cmu.edu/~rsalakhu/papers/annrev.pdf

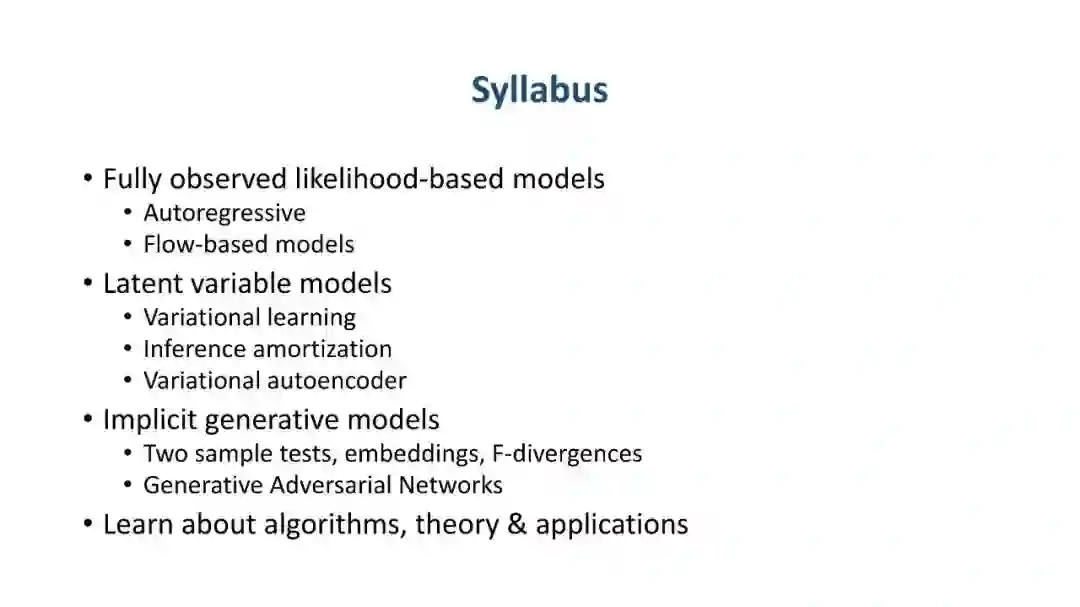

4 课程目录

背景介绍

自回归模型

自动编码器的各种变体

标准化流模型

生成式对抗网络

对生成式模型的评价

基于能量的模型(结合生成式模型的变体)

潜在变量建模中的不连续性

视觉,语音,语言,图,强化学习的应用

生成式对抗模仿学习

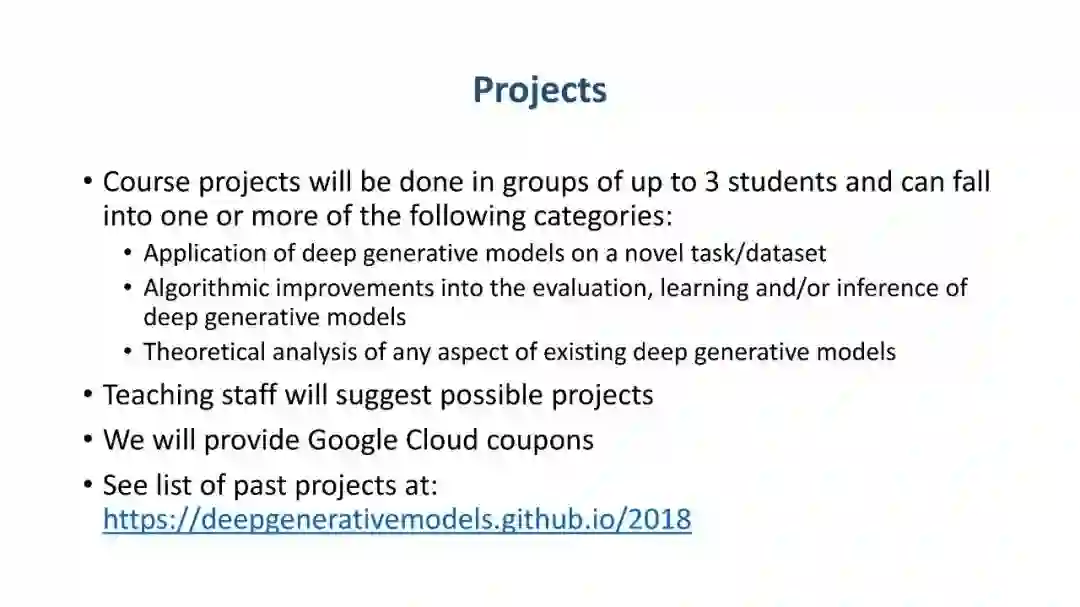

5 课程材料预览

请关注专知公众号(点击上方蓝色专知关注)

后台回复“2019CS236” 就可以获取课程背景材料的下载链接~

-END-

专 · 知

专知,专业可信的人工智能知识分发,让认知协作更快更好!欢迎登录www.zhuanzhi.ai,注册登录专知,获取更多AI知识资料!

欢迎微信扫一扫加入专知人工智能知识星球群,获取最新AI专业干货知识教程视频资料和与专家交流咨询!

请加专知小助手微信(扫一扫如下二维码添加),加入专知人工智能主题群,咨询技术商务合作~

专知《深度学习:算法到实战》课程全部完成!560+位同学在学习,现在报名,限时优惠!网易云课堂人工智能畅销榜首位!

点击“阅读原文”,了解报名专知《深度学习:算法到实战》课程