Embracing Single Stride 3D Object Detector with Sparse Transformer

Lue Fan, Ziqi Pang, Tianyuan Zhang, Yu-Xiong Wang, Hang Zhao, Feng Wang, Naiyan Wang, Zhaoxiang Zhang

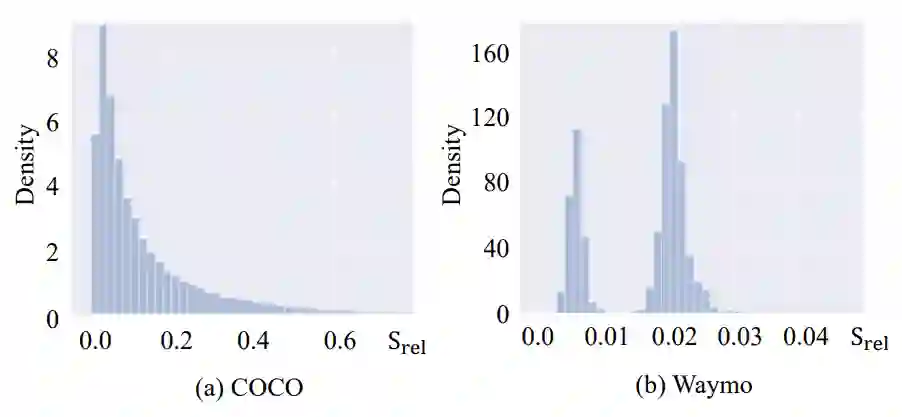

在自动驾驶场景中,相比于整个场景的尺度,单个物体的尺度通常很小。下图展示了COCO数据集和Waymo数据集上物体相对尺度的分布情况:

COCO和Waymo上物体相对尺度分布

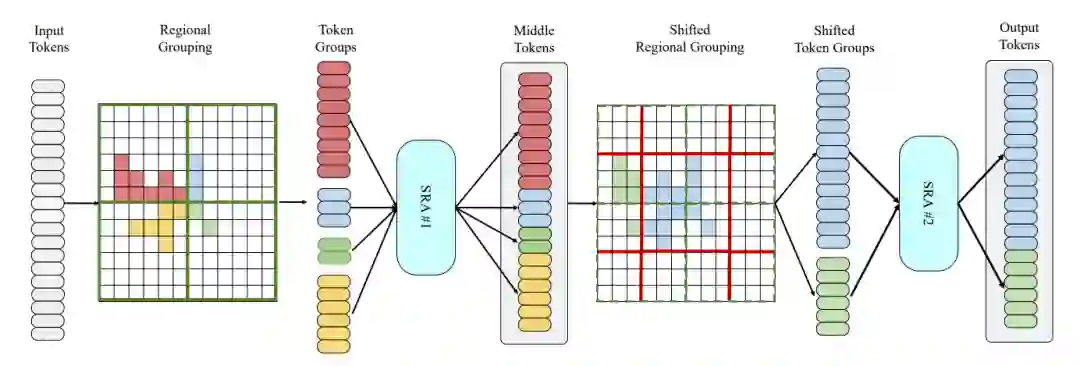

这一特性往往被基于Pillar或者体素的检测器所忽略,它们通常借用了成熟的2D多尺度检测器的结构。基于这一考量,本文探索了单步长(无降采样)的检测器结构。如果简单地将卷积网络提升为单步长网络,会取得一定的性能提升,但是会带来感受野不足的问题以及巨大的计算量。为了得到一个高效高性能的单步长检测器,我们借用了当前流行的swin transformer的结构,舍弃了其多尺度的结构并且针对点云数据的特点将其稀疏化,我们将其命名为单步长稀疏Transformer(Single-stride Sparse Transformer, SST)。我们在当前最大的3D检测数据集Waymo Open Dataset上做了详尽的实验,从各个方面探讨了SST的特性,并取得了SoTA的性能,特别是在小物体上比之前的方法有了显著的提升(达到了83.8的Level 1 AP)。代码已开源在:

https://github.com/wuhuikai/DeepGuidedFilter

Sparse Attention结构设计

成为VIP会员查看完整内容

相关内容

专知会员服务

18+阅读 · 2022年3月19日