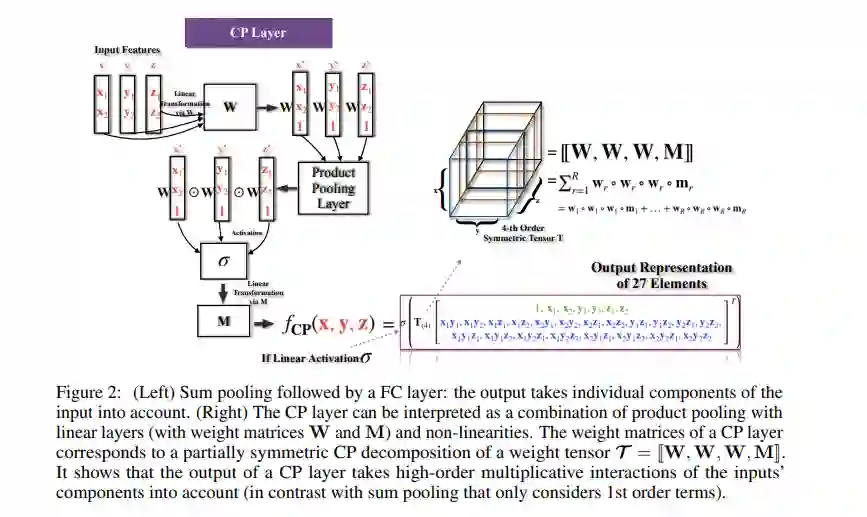

图神经网络(GNNs)因其对各种图结构数据建模的有效性和灵活性而受到越来越多的关注。现有的GNN架构通常采用简单的池化操作(例如,sum, average, max)来聚合来自本地邻域的消息以更新节点表示,或从整个图中池化节点表示来计算图表示。尽管这些线性操作简单有效,但并不能模拟节点之间的高阶非线性相互作用。我们提出了张量化图神经网络(tGNN),一种高度表达的GNN架构,依赖张量分解来建模高阶非线性节点相互作用。tGNN利用对称CP分解有效地参数化置换不变的多线性映射,以建模节点交互。对节点和图分类任务的理论和实证分析表明,tGNN优于竞争基线。特别是,tGNN在两个OGB节点分类数据集和一个OGB图分类数据集上取得了最可靠的结果。

https://www.zhuanzhi.ai/paper/2de87380a06dbea659315283c2b53bd1

成为VIP会员查看完整内容