题目: Hyperbolic Graph Attention Network

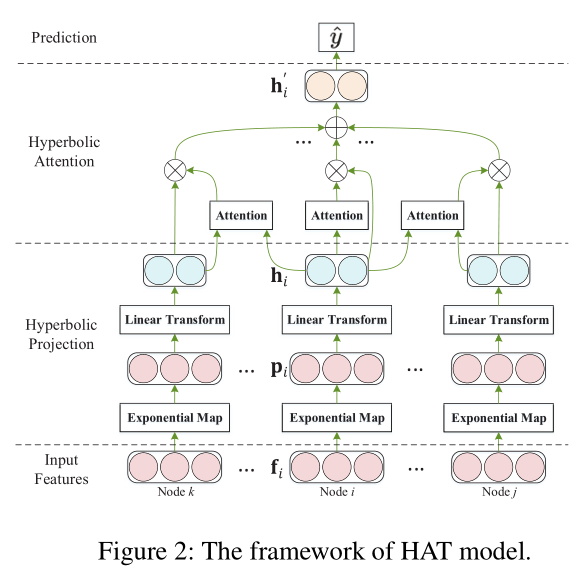

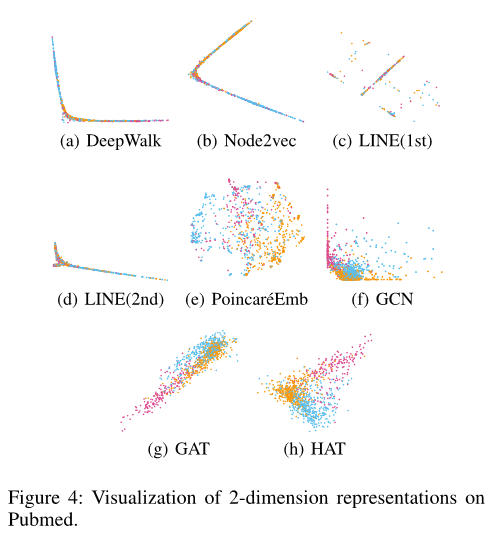

摘要: 图神经网络(GNN)在图处理方面表现出了优越的性能,近年来引起了人们的广泛关注。然而,大多数现有的GNN模型主要是为欧几里得空间中的图设计的。最近的研究已经证明,图数据显示非欧几里得潜在的解剖学。不幸的是,到目前为止,很少有研究GNN在非欧几里得的设置。为了弥补这一缺陷,本文首次对双曲空间中具有注意机制的GNN进行了研究。双曲GNN的研究有一些独特的挑战:由于双曲空间不是向量空间,不能进行向量操作(如向量的加法、减法和标量乘法)。为了解决这个问题,我们使用回旋向量空间,它提供了一个优雅的代数形式的双曲几何,以转换图的特征;在此基础上,我们提出了基于双曲接近的注意力聚合机制。此外,由于双曲空间中的数学运算比欧几里得空间中的更为复杂,我们进一步设计了一种新的利用对数和指数映射的加速策略来提高模型的效率。通过与其他最先进的基线方法的比较,发现在四个真实数据集上的综合实验结果证明了我们提出的双曲图注意力网络模型的性能。

成为VIP会员查看完整内容

相关内容

专知会员服务

60+阅读 · 2020年6月28日

专知会员服务

116+阅读 · 2019年12月30日

Arxiv

6+阅读 · 2019年8月17日