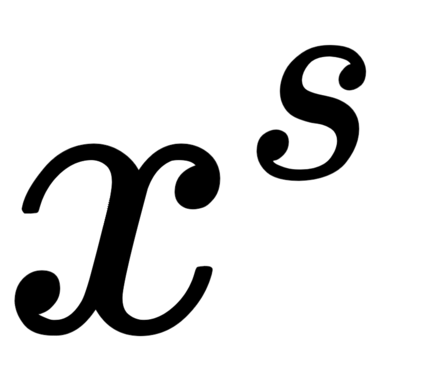

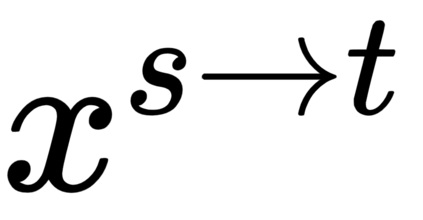

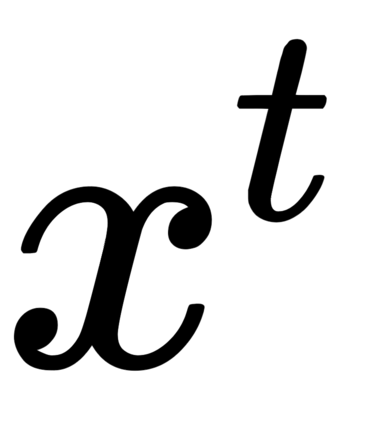

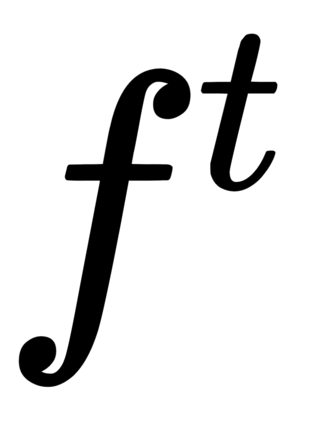

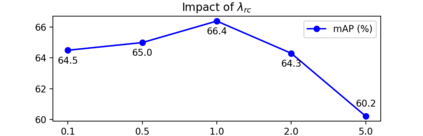

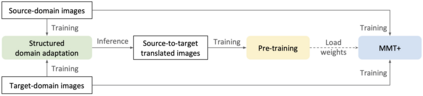

Unsupervised domain adaptation (UDA) aims at adapting the model trained on a labeled source-domain dataset to an unlabeled target-domain dataset. The task of UDA on open-set person re-identification (re-ID) is even more challenging as the identities (classes) do not have overlap between the two domains. One major research direction was based on domain translation, which, however, has fallen out of favor in recent years due to inferior performance compared to pseudo-label-based methods. We argue that the domain translation has great potential on exploiting the valuable source-domain data but existing methods did not provide proper regularization on the translation process. Specifically, previous methods only focus on maintaining the identities of the translated images while ignoring the inter-sample relations during translation. To tackle the challenges, we propose an end-to-end structured domain adaptation framework with an online relation-consistency regularization term. During training, the person feature encoder is optimized to model inter-sample relations on-the-fly for supervising relation-consistency domain translation, which in turn, improves the encoder with informative translated images. The encoder can be further improved with pseudo labels, where the source-to-target translated images with ground-truth identities and target-domain images with pseudo identities are jointly used for training. In the experiments, our proposed framework is shown to achieve state-of-the-art performance on multiple UDA tasks of person re-ID. With the synthetic-to-real translated images from our structured domain-translation network, we achieved second place in the Visual Domain Adaptation Challenge (VisDA) in 2020.

翻译:未经监督的域适应(UDA) 旨在将在标签的源域数据集上培训的模型调整为未标记的目标域数据集。 UDA在开放设置的人的重新识别(re-ID)上的任务甚至更具挑战性,因为身份(类)在两个域之间没有重叠。一个主要研究方向是以域翻译为基础,但近年来由于与假标签方法相比性能低劣,这种翻译已经失去优势。我们认为,域翻译在利用宝贵的源域数据方面具有巨大的潜力,但现有方法并没有为翻译过程提供适当的规范化。具体地说,以前的方法只侧重于维护已翻译的图像的身份,而忽视了翻译过程中的图象之间的关系。为了应对挑战,我们提议了一个端对端对端的域适应框架,而一个在线关系一致性规范术语。在培训期间,个人特征编码被优化到模拟内部内部关系,用以监督关联域域数据翻译,而现有的方法并没有为翻译过程的域域域域翻译提供适当的正规化图像, 与我们使用的域域域图图像共同显示的域域变的域变的域图。