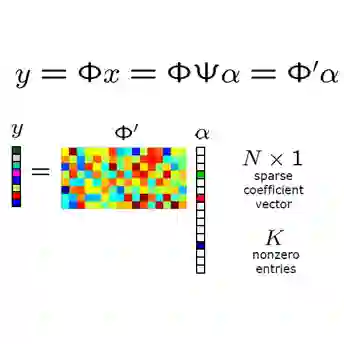

Sparse reconstruction is an important aspect of modern medical imaging, reducing the acquisition time of relatively slow modalities such as magnetic resonance imaging (MRI). Popular methods are based mostly on compressed sensing (CS), which relies on the random sampling of Fourier coefficients ($k$-space) to produce incoherent (noise-like) artefacts that can be removed via convex optimisation. Hardware constraints currently limit Cartesian CS to one dimensional (1D) phase-encode undersampling schemes, leading to coherent and structured artefacts. Reconstruction algorithms typically deploy an idealised and limited 2D regularisation for artefact removal, which increases the difficulty of image recovery. Recognising that phase-encode artefacts can be separated into contiguous 1D signals, we develop two decoupling techniques that enable explicit 1D regularisation. We thereby leverage the excellent incoherence characteristics in the phase-encode direction. We also derive a combined 1D + 2D reconstruction technique that further takes advantage of spatial relationships within the image, leading to an improvement of existing 2D deep-learned (DL) recovery techniques. Performance is evaluated on a brain and knee dataset. We find the proposed 1D CNN modules significantly improve PSNR and SSIM scores compared to the base 2D models, demonstrating a superior scaling of performance compared to increasing the size of 2D network layers.

翻译:广受欢迎的方法主要基于压缩感测(CS),它依靠随机抽样抽取Fleier 系数(k$-space),以产生可以通过凝固优化去除的不相容(类似噪声的)工艺品。硬件限制目前将卡斯特因CS(CS)的高度不相容特性限制在一维(1D)级下标,从而导致有条不紊和结构化的人工制品。重建算法通常采用理想化和有限的 2D 常规化来清除人工制品,这增加了图像恢复的难度。认识到分阶段编码工艺品可以分离成连续的 1D 信号,我们开发了两种脱钩技术,使1D 常规化变得明显。我们因此利用了阶段编码方向上极好的不相容特征。我们还获得了一种1D + 2D 级重建技术,进一步利用了图像内的空间关系,从而改进了现有的2D 深度学习(D) 恢复技术,这增加了图像恢复的难度。认识到分阶段工艺可以分为2级,我们用SISMM的升级的成绩比2级模型,我们用SMIS1级的成绩对S的成绩进行了评估。