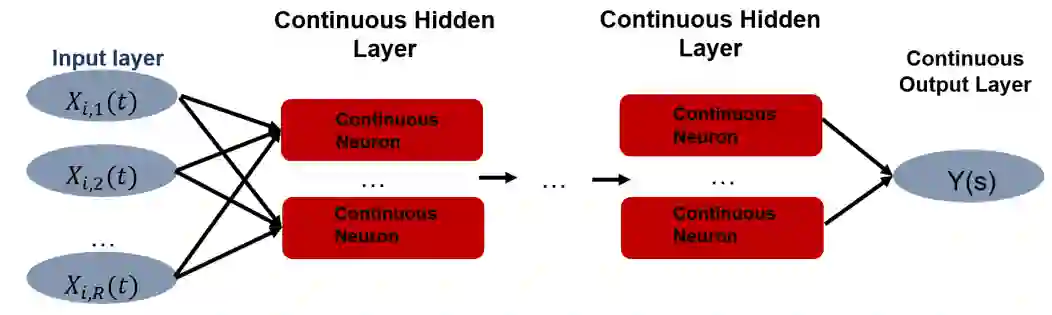

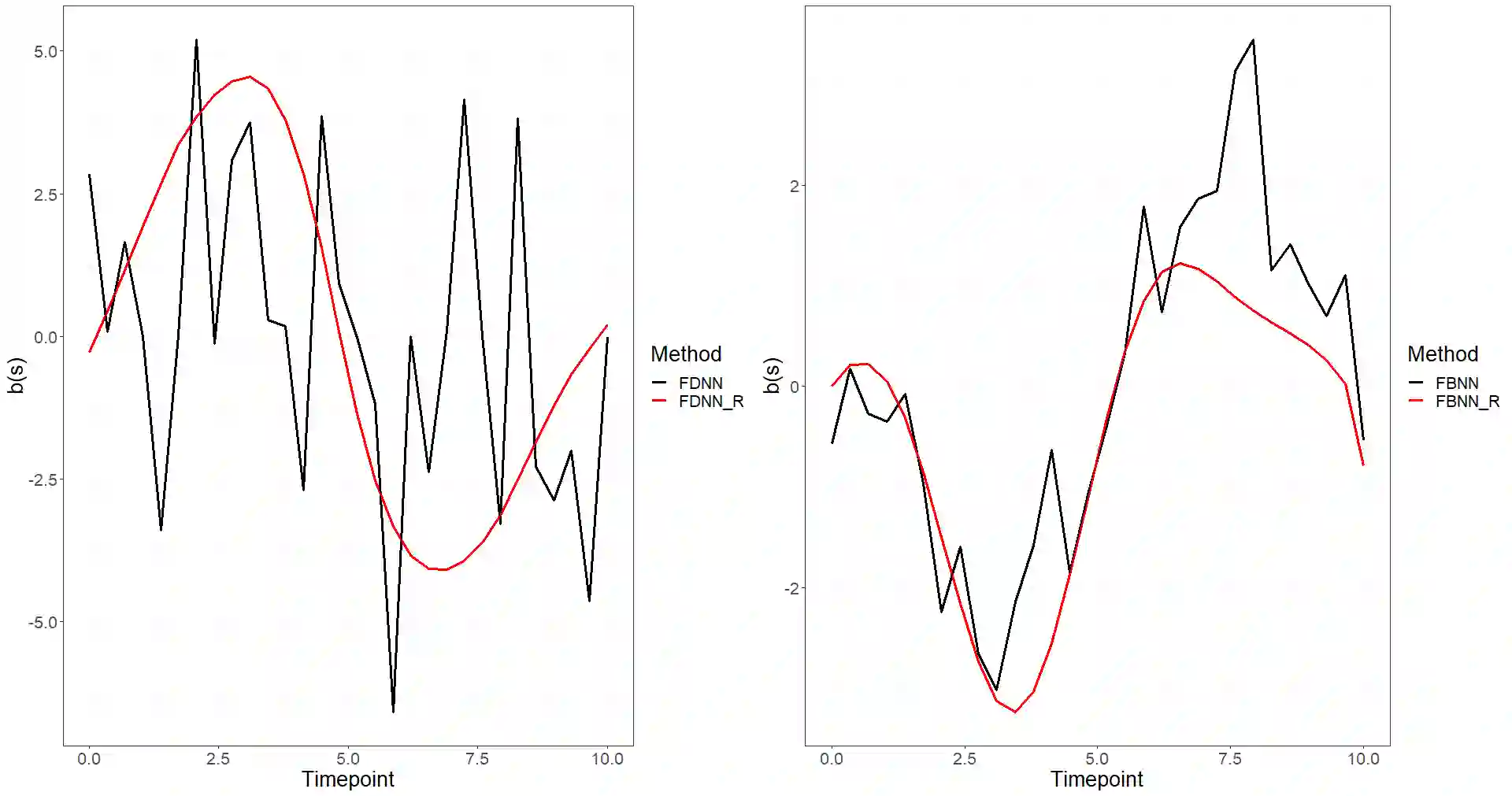

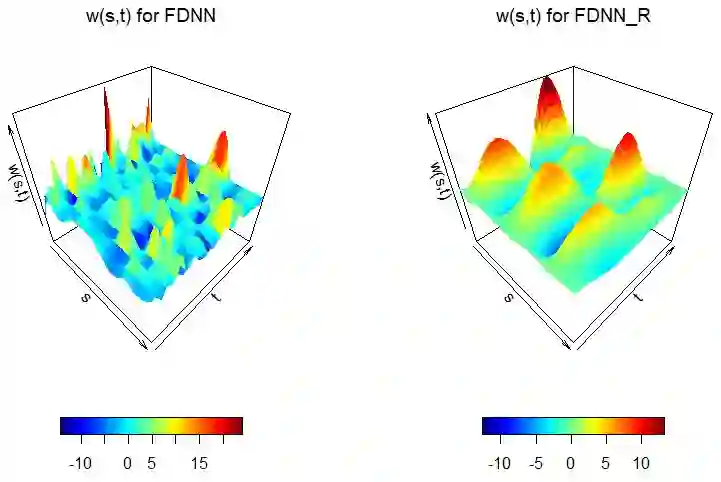

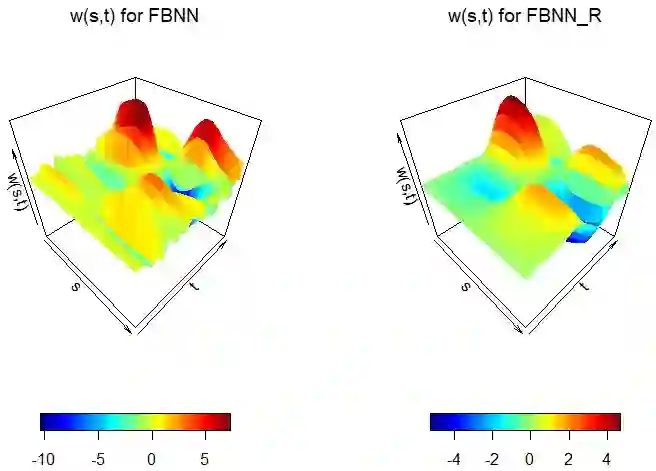

We introduce a new class of non-linear function-on-function regression models for functional data using neural networks. We propose a framework using a hidden layer consisting of continuous neurons, called a continuous hidden layer, for functional response modeling and give two model fitting strategies, Functional Direct Neural Network (FDNN) and Functional Basis Neural Network (FBNN). Both are designed explicitly to exploit the structure inherent in functional data and capture the complex relations existing between the functional predictors and the functional response. We fit these models by deriving functional gradients and implement regularization techniques for more parsimonious results. We demonstrate the power and flexibility of our proposed method in handling complex functional models through extensive simulation studies as well as real data examples.

翻译:我们为使用神经网络的功能数据引入了新型非线性功能功能-功能回归模型。我们提出了一个框架,利用由连续神经元组成的隐性层,称为连续隐性层,用于功能反应建模,并给出了两种模型适当战略,即功能直接神经网络(FDNN)和功能基础神经网络(FBNN),两者都明确旨在利用功能数据固有的结构,并捕捉功能预测器和功能反应器之间存在的复杂关系。我们将这些模型相匹配,通过生成功能梯度,并采用正规化技术以取得更相似的结果。我们通过广泛的模拟研究以及真实的数据实例,展示了我们处理复杂功能模型的拟议方法的力量和灵活性。