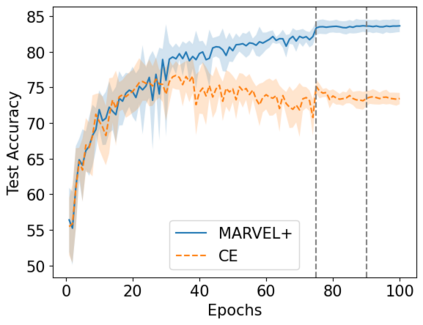

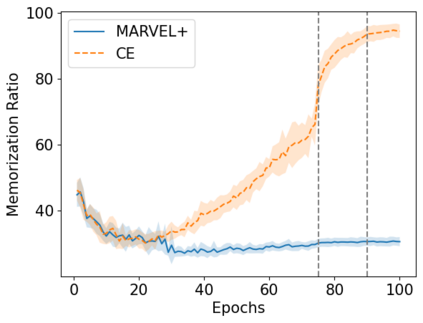

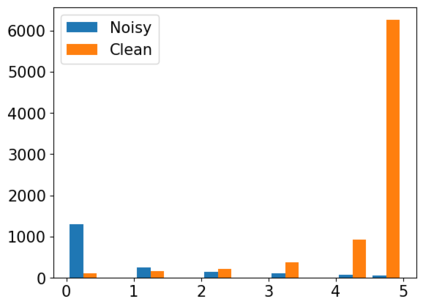

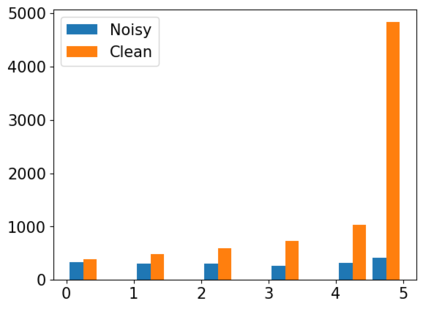

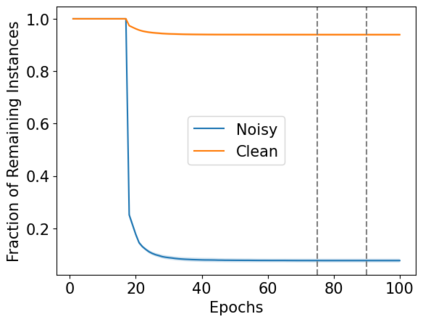

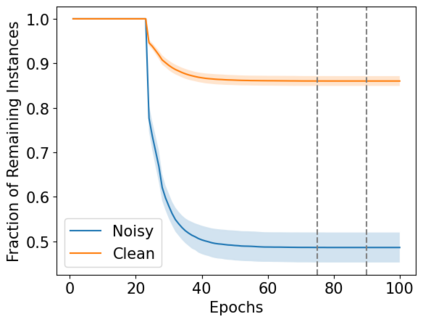

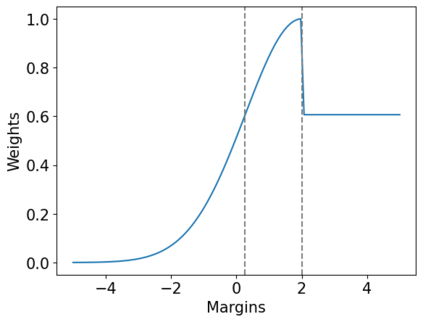

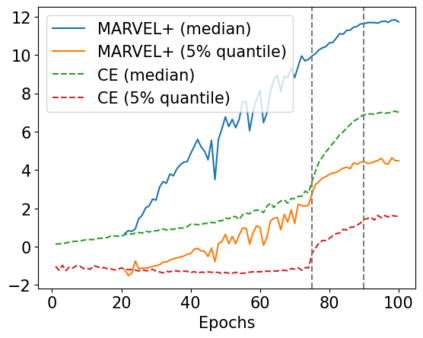

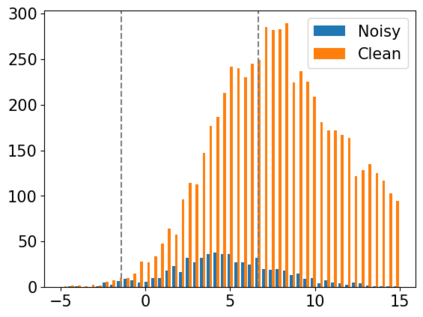

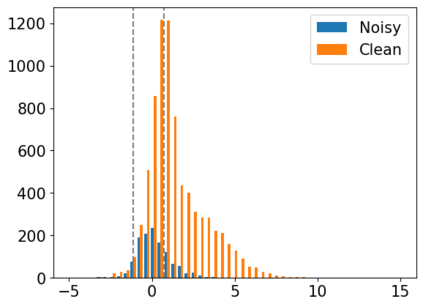

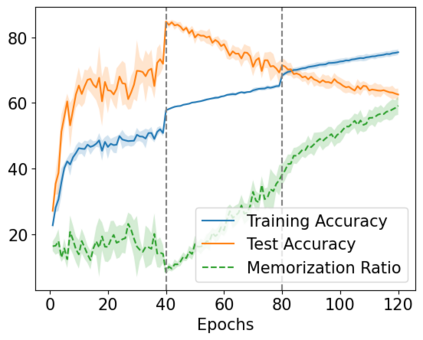

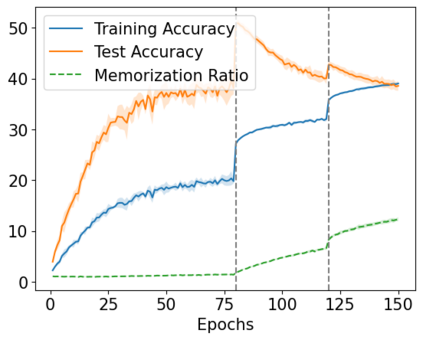

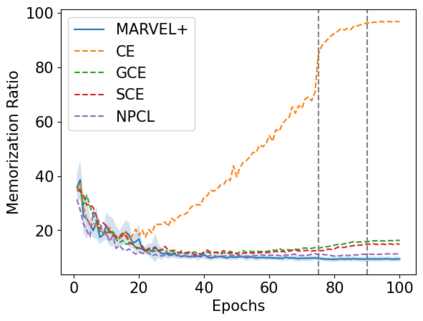

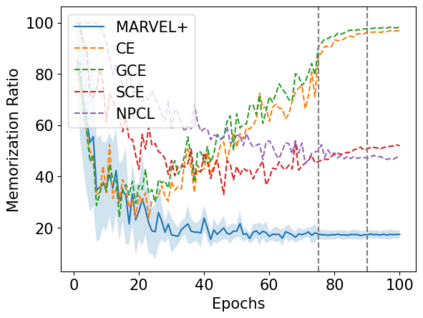

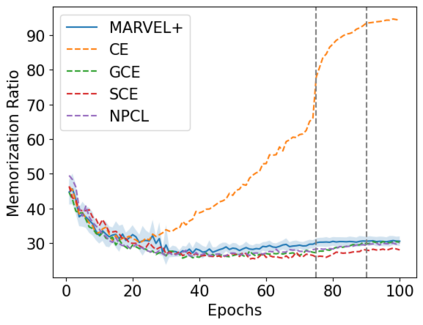

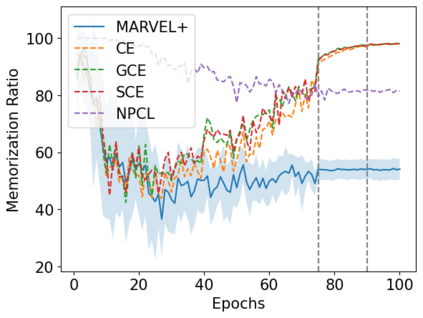

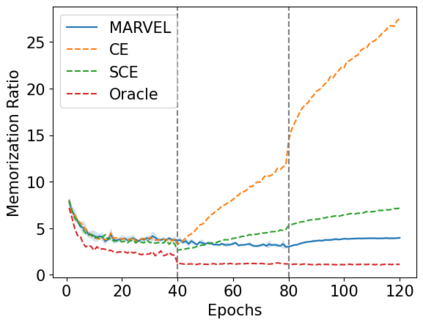

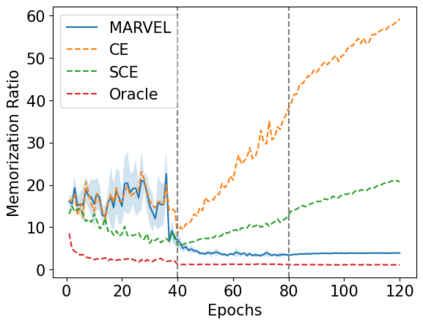

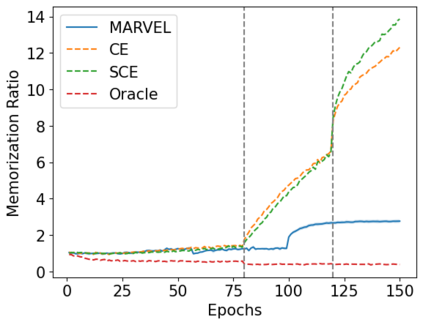

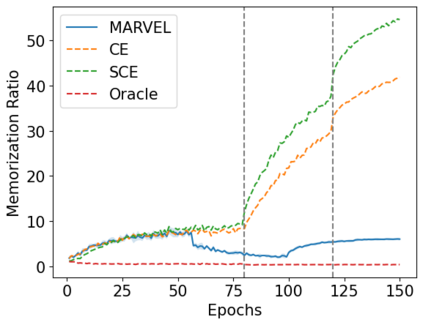

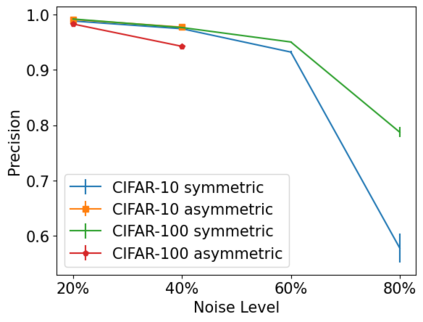

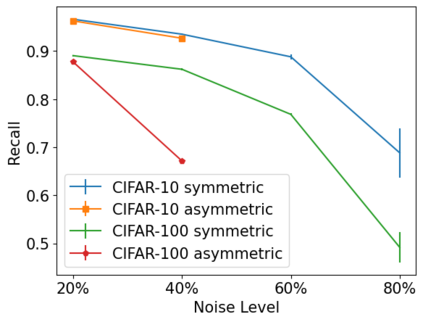

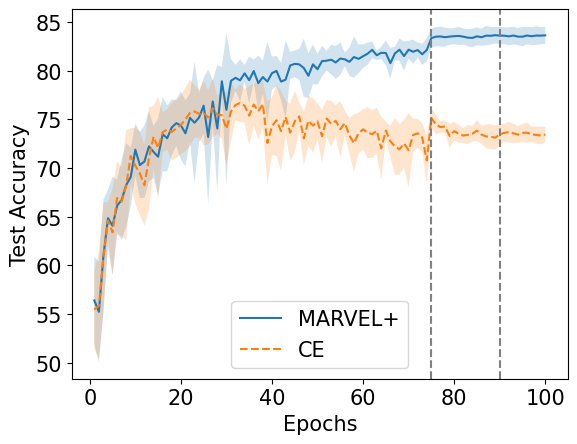

A deep neural network trained on noisy labels is known to quickly lose its power to discriminate clean instances from noisy ones. After the early learning phase has ended, the network memorizes the noisy instances, which leads to a significant degradation in its generalization performance. To resolve this issue, we propose MARVEL (MARgins Via Early Learning), a new robust learning method where the memorization of the noisy instances is curbed. We propose a new test statistic that tracks the goodness of "fit" of every instance based on the epoch-history of its classification margins. If its classification margin is small in a sequence of consecutive learning epochs, that instance is declared noisy and the network abandons learning on it. Consequently, the network first flags a possibly noisy instance, and then waits to see if learning on that instance can be improved and if not, the network learns with confidence that this instance can be safely abandoned. We also propose MARVEL+, where arduous instances can be upweighted, enabling the network to focus and improve its learning on them and consequently its generalization. Experimental results on benchmark datasets with synthetic label noise and real-world datasets show that MARVEL outperforms other baselines consistently across different noise levels, with a significantly larger margin under asymmetric noise.

翻译:在噪音标签上受过训练的深心神经网络已知会很快丧失其歧视噪音中清洁事件的权力。在早期学习阶段结束后,网络会回忆起吵闹事件,导致其一般性能严重退化。为了解决这个问题,我们提议MARVEL(MARGINS Via Aidnical Learning)(MARVEL)(MARVEL)(MARVEL)(MARVER)(MARVER)(MARVER))(MARVEL)(MARVEL)(NARVER) (N) +) (NARVER) (N) (MARVEL +) ), 跟踪每个案例的“适合”的好坏之处, 依据其分类边际的时代。如果其分类差在一系列连续学习的时代中很小, 其分类差值被宣布为吵闹杂音, 网络放弃学习。 因此, 网络首先标定了一个可能非常吵闹的场景点, 然后等待看这方面的学习是否能够改进, 如果无法安全放弃, 。 我们还建议MARVEL +,,,,,,, 将 将 将 将 以 以 新的 基 基 基 基 基 基 基 基 基 基 基 显示 基 基 比 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 在 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基 基