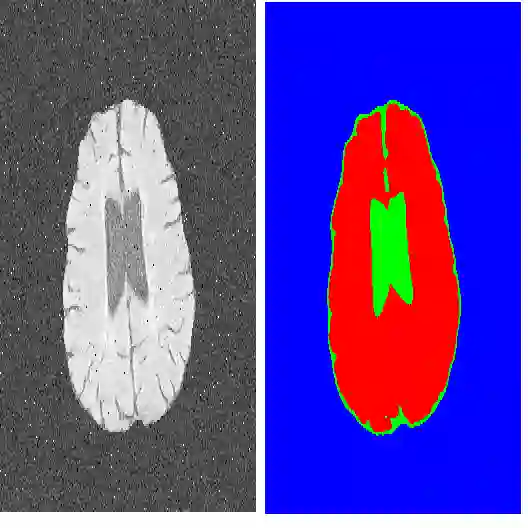

Segmentation is one of the primary tasks in the application of deep learning in medical imaging, owing to its multiple downstream clinical applications. As a result, many large-scale segmentation datasets have been curated and released for the segmentation of different anatomical structures. However, these datasets focus on the segmentation of a subset of anatomical structures in the body, therefore, training a model for each dataset would potentially result in hundreds of models and thus limit their clinical translational utility. Furthermore, many of these datasets share the same field of view but have different subsets of annotations, thus making individual dataset annotations incomplete. To that end, we developed SegViz, a federated learning framework for aggregating knowledge from distributed medical image segmentation datasets with different and incomplete annotations into a `global` meta-model. The SegViz framework was trained to build a single model capable of segmenting both liver and spleen aggregating knowledge from both these nodes by aggregating the weights after every 10 epochs. The global SegViz model was tested on an external dataset, Beyond the Cranial Vault (BTCV), comprising both liver and spleen annotations using the dice similarity (DS) metric. The baseline individual segmentation models for spleen and liver trained on their respective datasets produced a DS score of 0.834 and 0.878 on the BTCV test set. In comparison, the SegViz model produced comparable mean DS scores of 0.829 and 0.899 for the segmentation of the spleen and liver respectively. Our results demonstrate SegViz as an essential first step towards training clinically translatable multi-task segmentation models from distributed datasets with disjoint incomplete annotations with excellent performance.

翻译:由于医疗成像应用深度学习是医疗成像中的一项主要任务,这是由于它具有多个下游临床应用。因此,许多大型的分解数据集已经成熟并发布,用于对不同解剖结构进行分解,然而,这些数据集侧重于对机构内一组解剖结构进行分解,因此,为每个数据集培训一个模型可能会产生数百个模型,从而限制其临床翻译效用。此外,许多这些数据集都具有相同的视野领域,但有不同的说明组,从而使单个数据集说明不完整。为此,我们开发了一个SegViz,这是一个将分布式医学图解剖数据集中的不同和不完整说明集成知识的联邦学习框架,形成一个“全球”元模型。因此,SegViz框架将建立一个单一模型,能够将肝脏和脾脏的精密分解分解,将每10个节的重量加在一起,但有不同的说明组,从而使得单个数据集说明不完整。为此,我们开发了SegViz,一个将分布在分布式医学图解剖的分布式医学分解图解图解图解中的知识汇集成数据,用经过训练的SBral-Bral-DLevlationSlevalal Stal Stal Stalxlation 和Brevlevdealdealdal 。 和Bdalxxxxxxxx