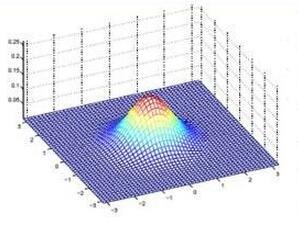

It is widely believed that a joint factor analysis of item responses and response time (RT) may yield more precise ability scores that are conventionally predicted from responses only. For this purpose, a simple-structure factor model is often preferred as it only requires specifying an additional measurement model for item-level RT while leaving the original item response theory (IRT) model for responses intact. The added speed factor indicated by item-level RT correlates with the ability factor in the IRT model, allowing RT data to carry additional information about respondents' ability. However, parametric simple-structure factor models are often restrictive and fit poorly to empirical data, which prompts under-confidence in the suitablity of a simple factor structure. In the present paper, we analyze the 2015 Programme for International Student Assessment (PISA) mathematics data using a semiparametric simple-structure model. We conclude that a simple factor structure attains a decent fit after further parametric assumptions in the measurement model are sufficiently relaxed. Furthermore, our semiparametric model implies that the association between latent ability and speed/slowness is strong in the population, but the form of association is nonlinear. It follows that scoring based on the fitted model can substantially improve the precision of ability scores.

翻译:一个半参数因子分析模型在题目回答和反应时间上有什么启示? 以2015年PISA数据为例

摘要:

因子分析模型在题目回答和反应时间合并后的联合分析中,能更加准确地预测传统上仅通过回答模型无法预测的能力得分。为此,常常使用一个简单的因子模型,只需要为题目反应时间增加一个测量模型,而不影响回答模型,所以被广泛使用。反应时间数据中的添加速度因子与回答模型中的能力因子相关,使得反应时间数据可以携带应试者能力的额外信息。然而,参数化的简单结构因子模型往往限制严格,且不能够很好地拟合实际数据,这促使作者对简单因子结构的适用性缺乏信心。在本文中,我们使用了一个半参数的简单结构模型来分析2015年国际学生评估计划(PISA)的数学数据。我们得出结论,在满足测量模型参数化假设条件宽松的情况下,简单因子结构可以较好的拟合数据。此外,半参数模型暗示,潜在能力与速度/迟缓之间的联系在人口中很强,但联系的形式是非线性的。随之而来的是,基于拟合模型的评分可以显著地提高能力得分的精度。