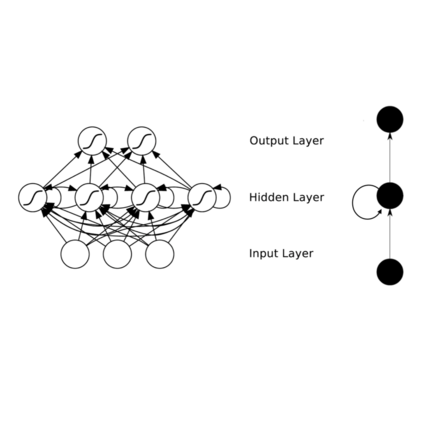

Recurrent Neural Networks (RNNs) are frequently used to model aspects of brain function and structure. In this work, we trained small fully-connected RNNs to perform temporal and flow control tasks with time-varying stimuli. Our results show that different RNNs can solve the same task by converging to different underlying dynamics and that the performance gracefully degrades either as network size is decreased, interval duration is increased, or connectivity is damaged. Our results are useful to quantify different aspects of the models, which are normally used as black boxes and need to be understood in advance to modeling the biological response of cerebral cortex areas.

翻译:经常性神经网络(NealNetworks)经常被用来模拟大脑功能和结构的方方面面。在这项工作中,我们训练了小型完全连接的网络性网络性能和结构,以便用时间变化的刺激性刺激执行时间和流量控制任务。我们的结果表明,不同的网络性能可以通过与不同基本动态相融合来解决同样的任务,而且随着网络规模的缩小、间隔时间的延长或连接的破坏,性能会优于优减。我们的结果有助于量化模型的不同方面,这些方面通常被用作黑盒,需要事先理解才能模拟大脑皮层地区的生物反应。