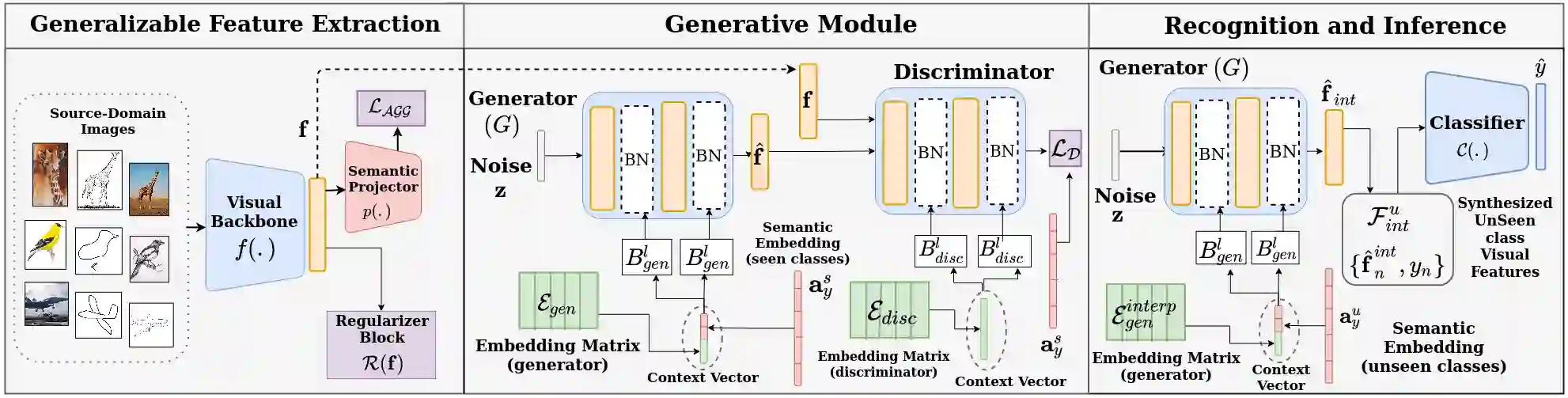

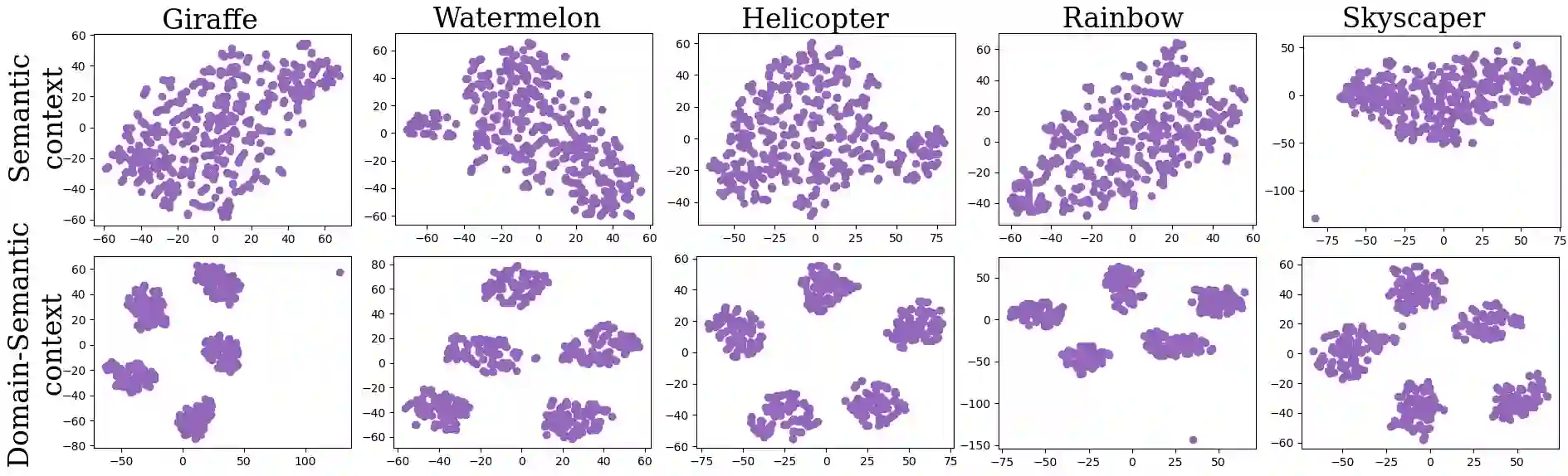

Recent progress towards designing models that can generalize to unseen domains (i.e domain generalization) or unseen classes (i.e zero-shot learning) has embarked interest towards building models that can tackle both domain-shift and semantic shift simultaneously (i.e zero-shot domain generalization). For models to generalize to unseen classes in unseen domains, it is crucial to learn feature representation that preserves class-level (domain-invariant) as well as domain-specific information. Motivated from the success of generative zero-shot approaches, we propose a feature generative framework integrated with a COntext COnditional Adaptive (COCOA) Batch-Normalization to seamlessly integrate class-level semantic and domain-specific information. The generated visual features better capture the underlying data distribution enabling us to generalize to unseen classes and domains at test-time. We thoroughly evaluate and analyse our approach on established large-scale benchmark - DomainNet and demonstrate promising performance over baselines and state-of-art methods.

翻译:最近在设计可推广到隐蔽领域(即域通用)或隐蔽类别(即零光学习)的模式方面取得的进展,使人们开始有兴趣建立既能同时处理域转移又能同时处理语义转变的模式(即零光域通用)。对于将模型推广到隐蔽领域(即零光域通用)的隐蔽类的模式来说,关键是要学习保护阶级一级(域内差异)和特定领域信息的特征代表方式。我们从基因化零光学方法的成功出发,提出了一个与COntext Conditional Redition(COCOA)批次-诺热化相结合的特征框架,以便无缝地整合阶级一级的语义和域专用信息。所产生的视觉特征更好地捕捉基本数据分配方式,使我们能够在测试时将隐蔽类和域普遍化。我们透彻地评估并分析我们对既定大型基准-DomainNet(DominNet)的方法,并展示在基线和状态方法方面有希望的业绩。