主题: Transferring NLP models across languages and domains

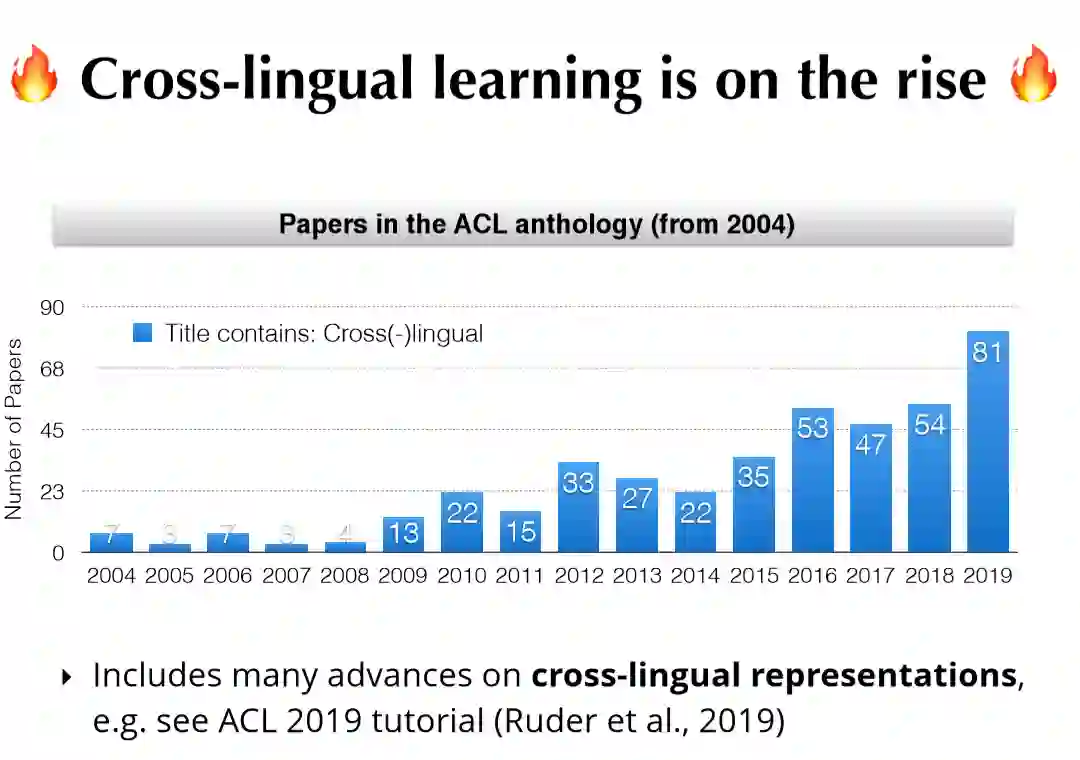

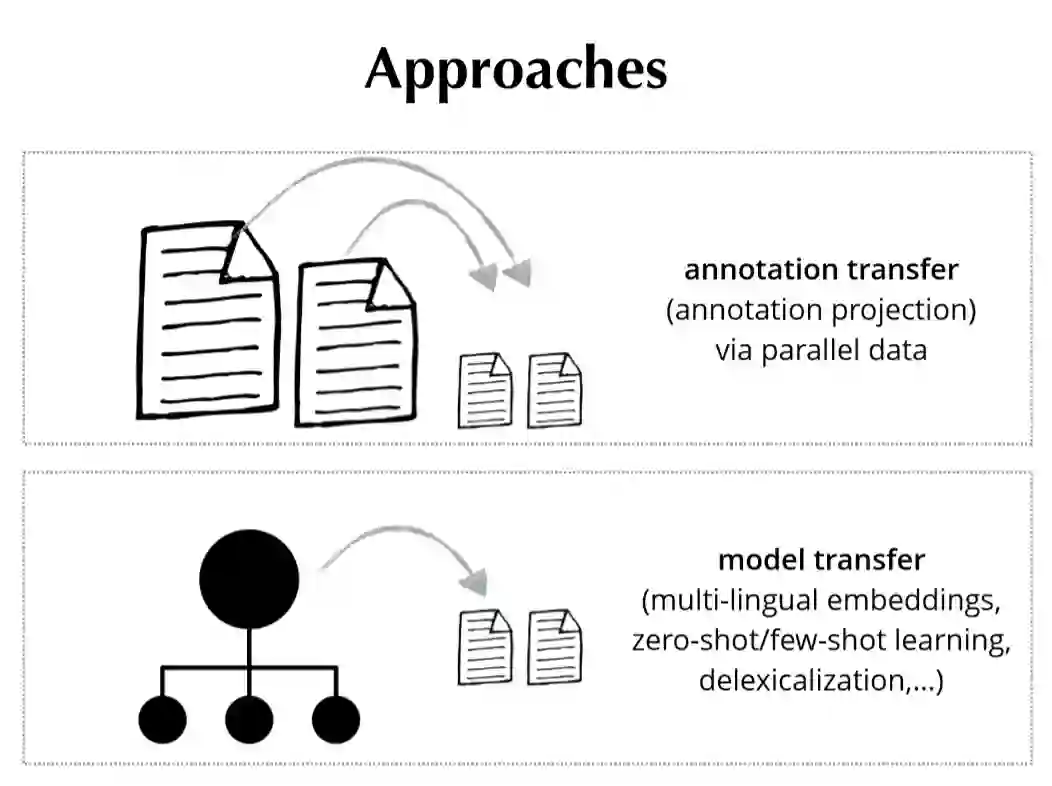

摘要: 在过去一年多的时间里,以预训练模型形式进行的迁移学习已经成为NLP领域的主流,许多任务的基准都因而得到极大地提升。在当前的自然语言处理领域中,也同样普遍存在着不同类型的迁移学习。这大致可以从三个维度进行分类:a)源设置和目标设置是否处理相同的任务;b)源域和目标域是否有相同的属性;c)task学习顺序是否相同。报告者从跨语言和跨领域两方面来讲述NLP模型迁移。

下载链接: https://syntaxfest.github.io/syntaxfest19/slides/invited_talk_syntaxfest_plank.pdf

成为VIP会员查看完整内容

相关内容

迁移学习(Transfer Learning)是一种机器学习方法,是把一个领域(即源领域)的知识,迁移到另外一个领域(即目标领域),使得目标领域能够取得更好的学习效果。迁移学习(TL)是机器学习(ML)中的一个研究问题,着重于存储在解决一个问题时获得的知识并将其应用于另一个但相关的问题。例如,在学习识别汽车时获得的知识可以在尝试识别卡车时应用。尽管这两个领域之间的正式联系是有限的,但这一领域的研究与心理学文献关于学习转移的悠久历史有关。从实践的角度来看,为学习新任务而重用或转移先前学习的任务中的信息可能会显着提高强化学习代理的样本效率。

专知会员服务

140+阅读 · 2020年7月10日

专知会员服务

27+阅读 · 2020年4月5日

专知会员服务

54+阅读 · 2020年1月30日

Arxiv

4+阅读 · 2018年6月12日

Arxiv

6+阅读 · 2018年6月7日