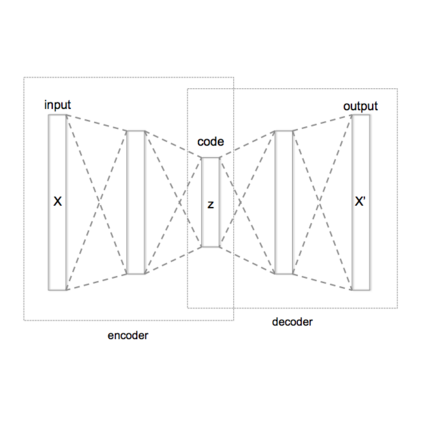

In applied fields where the speed of inference and model flexibility are crucial, the use of Bayesian inference for models with a stochastic process as their prior, e.g. Gaussian processes (GPs) is ubiquitous. Recent literature has demonstrated that the computational bottleneck caused by GP priors or their finite realizations can be encoded using deep generative models such as variational autoencoders (VAEs), and the learned generators can then be used instead of the original priors during Markov chain Monte Carlo (MCMC) inference in a drop-in manner. While this approach enables fast and highly efficient inference, it loses information about the stochastic process hyperparameters, and, as a consequence, makes inference over hyperparameters impossible and the learned priors indistinct. We propose to resolve this issue and disentangle the learned priors by conditioning the VAE on stochastic process hyperparameters. This way, the hyperparameters are encoded alongside GP realisations and can be explicitly estimated at the inference stage. We believe that the new method, termed PriorCVAE, will be a useful tool among approximate inference approaches and has the potential to have a large impact on spatial and spatiotemporal inference in crucial real-life applications. Code showcasing PriorCVAE can be found on GitHub: https://github.com/elizavetasemenova/PriorCVAE

翻译:在应用领域中,贝叶斯推断被广泛应用于具有随机过程作为先验的模型,例如高斯过程(GPs)。最近的文献表明,由于GP先验或其有限的实现所造成的计算瓶颈可以用深度生成模型(如变分自编码器(VAEs))来编码,然后在马尔科夫链蒙特卡罗(MCMC)推断中使用所学到的生成器以代替原始先验。虽然这种方法实现了快速和高效的推断,但它丢失了关于随机过程超参数的信息,因此使得关于超参数的推断不可能,学习到的先验不明显。本文提出了一种方法来解决这个问题,通过将VAE与随机过程超参数作为条件,使超参数与GP实现编码在一起,从而可以在推断阶段显式地估计超参数。我们相信这种新方法称为PriorCVAE,将成为近似推断方法中实用的工具,并有可能在关键的实际应用中对空间和时空推断产生重大影响。展示PriorCVAE的代码可以在GitHub上找到:https://github.com/elizavetasemenova/PriorCVAE