神经结构搜索

·

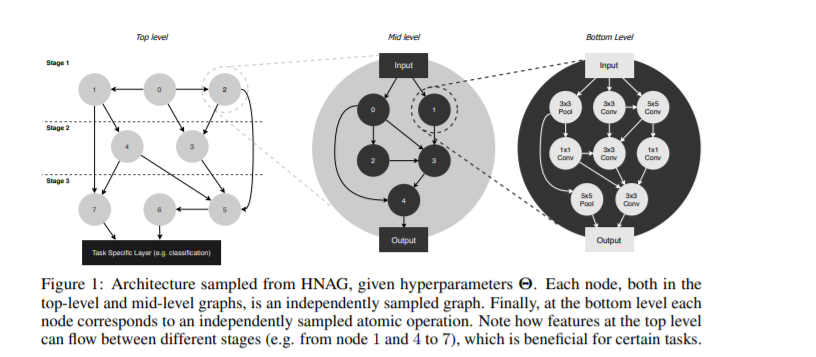

神经结构搜索(NAS)旨在以全自动的方式找到表现出色且新颖的神经网络结构。然而现有的搜索空间设计过度依赖于研究者的专业知识,所涵盖的神经网络相对比较单一,导致搜索策略虽然能找到表现不错的结构,却无法发现突破性的新型神经网络。在这篇工作中,我们 1)首次提出了搜索最优的神经网络结构生成分布(architecturegenerator)而不仅仅是单个神经网络(single architecture) 的概念,2)并针对这个概念提出了一个全新的,多阶层的,基于图的搜索空间。该搜索空间不但能生成非常多样化的网络结构,而且只由几个超参来定义。这极大减少了结构搜索的维度,使得我们能高效地使用贝叶斯优化作为搜索策略。与此同时,因为我们拓广了搜索空间(包含众多性能和存储需求差异巨大的有效网络结构),这使得多目标学习在我们的场景下更有意义。我们在六个图像数据集上验证了我们方法(NAGO)的高效性, 并展示了我们的方法能找到非常轻便且性能卓越的网络结构。

https://www.zhuanzhi.ai/paper/32eaa4b0ef54865420bd74ec5d831f7c

成为VIP会员查看完整内容

相关内容

专知会员服务

34+阅读 · 2020年6月19日