【泡泡一分钟】高动态环境的语义单目SLAM

每天一分钟,带你读遍机器人顶级会议文章

标题:Semantic Monocular SLAM for Highly Dynamic Environments

作者:Nikolas Brasch , Aljaz Bozic , Joe Lallemand , Federico Tombari

来源:2018 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS)

编译:张宁

审核:陈世浪,颜青松

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

单目SLAM的最新进展已经实现了具有实时能力的系统,该系统在静态环境的假设下运行稳健,但在动态场景变化和运动的情况下失败,因为它们缺乏明确的动态异常值处理。

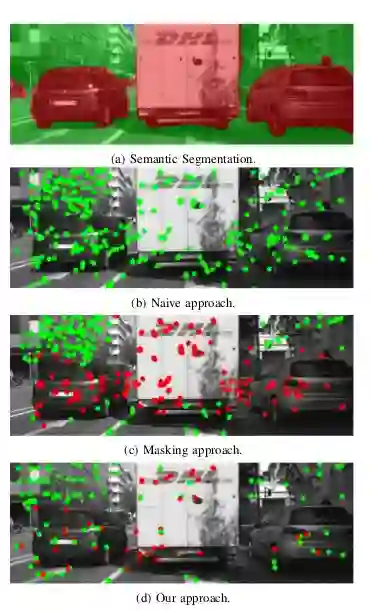

图1 来自CityScapes数据集的示例,该数据集是一个困难且高度动态的场景,其中车辆站在交通灯前。

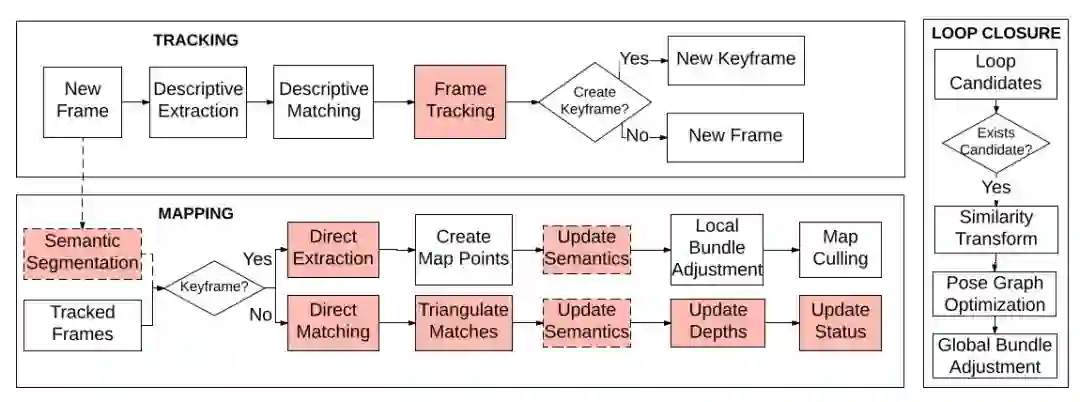

我们提出了一种语义单目SLAM框架,旨在处理高度动态的环境,结合基于特征的方法和直接方法,以在具有挑战性的条件下实现稳健性。所提出的方法利用在显式概率模型内从场景提取的语义信息,这最大化了跟踪和建图两者依赖于相对于相机不呈现相对运动的那些场景部分的概率。

图2 我们的动态SLAM框架概述。

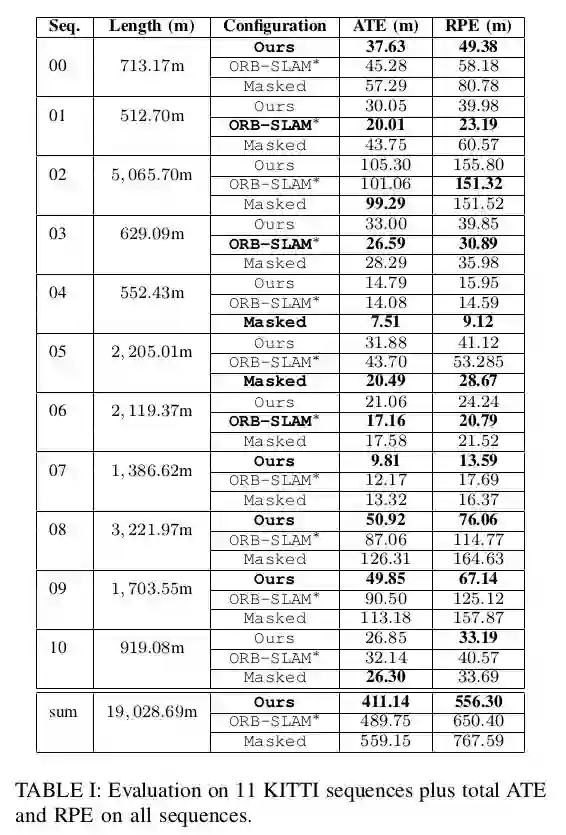

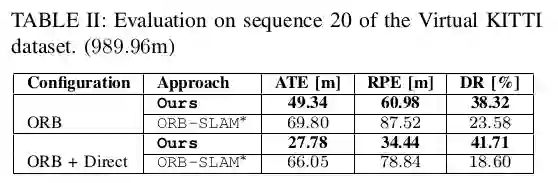

我们在动态环境中显示更稳定的姿态估计,并且在Virtual KITTI和Synthia数据集上的静态序列上具有与现有技术相当的性能。

Abstract

Recent advances in monocular SLAM have en-abled real-time capable systems which run robustly under the assumption of a static environment, but fail in presence of dynamic scene changes and motion, since they lack an explicit dynamic outlier handling. We propose a semantic monocular SLAM framework designed to deal with highly dynamic en-vironments, combining feature-based and direct approaches to achieve robustness under challenging conditions. The proposed approach exploits semantic information extracted from the scene within an explicit probabilistic model, which maximizes the probability for both tracking and mapping to rely on those scene parts that do not present a relative motion with respect to the camera. We show more stable pose estimation in dynamic environments and comparable performance to the state of the art on static sequences on the Virtual KITTI and Synthia datasets.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com