【泡泡图灵智库】面向无人机的高效双目SLAM

泡泡图灵智库,带你精读机器人顶级会议文章

标题:SOFT-SLAM: Computationally efficient stereo visual simultaneous localization and mapping for autonomous unmaned aerial vehicles

作者:Igor Cvišić, Josip Ćesić, Ivan Marković, and Ivan Petrović

来源:Journal of Field Robotics (JFR2017)

播音员:

编译:凌勇

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——SOFT-SLAM: Computationally efficient stereo visual simultaneous localization and mapping for autonomous unmaned aerial vehicles,该文章发表于JFR 2017。

在无GPS区域的无人机自主导航是一个具有挑战性的问题,特别是受限于电池容量和计算能力。解决的办法是通过视觉SLAM,因为相机具有多种优点。本文中我们面向无人机提出了一个双目SLAM算法,可以生成准确的定位以及稠密的地图。我们的方法包含一个新的双目视觉里程计算法,目前排名KITTI双目算法第一。并且我们还在Euroc数据集上与ORB-SLAM2和LSD-SLAM进行了比较,证明了我们方法的性能。

主要贡献

1.本文提出了使用SOFTVO代替计算更复杂的BA,并且还能得到较高的精度。

2.本文提出的SLAM系统支持大规模场景的回环,并且还能够保持对于同样的数据得到同样的输出(ORB-SLAM2不能)。

3.本文使用SOFT中的特征实现了回环检测,即使是我们的特征不具有旋转和尺度的不变性,但也能获得足够多的回环检测结果。

4.本文同时在Euroc和Kitti数据集上进行了评估,均达到sota的性能。

算法流程

一、系统概述

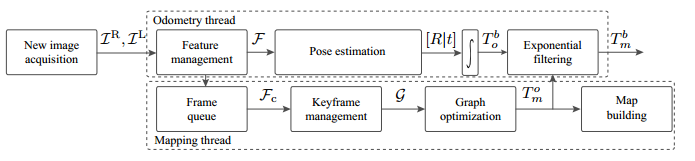

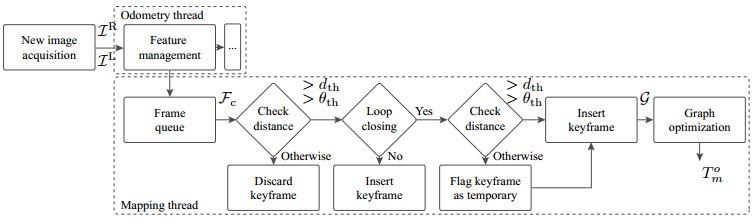

图1 本文系统架构

整个系统分为VO线程和建图的线程,VO的实时性是保证无人机局部控制的关键,而建图线程则是为了保持全局的一致性,最后它们会使用一个滤波器连接器二者的输出。

VO线程会在获得图像后,计算梯度并且基于NMS提取角点,然后使用IMU的输出预测在特征匹配过程中需要的搜索半径,然后特征会在搜索半径中使用加权后的patch SAD进行匹配(权重为与预测坐标的距离)。接下来会使用RANSAC方法进行位姿估计,在有陀螺仪输出的情况下,使用1-point RANSAC,否则使用3-point RANSAC (使用的点越少计算速度越快)。对于Kitti的数据,我们只是用左视图进行计算,因此使用了5-point RANSAC。得到RANSAC的inlier之后,我们使用一个G-N算法得到最终的相对旋转和位移。相对的运动不断被积分然后输出。

建图线程从特征管理器中取得数据,放入到队列中,然后根据距离上一个关键帧的距离决定是创建关键帧还是不创建关键帧。这里我们会去检测回环,然后在稀疏的位姿图上运行g2o(不包含特征点)来去除漂移。

二、VO线程

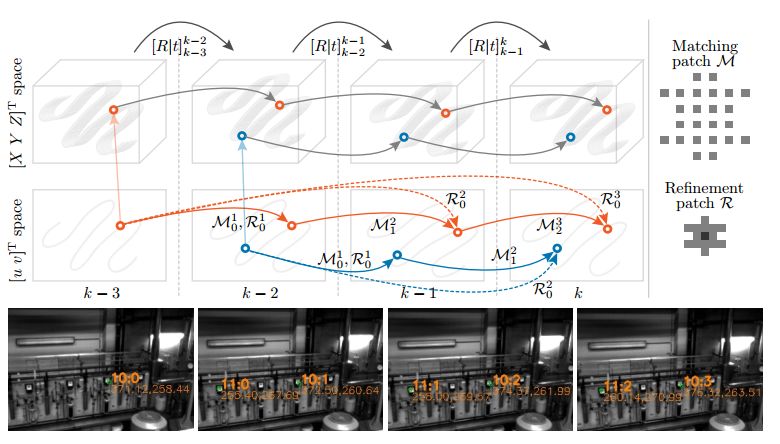

在特征匹配的过程中,由于SSD容易带来outlier,所以我们使用了circular match的技术,特征需要按照L_k, R_k, R_k+1, L_k+1, L_k的顺序进行匹配,如果有IMU使用IMU预测,没有靠匀速模型预测。按照顺序匹配下来的最终特征应该跟初始位置相差无几,相差过大就拒绝。然后我们再使用NCC重复计算一遍匹配的patch,对于过低的NCC得分的匹配进行剔除。

图2 circle match的示意图

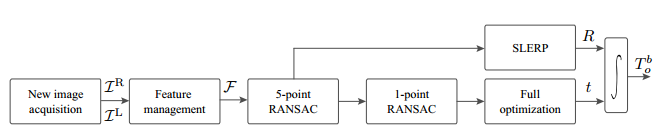

如果我们不包含IMU的测量数据,那么位姿估计的Pipeline如下所示,首先使用5点法计算初始的R, t,然后再使用重投影误差优化t

图3 没有IMU辅助的位姿估计pipeline

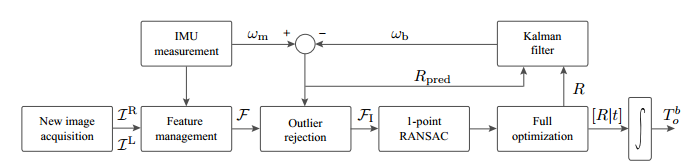

如果包含了IMU测量的数据,那么pipeline如下,不同的是这里使用IMU的gyro输出预测旋转并且使用一个KF对gyro的ibias进行修正。

图4 存在IMU辅助的位姿估计pipeiline

三、建图线程

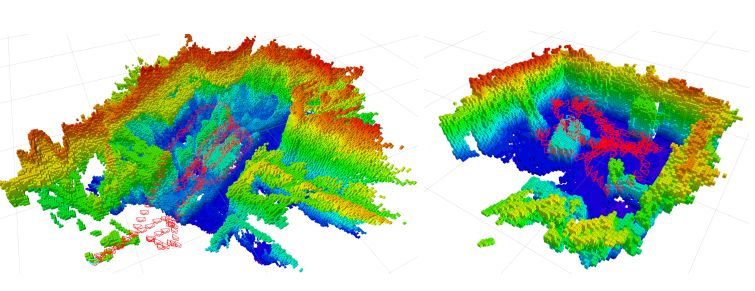

建图线程构建的稠密地图如下所示:

首先任何一个新进入建图线程队列的frame会检查位移和旋转是否大于阈值,如果否则丢弃当前帧取下一帧,再检查是否存在回环,如果没有则加入一个新的关键帧。

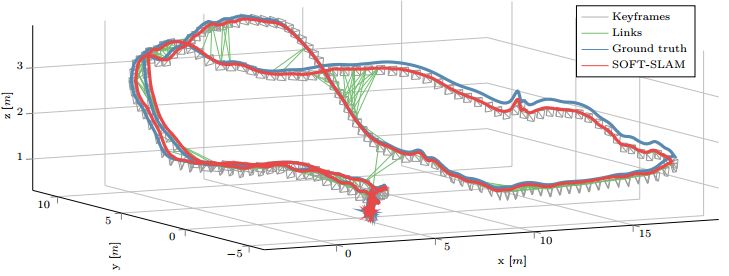

在SOFT-SLAM中的关键帧连接图如下面的图所示。我们的回环检测会在keyframe的图中搜索一个固定的半径和角度作为候选帧,得到候选帧之后,我们比较它们的特征直方图,在不同直方图之间用SAD进行相似度评分,然后我们取n个最近的作为候选者,其余丢掉,再接着使用我们的circular match技术和NCC匹配,然后使用3点法去除outlier,如果包含了足够的inlier,那就利用重投影误差进行G-N优化。最后我们在得到的pose graph上使用L-M进行优化。

主要结果

1、数据集

基于Euroc与Kitti的数据进行了测试,其中kitti是室外的车辆数据集不使用IMU辅助,而Euroc使用了IMU的测量。

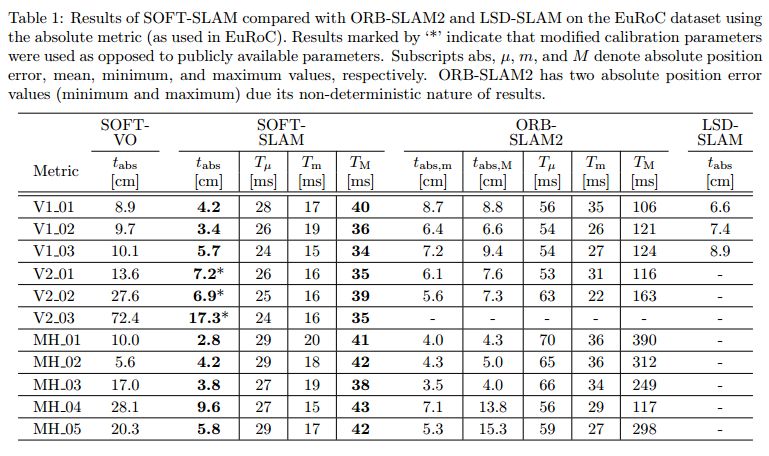

表1 Euroc上的定量结果

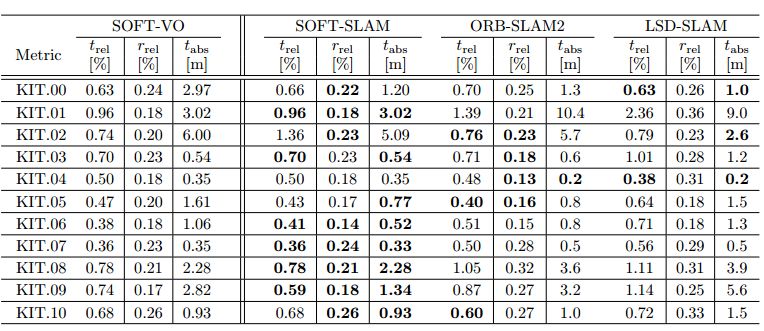

表2 Kitti上的定量结果

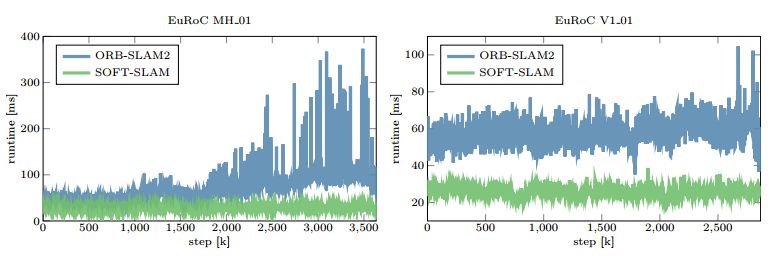

2、处理速度

我们的方法可以稳定的输出位姿,这对于无人机的应用而言十分关键。

图5 每帧处理时间的比较

Abstract

Autonomous navigation of unmanned aerial vehicles (UAVs) in GPS-denied environments is a challenging problem, especially for small-scale UAVs characterized by small payload and limited battery autonomy. The solution to the aforementioned problem is vision-based simultaneous localization and mapping (SLAM), since cameras, due to their dimensions, low weight, availability, and large information bandwidth, fulfill all the constraints of UAVs. In this paper we propose a stereo vision SLAM yielding very accurate localization and a dense map of the environment developed with the aim to compete in the European Robotics Challenges (EuRoC) targeting airborne inspection of industrial facilities with small-scale UAVs. The proposed approach consists of a novel stereo odometry with feature tracking (SOFT) currently ranking first among all the stereo methods on the KITTI dataset. Relying on SOFT for pose estimation, we build a feature-based pose graph SLAM solution, which we dub SOFT- SLAM. SOFT-SLAM has a completely separated odometry and mapping thread with large loop- closing and global consistency and achieves a constant-time execution rate of 20 Hz with deterministic results using only two threads of an onboard computer used in the challenge. The UAV running our SLAM algorithm obtained the highest localization score in the EuRoC Challenge 3, Stage IIa–Benchmarking, Task 2. Furthermore, we also present an exhaustive evaluation of SOFT-SLAM on two popular public datasets and compare it to other state-of-the- art approaches ; namely, ORB-SLAM2 and LSD- SLAM. The results show that SOFT-SLAM obtains better localization accuracy on the majority of the datasets sequences, while also having lower runtime.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。提取码:kn1p

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com