【泡泡图灵智库】Trifo-VIO:使用点线的鲁棒且高效的双目VIO(ECCV)

泡泡图灵智库,带你精读机器人顶级会议文章

标题:Trifo-VIO: Robust and Efficient Stereo Visual Inertial Odometry using Points and Lines

作者:Feng Zheng, Grace Tsai, Zhe Zhang, Shaoshan Liu, Chen-Chi Chu, and Hongbing Hu

来源:ECCV 2018

编译:曾攀

审核:王禹

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——Trifo-VIO:使用点线的鲁棒且高效的双目VIO,该文章发表于ECCV 2018。

本文介绍了Trifo Visual Inertial Odometry(Trifo-VIO),这是一种使用点和线的紧耦合滤波的双目VIO系统。当无法可靠地检测或跟踪点特征时,线特征有助于在挑战性场景中提高系统的鲁棒性,例如,低纹理环境或照明变化。此外,我们还提出一种新颖的轻量级的基于滤波的回环技术,可以在不进行全局束调整或位姿图优化的情况下减少累积漂移。在EKF更新时制定闭环,以便将滤波器维护的当前滑动窗口最佳地重定位到过去的关键帧。我们还介绍了一个新的视觉惯性数据集:Trifo Ironsides 数据集,具有高质量的同步立体相机和来自Ironside传感器的IMU数据,含不同的运动类型和纹理,以及毫米精度的地面真值。为了验证所提出系统的性能,我们使用了公开的EuRoC数据集和Trifo Ironsides数据集将提出的系统与最先进的方法(OKVIS、VINS-MONO和S-MSCKF)进行了广泛的比较。

主要贡献

1 提出的Trifo-VIO是第一个紧耦合滤波的基于双目的同时使用点线特征的VIO。

2 提出一种新颖的在EKF更新时的轻量级基于滤波的回环方法。

3 发布了Trifo Ironsides数据集,具有高质量的同步立体相机和来自Ironside传感器的IMU数据,含不同的运动类型和纹理,以及毫米精度的地面真值。

数据集可从以下网址获取:https://github.com/TrifoRobotics/IRONSIDES/wiki/Dataset.

算法流程

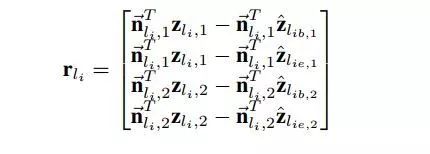

1,描述估计器

我们的估计器的主干是MSCKF,其主要思想是使用特征跟踪观测来维护和更新滑动窗口中的相机姿态,而不包括滤波器状态中的特征。

介绍两种类型的EKF更新:(1)基于联合点特征和线特征的更新,以应对具有挑战性的场景并增强鲁棒性;(2)回环更新以减少累积漂移。

A.状态参数化

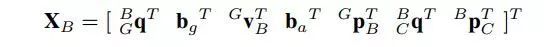

定义IMU状态如下:

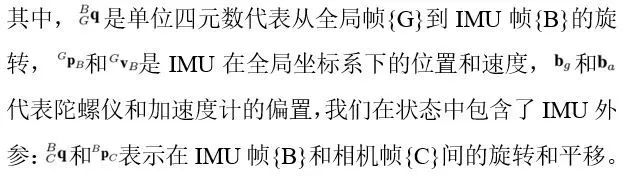

k时刻,我们估计器的完整状态包括当前IMU状态估计和N个相机位姿:

B.EKF迭代

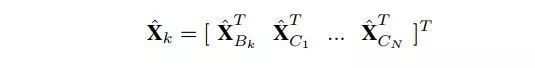

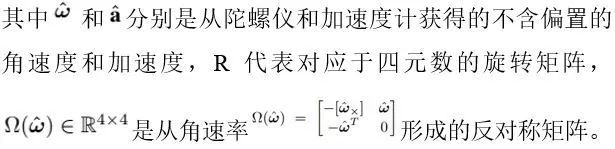

标准的连续时间的IMU运动模型如下:

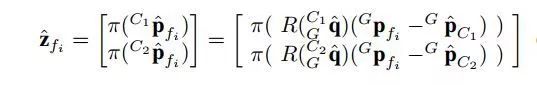

C.对于点特征的测量模型

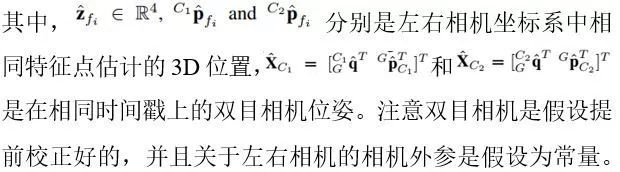

D.对于线特征的测量模型

2,图像处理

对于每一幅新图像,通过KLT光流(OF)跟踪现有的点特征,对于非跟踪图像区域,通过FAST征检测器检测新的特征。此外通过空间二值化来实现图像中特征的均匀分布,并在每个分区中保持一定数量的高响应特征。为了适应快速运动,利用陀螺仪测量的相对旋转得到了光流的初始猜测。为消除立体匹配和时间匹配中的孤立点(异常值),使用了两点RANSAC和空时循环匹配。

对于线特征,使用线段检测器(LSD)来提取线段。对于检测到的每个线段,使用线带描述符(LBD)提取二进制描述符。为了确保最佳匹配,我们执行4路一致性检查,即从左到右,从右到左,过去到现在,以及现在到过去。此外还通过检查线的长度和方向来修剪假定的匹配。

为进一步增强特征跟踪和匹配的鲁棒性,根据平均亮度在立体和时间连续图像之间引入快速亮度检查,并执行直方图匹配,以确保在必要时在立体和时间图像上保持一致的亮度和对比度。

3,回环检测

对于每个新图像,根据跟踪的特征数量和回环检测数据库中现有关键帧的位姿距离进行关键帧选择。若选择了关键帧,则提取ORB描述符进行循环检测。我们的回环检测是基于BoW2实现的,并且在与主VIO线程的并行线程中运行。对于候选回环,我们在RANSAC框架内执行两步异常值剔除:2D-2D基本矩阵测试和3D-2D PnP测试。如果正常值特征匹配的数量高于预定义的阈值,我们标记检测到的回环并触发回环关闭EKF更新。如果当前关键帧不包含回环,则当它从滤波器维护的活动滑动窗口中边缘化时,我们将其添加到数据库中,并将其与特征的姿态、2D和3D位置以及它们的描述符一起添加到数据库中。考虑到内存要求和检测速度,在数据库中设置了最大关键帧数,以确保它在一个相机帧内返回结果。

主要结果

用两个实验证明提出系统的性能,两个实验都与OKVIS、VINS-MONO、S-MSCKF进行了对比。第一个实验在公开的EuRoC MAV数据集上进行。第二个实验用新的Trifo Ironsides数据集。

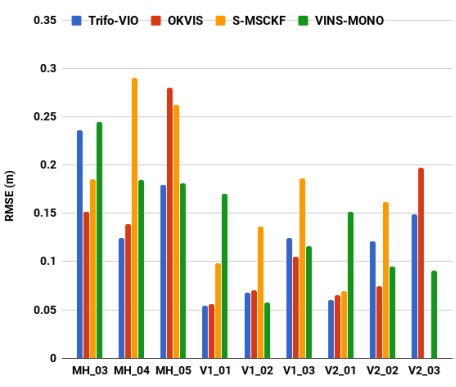

<实验1:EuRoC数据集>

图1展示了评估结果,结果表明在MH04, MH05, V101和V201中Trifo-VIO是表现最好的方法。

图1 Euroc数据集结果

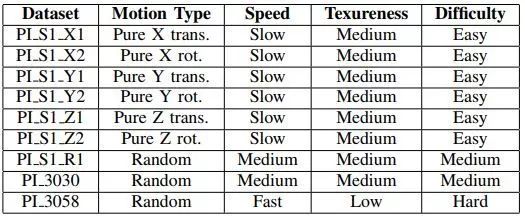

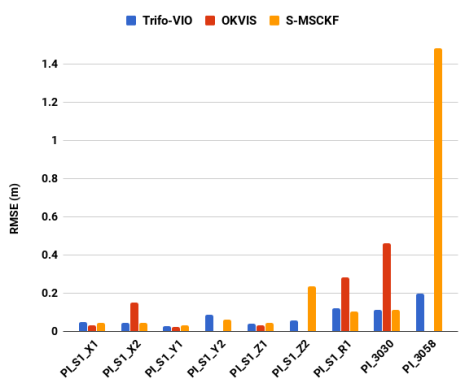

<实验2:Trifo Ironsides数据集>

Trifo Ironsides数据集如下表所示:

图2展示了比较结果。对于所有的方法均调整了参数使其尽可能表现最好。我们的Trifo-VIO 始终是表现最好方法的前两名。S-MSCKF的结果和我们的结果很接近,除了PI 3058,在这个数据集中,由于额外使用了线特征,我们的结果表现得更好。

图2 Trifo Ironsides数据集

Abstract

In this paper, we present the Trifo Visual Inertial Odometry (Trifo-VIO), a tightly-coupled filtering-based stereo VIO system using both points and lines. Line features help improve system robustness in challenging scenarios when point features cannot be reliably detected or tracked, e.g. low-texture environment or lighting change. In addition, we propose a novel lightweight filtering-based loop closing technique to reduce accumulated drift without global bundle adjustment or pose graph optimization. We formulate loop closure as EKF updates to optimally relocate the current sliding window maintained by the filter to past keyframes. We also present the Trifo Ironsides dataset, a new visual-inertial dataset, featuring high-quality synchronized stereo camera and IMU data from the Ironsides sensor with various motion types and textures and

millimeter-accuracy groundtruth. To validate the performance of the proposed system, we conduct extensive comparison with state-of-the-art approaches (OKVIS, VINS-MONO and S-MSCKF) using both the public EuRoC dataset and the Trifo Ironsides dataset.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com