ECCV 2020 | 微软&北大提出Point-set Anchor:统一目标检测,实例分割,以及人体姿态估计

点击上方“CVer”,选择加"星标"置顶

重磅干货,第一时间送达

本文作者:FY.Wei

https://zhuanlan.zhihu.com/p/158054890

本文已由原作者授权,不得擅自二次转载

题目:Point-Set Anchors for Object Detection, Instance Segmentation and Pose Estimation

链接:https://arxiv.org/abs/2007.02846

其他:To appear in ECCV 2020, MSRA/北京大学

广告:MSRA 长期招聘computer vision intern,欢迎简历骚扰:fawe@microsoft.com

我们今年的工作提出了point-set anchor,并尝试了使用regression的思路去统一Object Detection, Instance Segmentation,Pose Estimation三个high-level recognition tasks。

众所周知,在object detection领域,无论是anchor based或者anchor-free based的方法中,其实都是事先定义了物体(bonding box 为GT的表示)的表示形式。anchor based的方法中,如RetinaNet,Faster-RCNN等,是用若干个anchor来表示正样本(IOU大于一定阈值),而anchor-free based的方法中,如CenterNet,FCOS,是用物体的中心点来表示正样本(feature map 的每个点映射回原图落在GT bounding box之中)。不论是anchor based或者anchor-free based的方法,对于正样本在原图的定位,都是基于regression的形式直接回归矩形坐标或者矩形长宽+矩形中心点offset。Anchor从某种程度上来说,表示的只是一种先验信息,anchor可以是中心点,也可以是矩形,同时它还可以提供更多的模型设计思路,如正负样本的分配,分类、回归特征的选择。那么我们的思路是,能不能提出更加general的anchor,泛化的应用于更多的任务中,而不只是Object detection中。

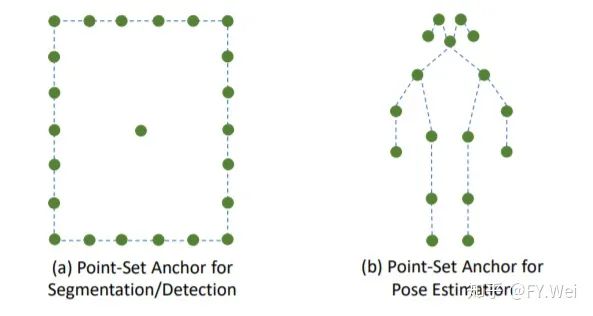

基于这个思路,我们提出了Point-set anchor,是anchor的泛化形式,我们尝试使用提出的point-set anchor,以regression的形式去解决Object Detection, Instance Segmentation,Pose Estimation,其形式如下:

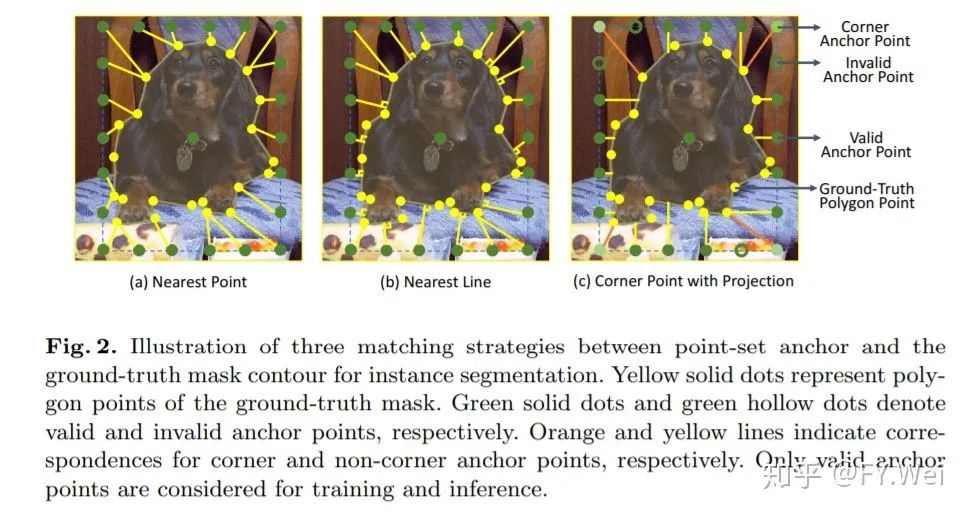

对于Instance Segmentation和Object Detection,使用Figure.1a的Anchor。Object Detection的回归任务比较简单,用中心点或者左上/右下角点回归即可。对于Instance Segmentation来说,我们使用了特定的匹配准则去匹配Point-set anchor中的anchor point和instance GT的polygen point,并且转换为回归任务(详情见paper):

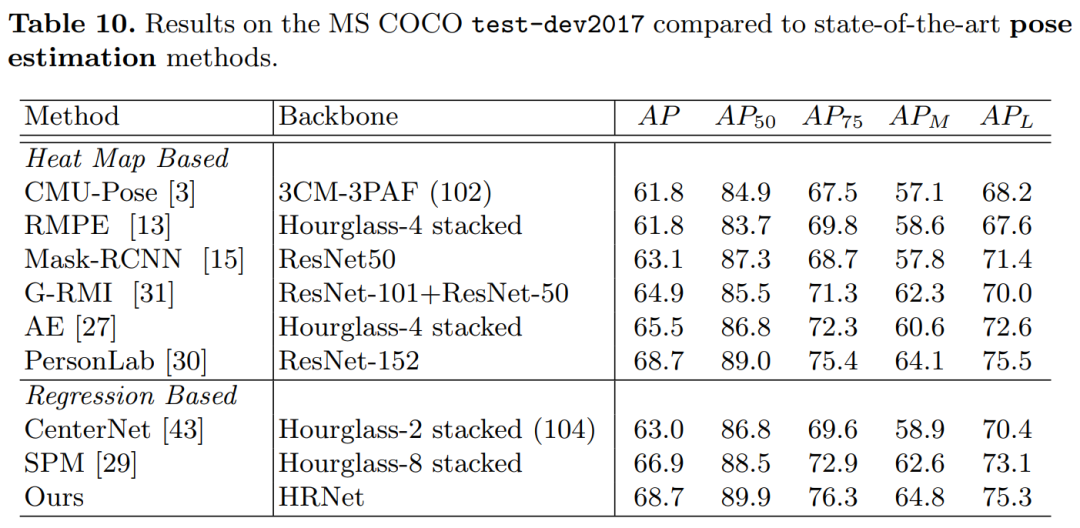

对于Pose Estimation来说,使用Figure.1b的Anchor。传统的bottom-up pose estimation方法大都是使用了heatmap-> grouping的思路。我们利用Point-set anchor直接将pose estimation转换为一个regression的task。即利用point-set anchor中的point直接回归对应的GT中的pose point。

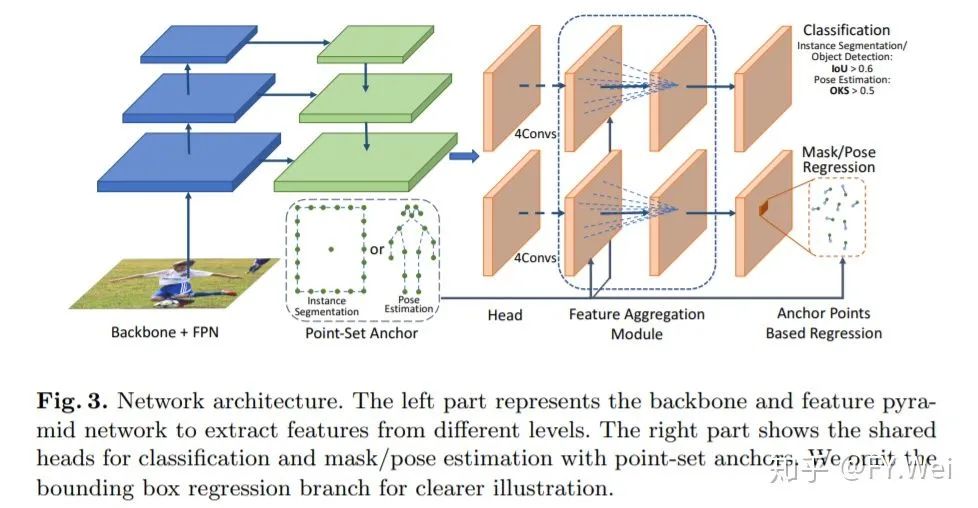

我们的网络设计也很简洁,没有复杂的设计,直接将Point-set Anchor使用在RetinaNet上,直接注意的是,对于pose estimation task,我们额外使用了一个feature aggregation模块,这个模块的作用在于利用我们提出的Point-set anchor的先验信息,使用DCN来aggregate特定的feature,然后提供更好的feature用于分类回归,而不是简单的单点center feature。

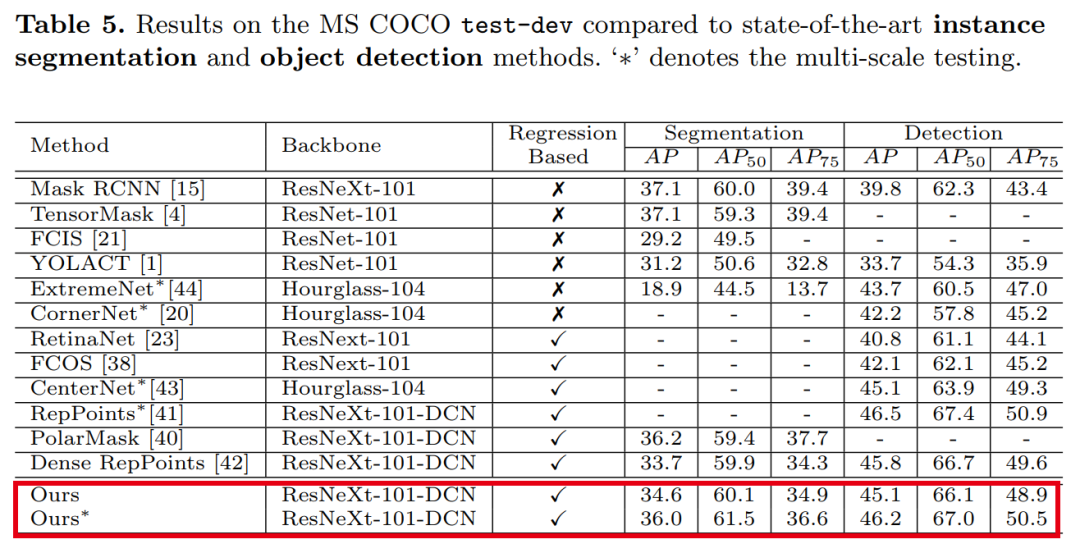

最后对于三个task的性能,我们都是基于RetinaNet来做的,没有额外的设计,在pose estimation上取得了不错的性能,在object detection和instance segmentation也做的比较work(单纯的基于RetinaNet,并且以regression的思路去做)。据我们所知,这也是第一个框架尝试统一Object Detection, Instance Segmentation以及Pose Estimation三大任务。

下载

在CVer公众号后台回复:Point-set ,即可下载本论文

重磅!CVer-论文写作与投稿交流群成立

扫码添加CVer助手,可申请加入CVer-论文写作与投稿 微信交流群,目前已满2000+人,旨在交流顶会(CVPR/ICCV/ECCV/ICML/ICLR/AAAI等)、顶刊(IJCV/TPAMI等)、SCI、EI等写作与投稿事宜。

同时也可申请加入CVer大群和细分方向技术群,细分方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch和TensorFlow等群。

一定要备注:研究方向+地点+学校/公司+昵称(如论文写作+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲长按加微信群

▲长按关注CVer公众号

整理不易,请给CVer点赞和在看!