【泡泡一分钟】PIRVS:一个具有灵活传感器融合和硬件协同设计的先进视觉-惯性SLAM系统

每天一分钟,带你读遍机器人顶级会议文章

标题:PIRVS: An Advanced Visual-Inertial SLAM System with Flexible Sensor Fusion and Hardware Co-Design

作者:Zhe Zhang, Shaoshan Liu, Grace Tsai, Hongbing Hu, Chen-Chi Chu, and Feng Zheng

来源:IEEE International Conference on Robotics and Automation (ICRA) 2018

编译:孙钦

审核:颜青松,陈世浪

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

在本文中,我们提出了一种感知机器人视觉系统(PIRVS),该系统在视觉-惯性计算硬件上嵌入了同时定位和建图算法。PIRVS硬件配备了一个多核处理器,一个全局快门双目相机以及一个有着精确硬件同步的IMU。PIRVS软件采用了一个新颖且灵活的传感器融合方法,该方法对视觉测量和惯性测量进行紧耦合的同时,还与其他传感器模式进行了松耦合。它在个人电脑和PIRVS硬件上都能够实时运行。

图1 PIRVS硬件。

图2 PIRVS硬件时间戳同步。

图3 PIRVS系统架构。

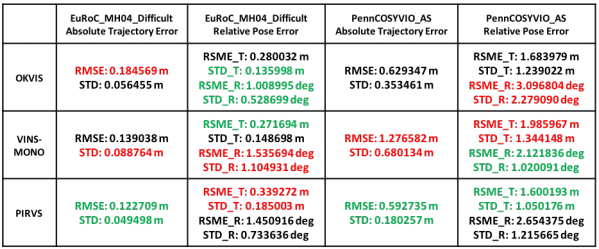

我们在多个公共的视觉-惯性数据集上对提出的系统进行了全面的评估。实验结果显示,我们的系统在个人电脑上和最先进的视觉-惯性算法在精度上旗鼓相当,而在PIRVS硬件上,我们的算法更高效。

表1 算法精度比较。(RMSE,均方误差,STD,标准差)。

表2 在PIRVS硬件上的时间比较。

Abstract

In this paper, we present the PerceptIn Robotics Vision System (PIRVS) system, a visual-inertial computing hardware with embedded simultaneous localization and mapping (SLAM) algorithm. The PIRVS hardware is equipped with a multi-core processor, a global-shutter stereo camera, and an IMU with precise hardware synchronization. The PIRVS software features a novel and flexible sensor fusion approach to not only tightly integrate visual measurements with inertial measurements and also to loosely couple with additional sensor modalities. It runs in real-time on both PC and the PIRVS hardware. We perform a thorough evaluation of the proposed system using multiple public visual-inertial datasets. Experimental results demonstrate that our system reaches comparable accuracy of state-of-the-art visual-inertial algorithms on PC, while being more efficient on the PIRVS hardware.

如果你对本文感兴趣,请点击点击阅读原文下载完整文章,如想查看更多文章请关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com